1. 서 론

하천을 포함한 개수로의 유량 측정은 수리학에서 가장 핵심이 되는 중요 부분이다. 특히 홍수시 하천의 유량 측정은 극단적인 조건하에서 이루어지기 때문에 정확성, 실효성, 안전성에서 모두 큰 제약을 받는다. 이런 제약 때문에 하천의 유속과 유량은 실시간 관측 자료가 부족하거나 정확하지 못하여 홍수 예측의 정확성에 영향을 주게 된다. 이런 면에서 전파유속계나 영상유속계와 같은 비접촉 유속측정 기술은 매우 유망하기 때문에 실무 적용을 위한 노력이 필요하다.

이런 대안 기술중 전파유속계는 간편성 때문에 일본과 우리나라에서 현재 상용 제품까지 등장하였다(Miyaura et al., 2012; Kim et al., 2015). 간편성은 전파유속계가 갖는 가장 큰 장점이다. 그러나, 도플러 효과를 이용한다는 근본 원리 때문에 발생하는 저유속 측정의 정확도 문제, 흐름방향과 측정 위치 관계 문제, 전파를 이용하므로 생기는 공간해상도 문제 등 몇 가지 제약을 지니고 있다(Yamaguchi, 2011).

한편, 일본에서 전파유속계와 거의 같은 시기에 등장한 영상유속계는 가시광을 이용하므로 전파유속계에 비해 공간해상도에서 많은 장점이 있다. 또한, 최근의 영상처리기술의 발달에 힘입어 획기적인 발전을 이루었다. 초기의 입자영상유속측정법(particle image velocimetry, PIV)에서 주로 사용하는 상호상관법에 의존하던 영상분석 기술(Raffel et al., 2018; Yu and Park, 2016)이, 현재는 시공간영상(spatio-temporal image, STI)을 이용하는 방법으로 발전한 것도 큰 변화라 볼 수 있다. 또한, 이용하는 장비도 기존의 캠코더와 노트북 PC (Aya, et al., 1995)에서 열영상 카메라(Bae et al., 2017), CCTV, 스마트폰(Yu and Whang, 2016) 등으로 매우 다양하게 변화되었다. 또한 최근에는 드론(Yu and Whang, 2017)을 이용하고자 하는 데까지 이르렀다. 이에 따라 일본에서는 이를 활용하는 전문 소프트웨어와 장비들이 상용으로 판매되고 있다. 그러나, 이런 장비의 비약적인 발전에 비해 현장의 다양한 환경 및 흐름 조건에 적용하기 위해서는 영상분석 기술의 발전이 필요하다.

영상유속계를 이용한 하천의 유속측정에서 가장 적절한 방식으로 주목을 받는 것이 시공간영상유속계(spatio-temporal image velocimetry, STIV)이다. 시공간영상유속계는 하천표면을 연속으로 촬영한 정지영상이나 동영상에서 시공간영상을 만들고 이 시공간영상의 줄무늬를 분석하여 유속을 산정하는 기법(Fujita et al., 2005)이다. STIV는 하천유속 측정에 필요한 시간평균을 간단히 해결할 수 있으며, 높은 공간해상도를 가진다는 점에서 하천유속측정에는 최적이라 볼 수 있다. 이 STIV에서 가장 핵심이 되는 기술이 시공간영상의 영상줄 기울기를 어떻게 구할 것인가 하는 것이다. 유속장의 다양한 상황에 따라 시공간영상은 매우 다양하게 나타나며, 이런 다양한 상황을 모두 해결할 수 있는 방법에 대한 해결 방안이 요구된다.

이에 본 연구에서는 이런 시공간영상분석에서 가장 핵심이 되는 시공간영상의 영상줄 기울기를 고속푸리에변환(fast Fourier transform, FFT)을 이용하여 분석하는 방법을 제안하고 이를 검증하였다.

2. 시공간체적 영상분석

2.1 기존의 시공간체적 영상분석법

표면영상유속계측법은 입자영상유속계측법의 유속 산정 원리를 기초로, 한 쌍의 영상을 이용하여 하천 표면의 2차원 유속 분포를 계측하는 방법이다.

표면영상을 이용한 유속측정을 처음으로 하천에 도입한 연구는 Aya et al. (1995)의 연구라 볼 수 있다. 이들은 캠코더로 하천의 표면영상을 촬영한 동영상을 PC로 분석하여 유속장을 산정하였다. 이 때 사용한 영상분석 방법은 가장 단순한 상호상관법이다(Yu and Park, 2016). 이 방법은 실험실에서 주로 사용하던 PIV 기법을 하천 표면이라는 큰 규모에 적용했다는 의미에서 Ettema et al. (1997)이 LSPIV (large scale particle image velocimetry)라고 이름을 붙였다. 국내에서는 장치의 특성인 표면 영상을 이용하여 유속을 측정한다는 의미에 보다 충실하기 위해 표면영상유속계측법(surface image velocimetry)이라 하고, 이 기법으로 유속을 측정하는 장비는 표면영상유속계(surface image velocimeter, SIV)로 부르고 있다(Kim et al., 2011)1)

일반적으로 표면영상유속계는 PIV 기법에서 사용하고 있는 상호상관법(cross-correlation method)을 이용한다. 상호상관법의 경우 두 장의 영상만을 이용하여 유속을 산정하기 때문에 짧은 시간간격의 유속분포 측정에는 장점(높은 시간해상도)을 갖고 있지만, 긴 시간의 측정을 하는 데는 분석시간이 오래 걸리며, 평균적인 흐름특성을 구하기 위해서는 순간분석자료들을 통계처리해야 하는 번거로움이 있다.

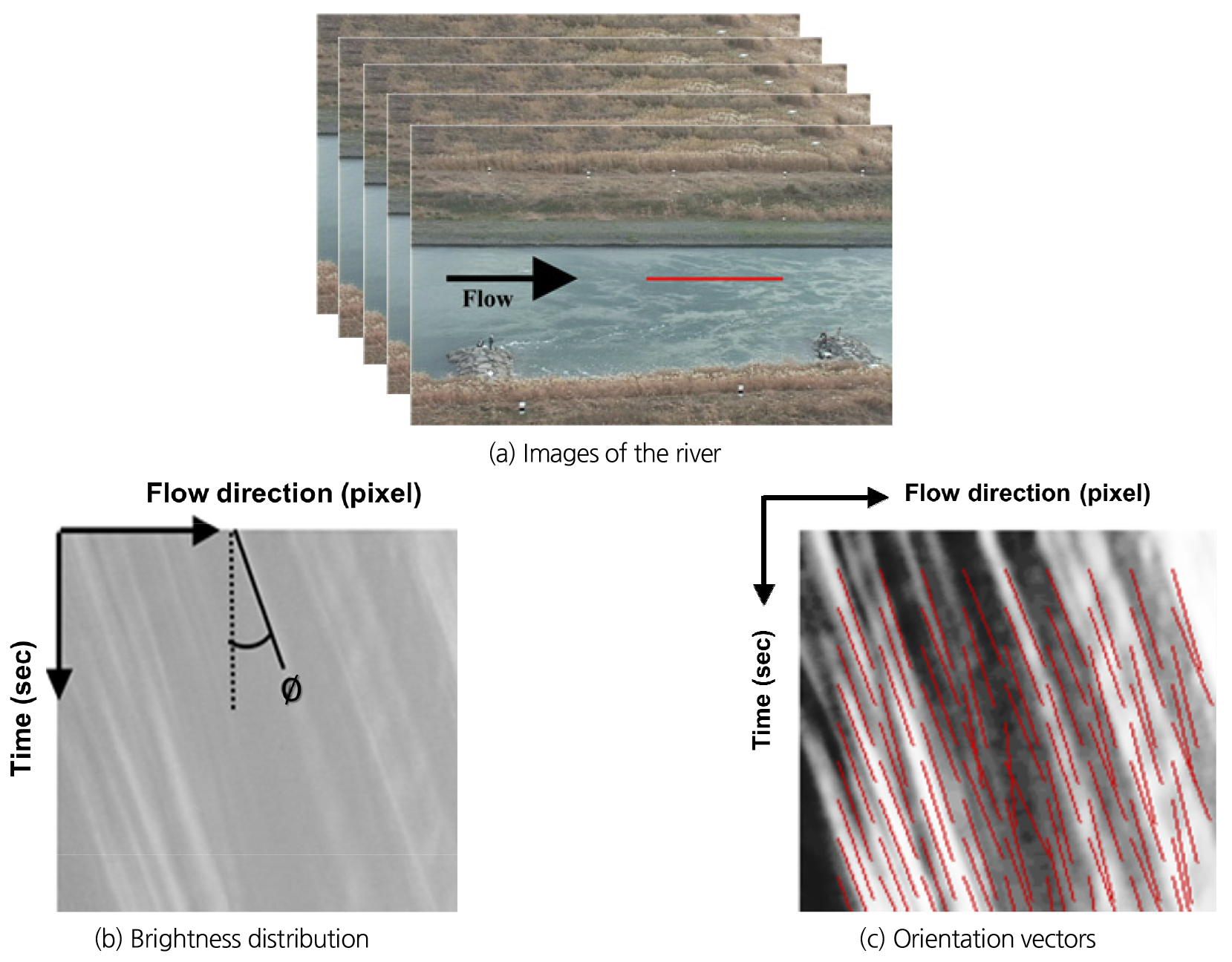

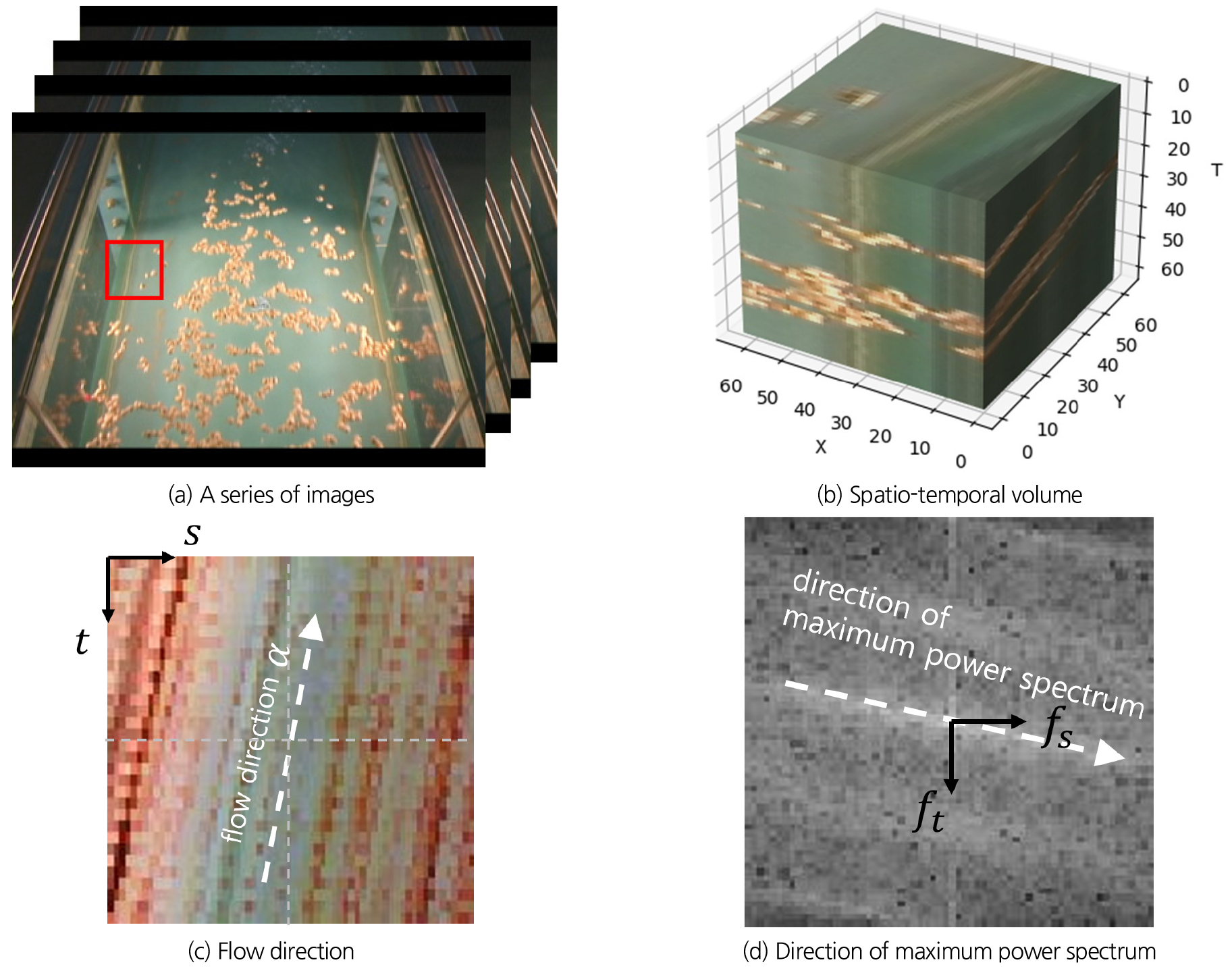

이를 해결하기 위한 방법으로 Fujita and Tsubaki (2003)와 Fujita et al. (2005)은 시공간영상 유속계측법(spatio-temporal image velocimetry)을 개발하였다. 시공간 영상(spatio-temporal image, STI)이란 Fig. 1과 같이 연속된 영상 시계열로부터 한 영상에서 한 줄씩 영상줄을 잘라내고, 이를 시간에 따라 연속적으로 연결하여 만든 영상을 말한다. 즉, 시공간 영상은 한 축은 공간, 다른 한 축은 시간으로 이루어진 영상이다. 또한 시공간 영상 분석이란 시공간 영상에 나타난 물체의 움직임을 영상 휘도값의 미분을 통해 분석하는 방법을 말한다(Jähne, 1993; Bigun, 2006). 다시 말하자면, 시공간 영상 분석법은 여러 매의 연속된 영상을 한꺼번에 분석하여 그 시간 동안의 평균 유속을 분석하는 방법이다. 예를 들어 초당 30장의 영상을 촬영하는 일반 캠코더를 이용하였을 경우, 일반적인 상호상관법으로 분석을 하게 되면 하나의 측점에 대하여 29개의 유속벡터 시계열이 측정되지만 시공간 영상 분석법으로 분석을 하게 되면 30장의 영상을 이용하여 1개의 유속 벡터를 산정하게 된다. 이와 같이 연속된 영상을 이용하기 때문에 영상 내 입자 부족과 잡음에 따른 오차를 줄여서 유속 측정 정확도를 향상시킬 수 있다는 장점이 있다. 이 때, 일련의 영상에서 하나의 유속벡터만 산정하기 때문에 시간해상도가 낮아지는 단점이 있다. 그러나 일반적으로 하천의 유량을 산정할 경우 시간 평균 유속을 사용하여도 큰 오차를 포함하지 않기 때문에, 이 단점은 큰 문제가 되지 않으며, 시공간 영상 분석법이 기존의 상호상관법보다 실용성이 높다고 할 수 있다(Fujita et al., 2005).

STIV는 1차원 시간 평균유속벡터를 계측하는 방법이다. 흐름 추적자가 3차원 시공간에서의 운동의 연속성을 이용하여, 흐름 방향에 평행한 검사선을 분석 영역으로 하여 영상 공간과 시간 차례로 형성된 시공간 영상에서 추적자 운동과 관련된 무늬의 방향 특징을 측정한다. 그리고 직접적으로 지정한 공간방향에서의 시간 평균 운동 벡터를 예측한다. STIV는 단지 1차원 유속만 측정할 수 있지만, LSPIV에 비해 공간 해상도가 단화소 정확도에 달할 수 있으며, 계산효율은 특징 일치(feature matching)의 10배 이상이다.

그러나 시공간영상 분석법도 몇 가지 한계를 가지고 있다. 가장 먼저 개발된 Fujita 등(Fujita and Tsubaki, 2003; Fujita et al., 2005)의 시공간 영상 유속계는 계측 대상의 주흐름 방향 성분만으로 측정 가능하다는 한계가 있다 즉, 종래의 시공간 영상 유속계측법은 영상 휘도의 편미분 분석만을 고려하고 있기 때문에 주흐름 방향 성분만 분석할 수 있는 단점이 있다. 다시 말하자면, STIV를 이용할 경우 하천의 일방향 유속만을 계산할 수 있으며 구조물 주변이나 만곡이 있는 경우의 2차원 흐름 측정은 불가능하다는 한계가 있다. 이를 극복하기 위해 Yu et al. (2014)은 시공간영상을 상호상관법으로 분석하는 방법인 CASTI를 제안하였다. 인공입자영상에 대한 시험과 수리모형실험에 대한 적용에서 이 방법은 상당히 훌륭한 결과를 보여주었다. 그러나 이 방법도 STI의 다양한 상황에 대처하기에는 한계가 있다. 즉, 상호상관법을 이용하기 때문에 유속이 매우 느린 경우에는 정확도에 한계가 있으며, 영상이 조금이라도 흔들리면 오차가 너무 커지므로 흔들리는 영상에 대해서는 대처하기 어렵다.

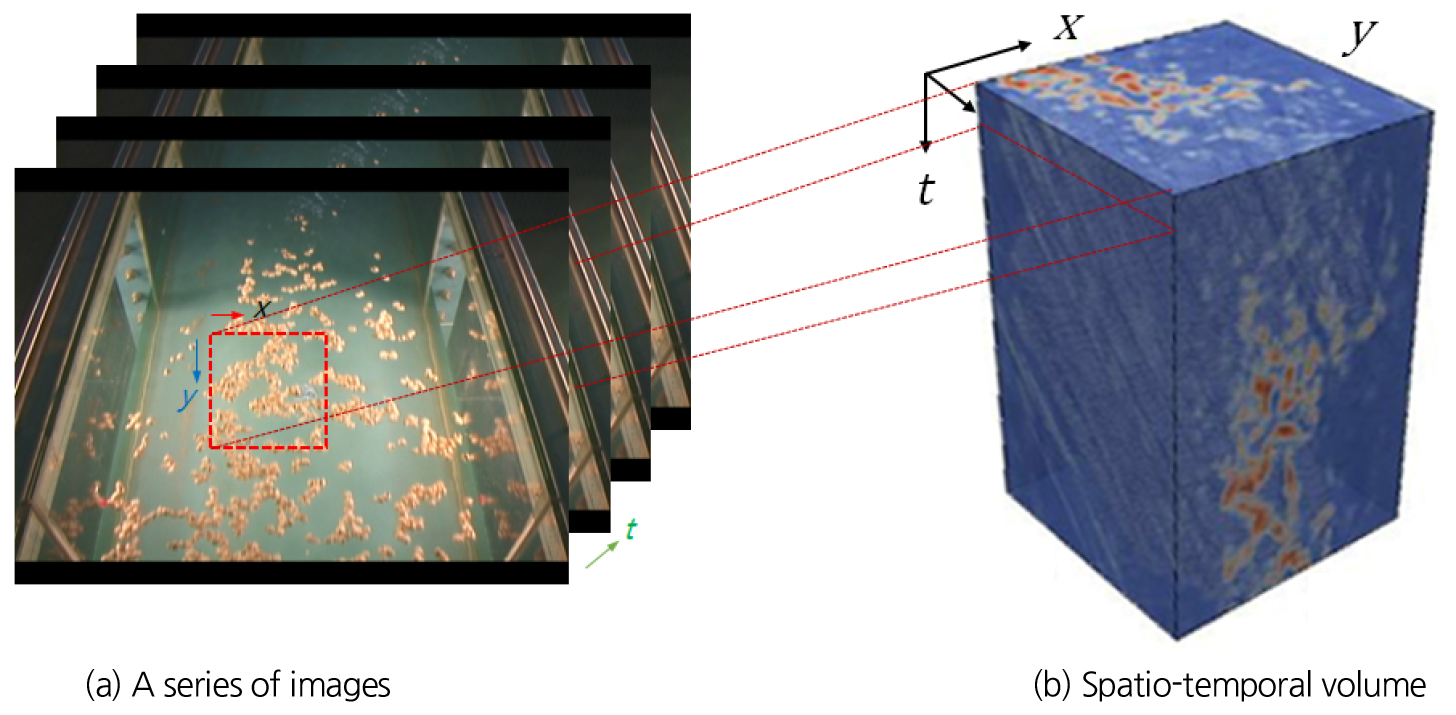

시공간영상분석법의 일차원적인 한계를 극복하기 위해 Notoya et al. (2017)이 새로 제안한 것이 시공간체적(spatio-temporal volume) 분석법이다. Fig. 1의 시공간영상이 영상줄을 잘라내어 이를 시간에 대해 쌓아올린 데 반해, 시공간체적은 Fig. 2와 같이 일련의 영상(또는 동영상)에서 일정 영역을 잘라낸 뒤 이를 시간에 대해 쌓아올려 만든 것이다.

Notoya et al. (2017)이 제시하였듯이, 이 시공간체적은 흐름방향과 유속에 대한 정보를 모두 지니고 있다. 따라서 이 시공간체적을 적절히 분석하면 2차원적인 유속분포를 산정해 낼 수 있게 된다. 여기서 Notoya et al. (2017)이 선택한 방법은 자기상관함수(autocorrelation function, acf)을 이용하는 방법이다. 자기상관함수는 다음과 같이 나타낼 수 있다.

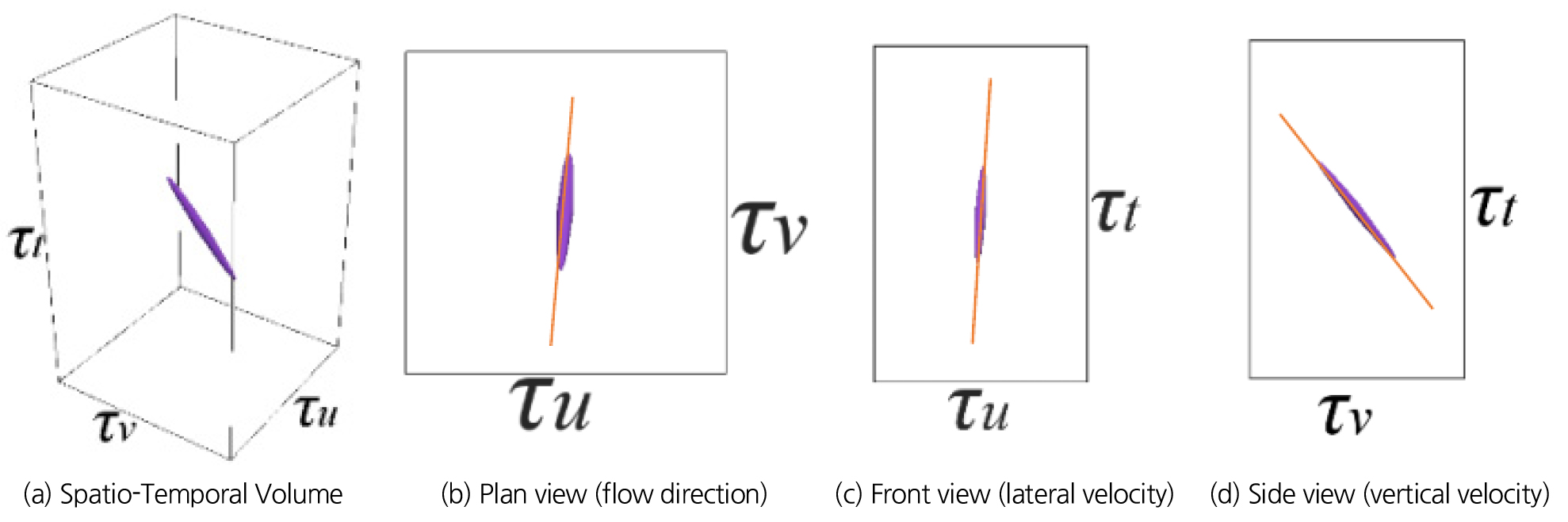

여기서 는 이동량, f(x)는 STV상의 위치 x에서 휘도값, 즉 t 프레임째의 화소좌표 (u, v)에서 휘도값이다. 이에 따라 x와 는 3차원 벡터를 구성한다. 이를 그림으로 나타내면 Fig. 3과 같다.

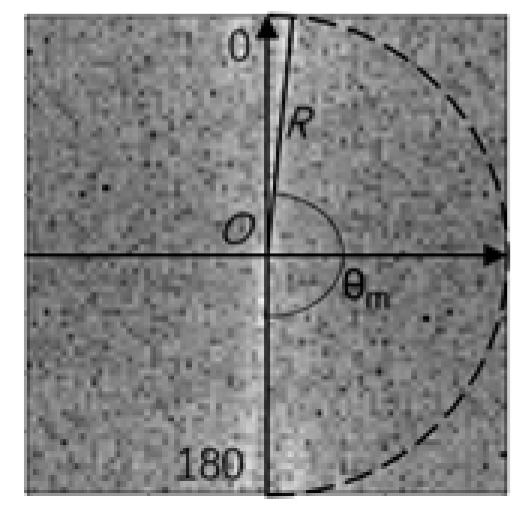

그런데, 여기서 Fig. 3(b)의 흐름방향을 결정하는 것이 상당히 복잡한 일이 된다. 왜냐하면, 여기서 보라색으로 보인, 자기상관함수가 0.6 이상인 영역의 방향을 결정하는 데 어떤 방법을 쓰는 것이 가장 효율적이고 정확할 것인가가 표면영상유속계 전체의 정확도를 좌우하게 되기 때문이다. 반면에, Fig. 3(c)와 Fig. 3(d)의 유속성분을 결정하는 것은 비교적 간단하다. 이 방법은 앞서 시공간유속계의 연구에서 수행한 Fujita et al. (2005)의 차분법, Yu et al. (2014)의 상호상관법 외에도, Zhang et al. (2017)이 제안한 FFT의 동력분광법(Fig. 4) 등이 있다. Zhang et al. (2017)은 주파수 영역에서 원점을 중심으로 0.1°씩 나누어 0°부터 180°까지 동력분광(power spectrum)을 계산하여 최대가 되는 각도를 찾아내는 방법을 고안하였다. 그러나 이 방법도 여전히 1차원 영상분석에 국한된다. 그 이유는 주흐름방향의 시공간영상에서는 줄무늬가 선명하지만, 흐름에 수직인 방향에서는 줄무늬가 이처럼 선명하게 나타나지 않기 때문이다.

Notoya et al. (2017)은 이 시공간체적(STV)의 분석을 위해 대수극좌표 변환을 이용하였다. STV의 중심에서 방사상으로 늘어진 방향축상의 자기상관함수의 평균을 취하고, 그 평균이 최대가 되는 방향으로 타원체 장축이 존재한다고 생각하였다. 그러나, 자기상관함수를 구한 배열 자료에서 이 처리를 직접 수행하기는 번잡하며, 이해하기 어렵게 구성되어 있다.

한편, Zhang et al. (2017)이 언급한 것처럼, 주파수 분광분석에 따른 방법은 공간 영역의 복잡한 무늬의 주방향에 대한 측정을, 주파수 영역에서의 영상 주파수 주방향을 찾는 선형 연산으로 전환한다. 그 결과 계산법의 잡음 저항성을 높일 수 있을 뿐만 아니라 계산도 간단하게 할 수 있다. 다만, 실제로 이 방법으로 영상을 주파수 분광분석을 할 때 생기는 문제는 ‘주흐름방향을 정확하게 결정해야 한다’는 점이다.

본 연구에서는 이 문제를 해결하기 위해 다음과 같은 새로운 시공간체적 분석법을 제안하였다.

2.2 새로운 시공간체적분석법

본 연구에서는 Fig. 2에 보인 시공간체적을 두 단계로 나누어 분석하여 유속을 산정한다. 첫번째 단계에서는 공간 평면, 즉 Fig. 2(b)의 (x, y) 평면의 영상들에서 흐름 방향을 결정하는 단계이다. 여기에서는 (x, y) 평면의 영상들을 평균한 뒤 평균영상의 FFT 분석을 통해서 방향을 추정하였다. 두 번째 단계에서는 이렇게 찾아낸 흐름방향으로 시공간영상을 만든 후 이 시공간영상을 역시 FFT 분석하여 유속벡터의 크기를 찾아내었다.

첫 번째 단계에서 주흐름방향을 결정하는 방법을 살펴보자. 이 과정은 Fig. 5에 예시되어 있다. Fig. 5(a)와 같은 일련의 정지영상 또는 동영상에서 Fig. 5(b)와 같은 시공간체적을 만든다. 이 시공간 체적을 (x, y) 평면 영상들에 대해 Fig. 5(c)와 같은 최대값 영상(또는 최대차 영상)을 만든다. 이 최대값 영상(실제로는 이 최대값 영상을 회색영상으로 만든 것)을 FFT 변환을 하면 Fig. 5(d)와 같은 동력분광(power spectrum) 영상을 만들 수 있다. 이 동력분광영상에서 최대값의 방향을 찾아내고, 이 최대값의 방향각에서 원영상의 주흐름 방향을 찾아낸다.

이렇게 구해진 동력분광영상에서 영상기울기 즉, 최대값을 찾아내는 방법은 Fig. 4와 같이 Zhang et al. (2017)이 구현한 0.1°씩 회전시켜서 찾아내는 방법이 원리적으로 가장 간단하며 코드로 구현하기도 좋다. 본 연구에서는 Zhang et al. (2017)의 방법과 유사하게 0.1° 단위로 최대값이 되는 기울기를 찾았다. 다만, 탐색속도를 증가시키기 위해, 먼저 개략적으로 10° 단위로 최대값을 찾고, 그 다음에 그 10° 범위 안에서 1°씩 증가시켜가며 최대값을 찾고, 다음에 그 1° 범위 안에서 0.1°씩 증가시켜가며 최대값을 찾는 방법을 이용하였다. 이 경우 Zhang et al. (2017)의 방법으로 0° ~ 179.9° 범위의 탐색에는 총 1,800번의 계산이 필요한 반면, 본 연구의 방법에서는 탐색의 최대 실행수가 33번이 된다.

또한, 제안된 새 방법은 다음과 같이 이용할 수도 있다. 어떤 지점의 시공간체적을 처음 분석할 때는 위와 같이 0° ~ 179.9° 범위를 탐색해야 하지만, 두 번째부터는 주흐름방향을 개략적으로 알고 있으므로, 위의 반복과정에서 제일 첫 번째 단계인 10° 단위 탐색을 생략하고 바로 이전 실행에서 알아낸 주흐름방향의 ±5° 범위에서 1°씩 증가시켜가며 최대값을 찾고, 다음에 그 1° 범위 안에서 0.1°씩 증가시켜가며 최대값을 찾는 방법을 이용할 수 있다. 이것은 실시간으로 지속적으로 유속을 측정하는 표면영상유속계에서는 분석시간을 단축시킬 수 있는 이점이 있다.

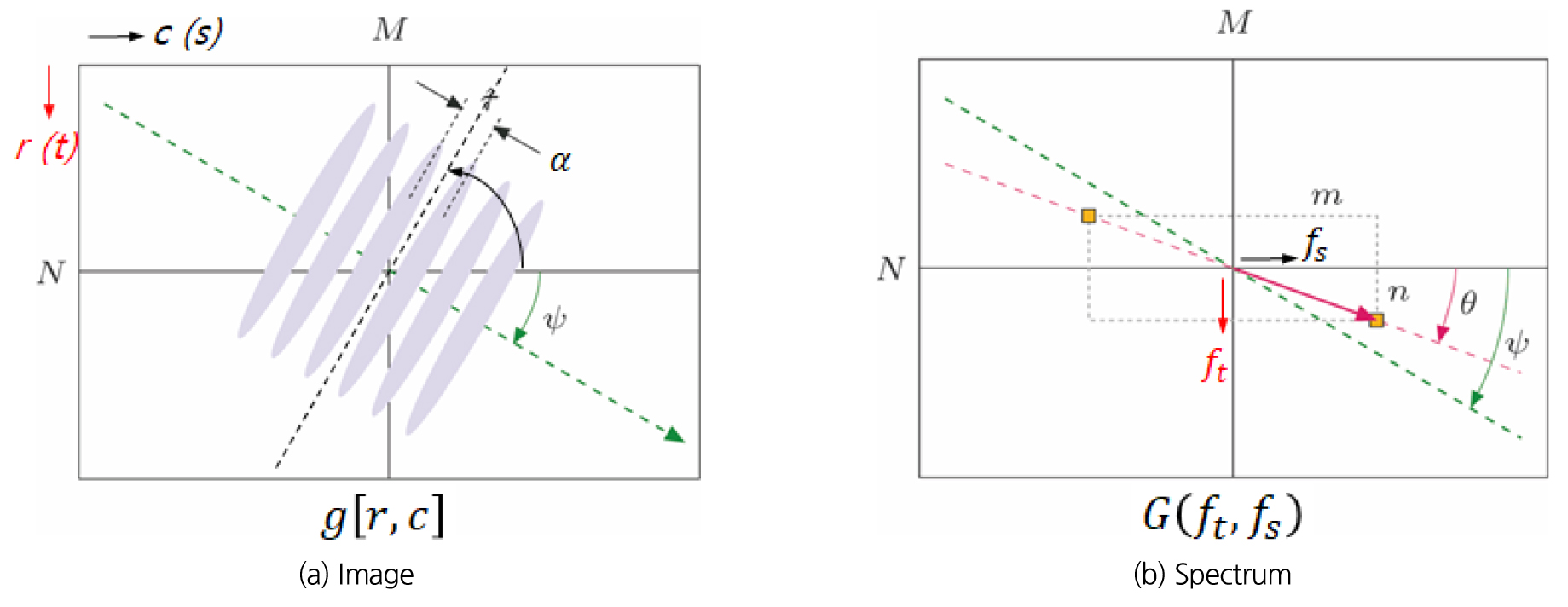

이렇게 찾아낸 동력분광영상의 기울기와 원 시공간영상 사이의 관계는 Burger and Burge (2016)가 Fig. 6과 같이 적절한 관계를 제시하였다. Fig. 6(a)에서 보인 것처럼 영상이 유효 주파수 과 방향 을 가진 주기 형태를 갖는다. 따라서 M = N인 경우는 주파수 공간의 방향 는 영상공간의 줄무늬 방향 와 수직이다. 그런데, 인 경우는 이 형태에 대응하는 주파수계수는 Fig. 6(b)의 2D Fourier 분광에서는 위치 에서 발견된다. 그리고, 만일 이면, 분광계수 (m, n)은 영상형태의 방향()과 다른 방향()을 갖는다(Burger and Burge, 2016). 따라서, 일반적으로 다음의 관계를 갖게 된다.

이런 과정을 거쳐 주흐름 방향을 찾아내었으면, 다음에는 이 주흐름방향에 대한 시공간영상을 만드는 두 번째 과정에 착수한다. 이처럼 굳이 주흐름방향에 대해 시공간 영상을 별도로 만들어야 하는 이유는 다음과 같다.

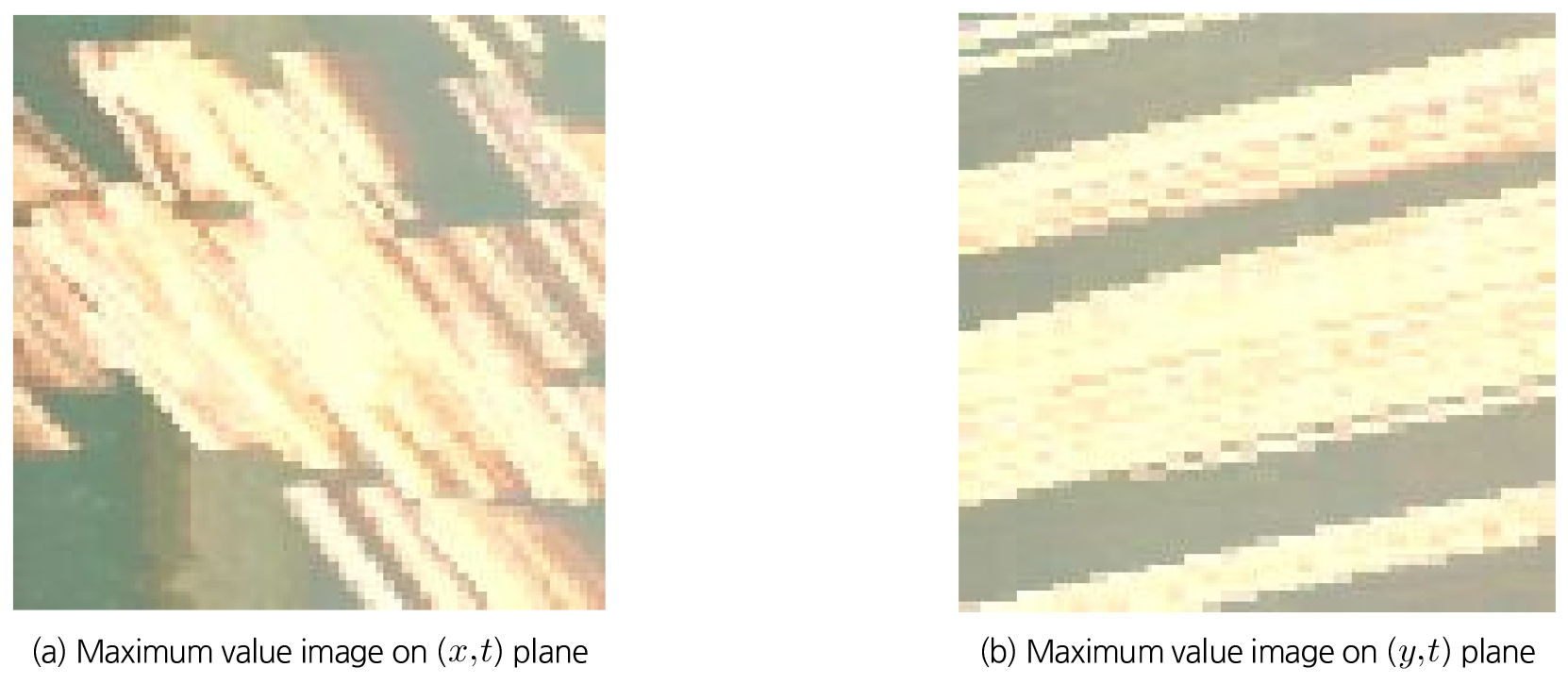

Fig. 7은 Fig. 5(b)의 시공간체적에서 (x, t) 평면의 y 방향 최대값영상과 (y, t) 평면의 x 방향 최대값영상이다. 여기서 두 영상 모두 어느 정도 확실한 영상줄무늬를 보여주고 있다. 다만, (y, t) 평면에서는 y 방향으로 확실한 유속이 있으므로 문제가 별로 없으나, (x, t) 평면에서는 x 방향으로 거의 유속이 없음에도 불구하고 이런 줄무늬가 나타났으므로 해석상 오류가 발생할 우려가 있다.

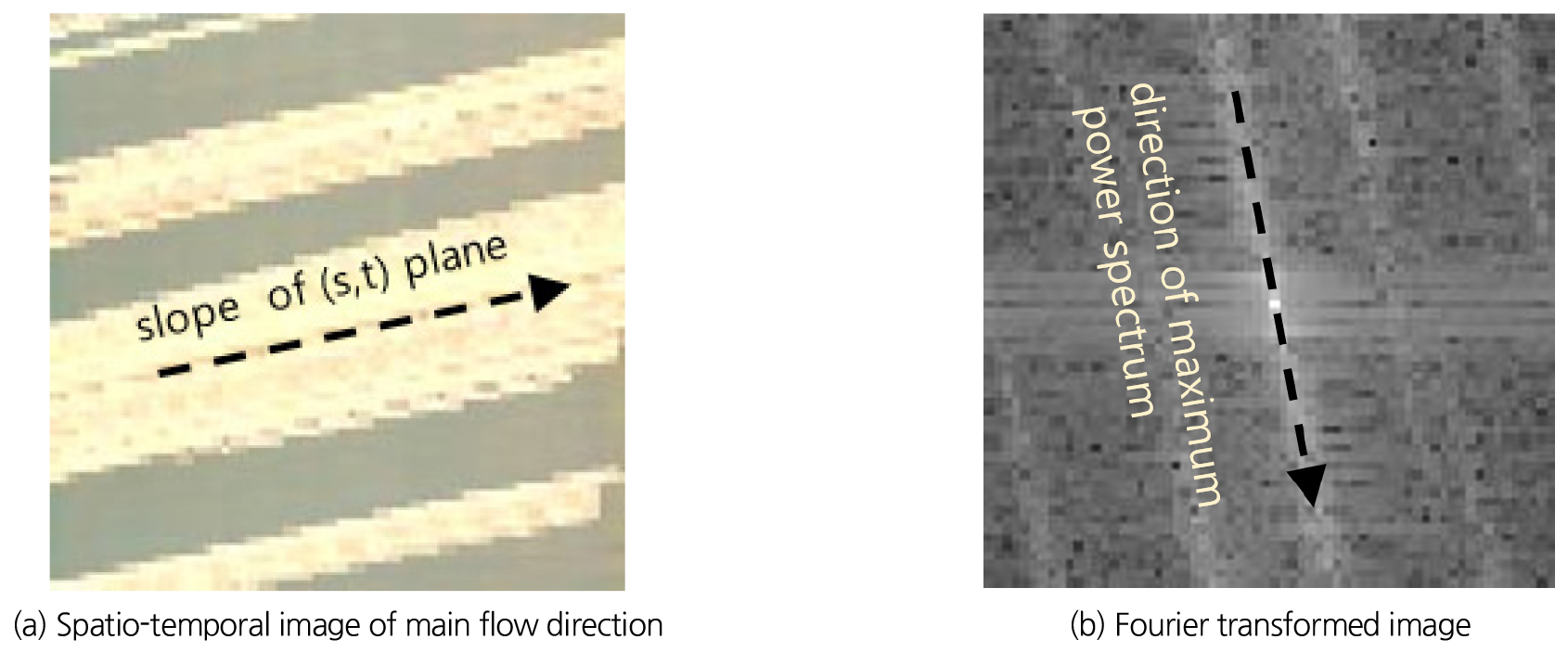

따라서, Fig. 5(b)의 시공간 체적에서 Fig. 5(c)의 주흐름방향으로 (s, t) 평면의 시공간영상을 잘라내면, Fig. 8(a)와 같다. 시공간 체적에서 주흐름방향의 시공간영상을 잘라내기 위해서는 시공간체적의 한 (x, y) 평면 영상을 주흐름방향의 각도만큼 회전시킨 뒤 수평이 된 영상줄을 잘라내면 된다. 이렇게 만든 주흐름방향의 시공간영상 Fig. 8(a)에서는 확실하게 주흐름방향의 흐름을 찾아볼 수 있다. 여기에 앞서 주흐름방향을 찾는 알고리즘을 적용하여 줄무늬 경사를 찾아낼 수 있다.

그런데 영상의 기울기인 의 단위는 (시간화소)/(공간화소)이므로 실제 유속은 다음과 같이 표시된다.

여기서 시공간계수는 (공간축척)/(시간축척)으로 정의되며, 공간축척을 (m/화소), 시간축척을 (s/화소)로 했을 때 (m/s)의 단위를 갖는다.

3. 인공입자영상을 이용한 검증

상호상관법을 이용한 시공간 영상 분석법의 영상 분석 성능을 객관적으로 평가하기 위해 인공 영상(artificial images)을 이용하여 오차 분석을 실시하였다. 인공 영상의 경우 영상의 움직임을 사용자가 원하는 대로 제작할 수 있기 때문에 참값을 확보할 수 있다는 장점이 있다. 인공영상의 생성방법은 일본의 가시화정보학회(VSJ, 2002)에서 제시된 PIV 표준 영상 제작법을 재현하였다. 인공영상을 생성하기 위해서는 대상이 되는 속도장을 결정하고, 추적 입자의 위치 정보를 기반으로 영상 내 입자를 생성하는 과정이 필요하다. 이와 같은 인공영상 생성방법을 간단히 소개하면 우선 대상으로 하는 속도장으로서 1차원적인 해석 함수를 이용하거나, Rankine 와류나 Couette 흐름과 같이 수치적으로 모의하기 쉬운 흐름장을 이용하거나, LES 또는 직접 수치 모의에 의한 수치 모의 결과를 속도장으로 이용하도록 한다. 그리고 입자 명암값 형태는 Gauss 분포를 사용하였으며, 입자의 실제 좌표 (xp, yp, zp)를 영상에 투영한 위치를 (X, Y)로 놓고, 화상의 명암값 형태 I(x, y)를 다음의 Eq. (4)로 구한다.

여기서, dp는 영상 내 입자의 크기를 나타낸다. 또한 입자의 밝기를 나타내는 입자의 명암값(I0)은 레이저 평면광 두께 내부의 분포함수도 가우스함수를 사용한다. 입자 중심에서 최대 강도는 입자가 평면광 두께 내의 위치를 고려하여 Eq. (5)로 결정하였다.

여기서, T는 레이저 광면의 두께, Imax는 영상위의 입자의 최대 명암값이다.

마지막으로 입자를 생성하기 위해, 먼저 난수에 의해 추적 입자의 3차원 위치를 결정하고, 추적 입자의 명암값 형태(I)을 구한다. 결정한 흐름특성에 따라 입자 위치를 변화시키면서, 두 번째 시각의 입자 위치를 계산하고, 두 번째 시각의 명암값 패턴을 구한다. 이것을 필요한 입자 개수 만큼 반복적으로 적용하여 연속된 인공영상을 생성한다.

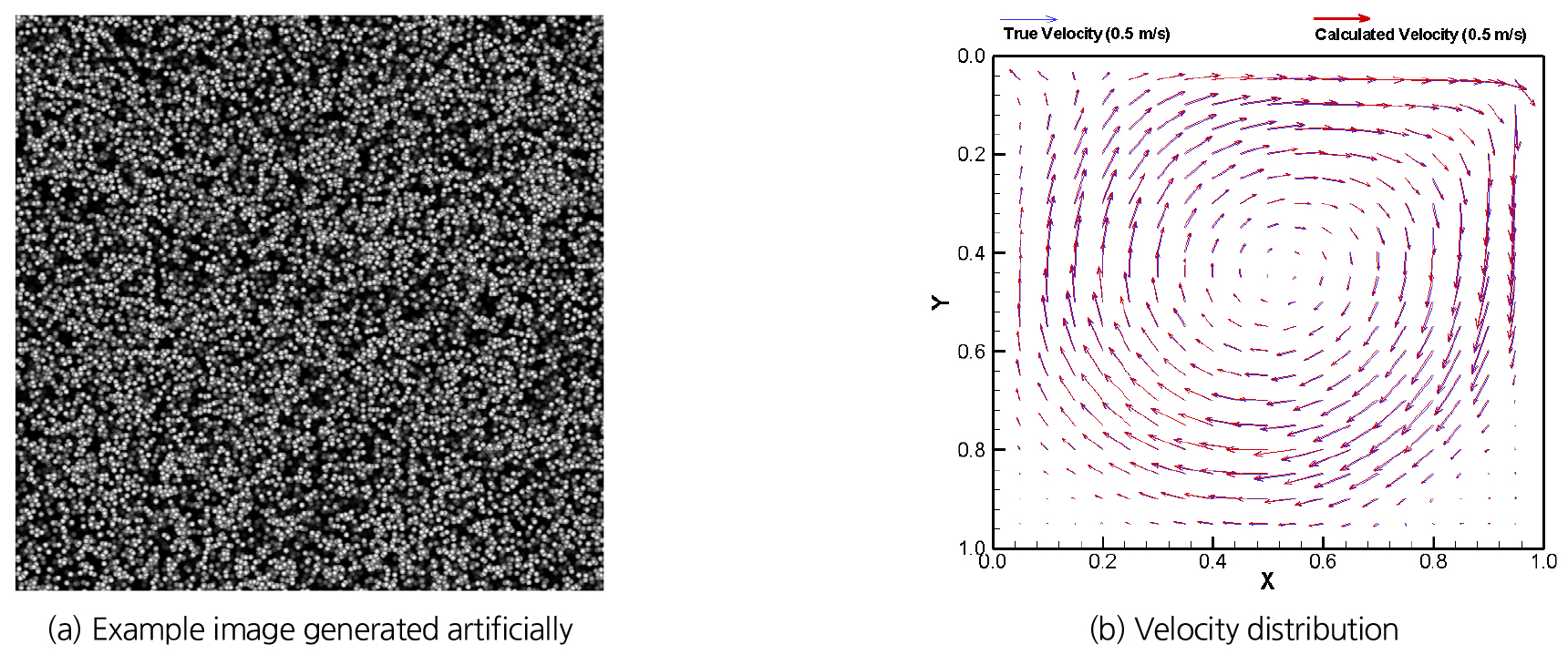

본 연구에서는 인공영상 내 입자의 움직임을 뚜껑 유도 공동 흐름(lid-driven cavity flow)으로 결정하였고, 인공영상의 참값을 확보하기 위해서 공동 흐름에 대한 해석은 Ferziger and Peric (2002)에서 제시한 유한체적법을 이용하였다. 본 연구에서 상호상관법을 이용한 시공간 영상 분석법의 오차 분석에 공동 흐름을 이용한 이유는 공동 흐름이 Ghia et al. (1982)의 연구 이후 많은 연구자들에 의해 흐름 특성이 명확히 밝혀져 있고, 흐름특성으로는 2차원 유속분포를 갖고 있으며, 유속 분포가 균일하지 않고, 최대 유속과 최소 유속의 범위가 크기 때문에 수치 해석 기법의 성능 평가를 위해 많이 이용되고 있으며, 영상 분석 프로그램의 성능 평가에도 가장 적합할 것으로 판단하였다. 상호상관법을 이용한 시공간 영상 분석법의 오차 분석을 위한 인공영상은 Table 1과 같은 조건에 대하여 제작하였고, 제작한 인공 영상은 Fig. 7과 같다. 인공영상은 총 60매를 제작하였다. 이 영상은 Yu et al. (2014)와 Yu et al. (2015)에서도 CASTI 알고리즘의 정확도 분석에 이용되었다.

Table 1.

Information of artificial images generation

| Number of particles | 20,000 |

| Number of images | 64 |

| Mean diameter of particles (pixel) | 10 |

| Time interval (sec.) | 1/60 |

| Width of laser sheet (mm) | 2 |

| Image size (pixel) | 1,000 × 1,000 |

상호상관법을 이용한 시공간 영상 분석법으로 계산한 속도벡터와 공동흐름의 참값을 비교한 결과 Fig. 9와 같이 2차원 유속분포의 흐름방향을 상당히 정확하게 분석하는 것으로 나타났고, 인공영상 전체에 대한 오차를 분석한 결과, 영역 전체의 상대오차의 평균은 5% 정도로 만족스러운 오차를 보였다.

단, 유속이 극단적으로 느린 경우나, 회전류가 발생하는 경우는 예외적으로 상당히 큰 상대오차를 보였으나, 절대오차로 생각하면 용인할 수 있을 정도의 오차였다. 여기서 앞의 오차의 두 번째 요인으로 든 것은 PIV나 SIV 모두의 기본가정 때문에 발생하는 어쩔 수 없는 문제이다. 즉, 당초 PIV나 SIV 모두의 기본 가정인 ‘한 탐색영상에서는 입자는 회전하지 않고 직진한다’는 가정 때문에 흐름이 회전하는 부분에서는 오차가 발생할 요인이 상주한다. 아울러, 시공간영상이나 시공간체적을 이용할 경우 공간적인 영역의 범위가 상당히 크기 때문에 흐름이 국소적으로 변화할 경우 이를 따라잡지 못하는 오류도 발생한다. 다만, 본고의 핵심이 새로운 영상분석기법의 개발이므로, 이 방법의 구체적인 성능평가에 대해서는 추후 연구에 넘기기로 한다.

결론적으로, 개발된 방법은 주흐름방향에 대한 사전정보 없이도 2차원 흐름을 적절히 분석해 낼 수 있다. 다만, 여전히 발생하는 오차를 해결하기 위해서는 개발된 방법을 인공영상이나 다양한 하천의 실제 사례에 적용하여 그 적용성이나 효율성, 정확성 등에 대해 체계적으로 분석할 필요가 있다.

4. 결 론

본 연구의 내용은 요약하면, 다음과 같다.

1) 시공간 체적을 이용하여 표면유속을 분석하는 새로운 기법을 제시하였다. 먼저, 표면유속 분석을 위한 동영상 또는 일련의 정지영상에서 영상조각을 잘라낸 뒤 이를 일정시간동안 누적시킨 시공간체적을 만들었다. 이 시공간체적에서 시간축 방향으로 영상을 누적시킨 최대값 영상을 만들고, 이 최대값 영상에 고속푸리에변환(FFT)을 적용한 뒤 주흐름방향을 찾아내는 방법을 제시하였다.

2) 찾아낸 주흐름방향에 따라 시공간체적을 시간축으로 잘라낸 시공간영상을 만들고, 이 시공간영상을 다시 고속푸리에분석(FFT)을 이용하여 유속의 크기를 찾는 새로운 방법을 개발하였다.

3) 이 새로 개발된 시공간체적 분석법을 공동흐름에 대한 인공영상에 적용한 결과 비교적 정확하게 2차원 유속분포 측정이 가능한 것으로 나타났다.