1. 서 론

2. 시나리오 기반 상·하수도 관로 실시간 결함검출 기술

2.1 결함시나리오 구성 및 결함 모형제작

2.2 학습이미지 데이터 전처리

2.3 실시간 결함 진단모델

3. 관로의 결함 데이터 학습 및 실시간 결함검출

4. 결 론

1. 서 론

상·하수도 시스템은 사람들에게 안전하고 깨끗한 물을 공급하는 사회기반시설이며, 시스템 결함 발생으로 사회·경제적 문제를 일으킬 수 있는 중요시설이라고 할 수 있다. 특히, 상·하수도 관로는 지하에 매설된 지하 시설물이므로 결함의 검출이 다른 사회기반시설보다 복잡한 절차가 필요하다.

상·하수도 관로의 결함(i.e., 스케일, 균열, 관 파손, 연결관 돌출, 이음부 단차/이탈 등)은 상하수도의 통수 불량 사태뿐만 아니라 유수율 하락에도 영향을 주기 때문에 사회·경제적 문제를 야기한다. 이러한 상·하수도 관로의 결함탐지 및 진단의 지연은 환경, 더 나아가 최악에는 인명피해를 입히는 사태가 발생할 수 있다.

특히, 해외 선진국은 국내와 같이 상·하수도 관로 등의 사회기반시설 노후화 및 관로 결함 등의 문제를 겪고 있으며 이러한 문제해결을 위해 점검 및 유지관리를 위한 방법이 모색되고 있다(MOLIT, 2015). 국내의 상·하수도 관로 중 30년 이상 된 노후시설의 비율은 2017년 기준으로 10%이며, 2027년에는 21% 이상 노후관로의 비율이 급격하게 증가할 것으로 예상되며, 이에 따라 시설물의 사고를 미연에 방지하고 효율적으로 유지관리의 필요성을 강조하였다(Nam et al., 2018).

현재 상·하수도 관로의 결함검출은 육안을 통한 배관 진단과 같은 인력에 의존하는 방식으로 수행되어 진단 기술자의 경험에 따라 진단 결과의 정확도 및 신뢰도에 차이가 발생하고 진단에 따른 시간과 비용이 많이 소요되어 「시설물의 안전 및 유지관리에 관한 특별법」에서는 5년 주기로 수행한다. 특히, 상·하수도 관로의 특성상 접근이 용이하지 못한 관로는 내시경 등의 특수장비를 이용하여 영상 및 이미지 촬영 후 사후에 결함을 검출하는 등의 진단을 수행하고 있다(Kim et al., 2018). 또한 이러한 결함검출 기법은 항상 운영 되어야 하는 상·하수도와 같은 사회기반시설의 특성을 고려하여 불가피할 경우를 제외하고는 부단수 상태에서 관로의 비파괴 진단을 수행한다.

부단수 비파괴 배관 검사에는 초음파(Ultra), 원거리 장 탐사(Remote Field Test), 펄스 와전류 기술(Pulsed Eddy Current), 방사선 촬영 기법(Rdiography) 등이 포함된다. 초음파 기술은 부식과 균열을 탐지하고 그 특징을 파악하는데 매우 적합한 기술로서 초음파를 직선으로 송출하여 배관의 관두께 손실과 부식 깊이, 영역을 찾아내고 부식 맵 이미지도 얻을 수 있는 특징을 갖고 있다. 펄스 와전류 기술은 전자기 탐사 기술 중 하나이며 탐촉자(송신기) 코일에 의해서 펄스 자기장이 전달되어 탐사대상이 되는 물체와 탐촉자 사이에 비자성체(절연, 판금 등)를 통해서 침투하여 다양한 자기장이 물체의 표면에 와전류를 유도하고 이때 발생하는 와전류의 확산 거동 통해 대상물체의 재질과 배관두께 등을 측정하는 방법이다. 방사선 촬영 방법은 배관 표면에 있는 불연속 존재를 구체화하여 탐지하는 데 널리 사용되는 기술로서 방사선 빔과 평행한 방향으로 상당한 두께 변화가 있는 형태를 탐지는 특징을 갖고 있다(K-water, 2018).

하지만, 이러한 결함검출 기술은 정확도 높은 진단에 효과적이나 관로 진단을 통해 데이터를 획득하고 사후에 이와 같은 모형화와 분석을 통해 진단 결과를 도출하는 등의 시간과 인력에 따른 비용 소요가 크다. 따라서, 최근에는 이러한 한계점들을 극복하고 보다 효율적인 상·하수도 관로의 점검 및 진단업무를 수행하기 위해 4차 산업혁명 기술을 활용한 시설물 점검 및 진단 장비들이 개발되고 있다. 대표적으로 드론, 인공지능(Artificial Intelligence), 사물인터넷(Internet of things) 등의 기술을 기반으로 한 다양한 첨단 기술 및 장비들이 개발되고 있으며, 해당 기술이나 장비들의 진단 및 결함검출 분야에 적용되고 있다(Kim et al., 2018; Gillins, 2016; Cha et al., 2017).

그러나 현재는 첨단 기술 및 장비를 통한 결함검출 기법은 정확도 측면의 향상만을 도모하고 여전히 진단 기술자의 숙련도에 의존한 기술이었다. 또한, 최근 다양한 분야에 적용되고 있는 분류 및 예측 기법인 인공지능을 통한 결함진단은 축척된 데이터의 종류와 수에 따라 검출성능에 영향을 받기 때문에 결함의 종류 및 형태 등의 다양한 결함의 시나리오의 고려가 필수적이다. 하지만, 기존 진단기술을 사용한 상·하수도 관로 결함검출 기술의 학습데이터로는 기존의 진단을 통해 확인된 결함의 데이터만을 포함한다. 이러한 이유로 결함의 종류 및 형태, 수가 복잡하게 결합된 복합결함 등은 검출이 어렵거나, 오검출, 또는 진단전문가의 사후 검토를 통한 확인이 필요하다.

따라서, 본 연구에서는 상·하수도 관로의 효과적인 결함검출을 통한 유지보수를 위해 인공지능 기법을 적용한 결함검출과 발생 가능한 다양한 결함 시나리오를 3D 프린터를 이용해 구현하여 실시간 상·하수도 관로 결함검출 기술을 제안한다. 제안된 실시간 상·하수도 관로 결함검출 기술은 기존에 확보되지 않은 다양한 결함을 크기, 종류, 형태, 수 등을 복합적으로 고려하여 시나리오로 구성하고 이를 3D 프린트로 구현한다. 이후, 구현된 모델의 이미지 촬영을 통해 기존에 수집된 상·하수도 관로 결함 데이터와 함께 결함검출 알고리즘의 학습데이터로 구성한 후, 드론 및 내시경 카메라를 통한 진단과정에서 실시간으로 결함의 형태 및 심각도 등을 가시화하여 진단 기술자의 실시간 결함검출을 가능하게 하였다. 여기서 실시간의 의미는 학습된 소형 컴퓨터에 드론 및 내시경 카메라를 연결하여 구조물 내 결함을 실시간으로 검출하고 심각도 기준에 따라 분류할 수 있는 것이다. 본 연구는 상·하수도 관로의 상태를 여러 시나리오로 추정할 수 있고 실시간 정보 제공하고 향후 미래의 특정 시점에서의 상·하수도 관로의 기능적·구조적 상태 추정에도 활용할 수 있을 것으로 판단된다.

2. 시나리오 기반 상·하수도 관로 실시간 결함검출 기술

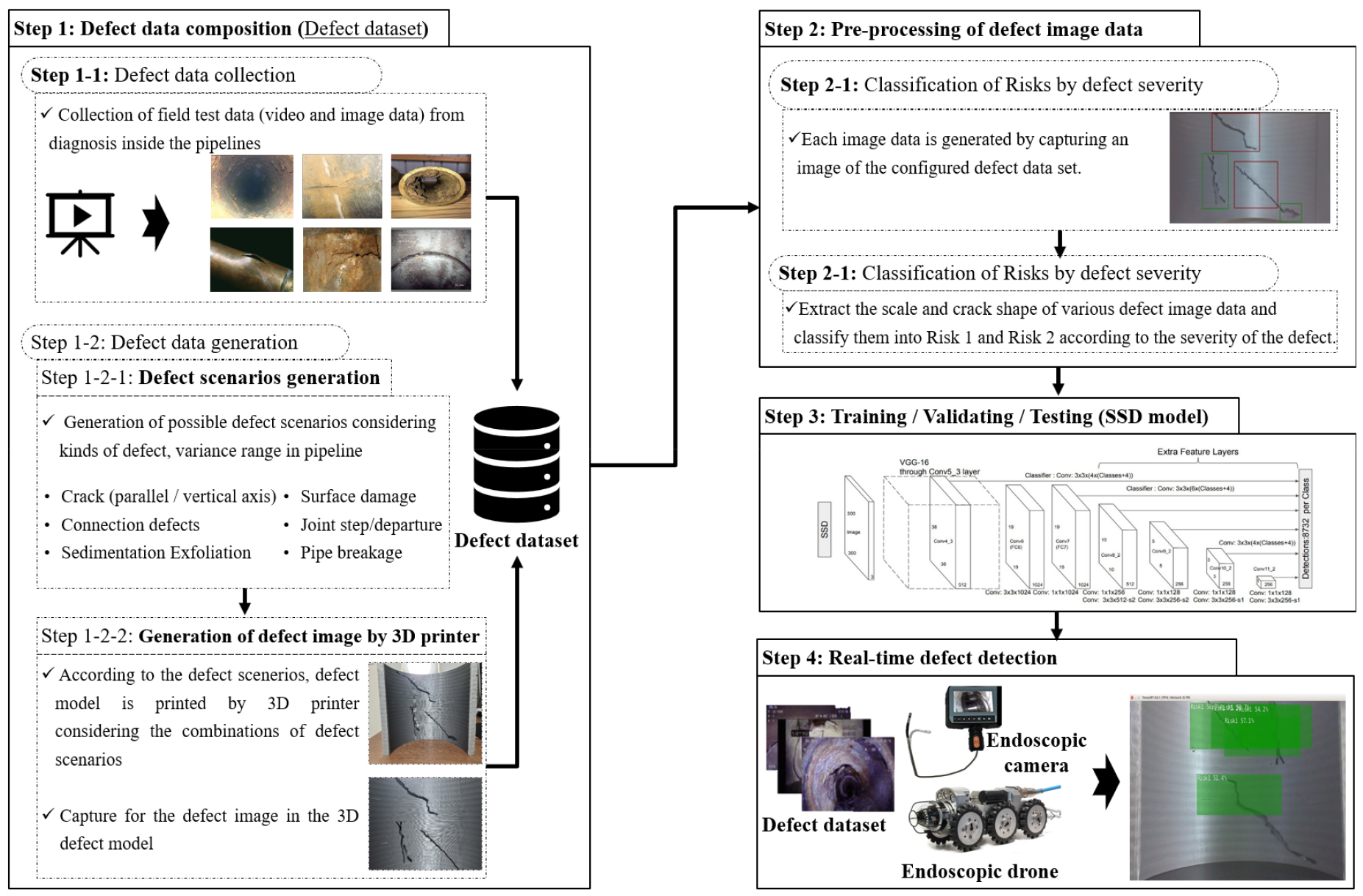

본 연구에서 제안한 시나리오 기반 상·하수도 관로 실시간 결함검출 기술은 인공지능기법을 적용한 상·하수도 결함검출 기술의 탐지성능에 영향을 주는 위한 학습데이터의 다양성 향상과 실시간 탐지를 가능하게 하여 결함검출 시 소요 시간 및 비용 측면의 성능 향상을 위해 개발되었다. 제안된 기술은 크게 4단계를 통해 상·하수도 관로의 결함을 검출하며, 자세한 사항은 Fig. 1의 시나리오 기반 상·하수도 관로 실시간 결함검출 기술의 순서도와 같다.

2.1 결함시나리오 구성 및 결함 모형제작

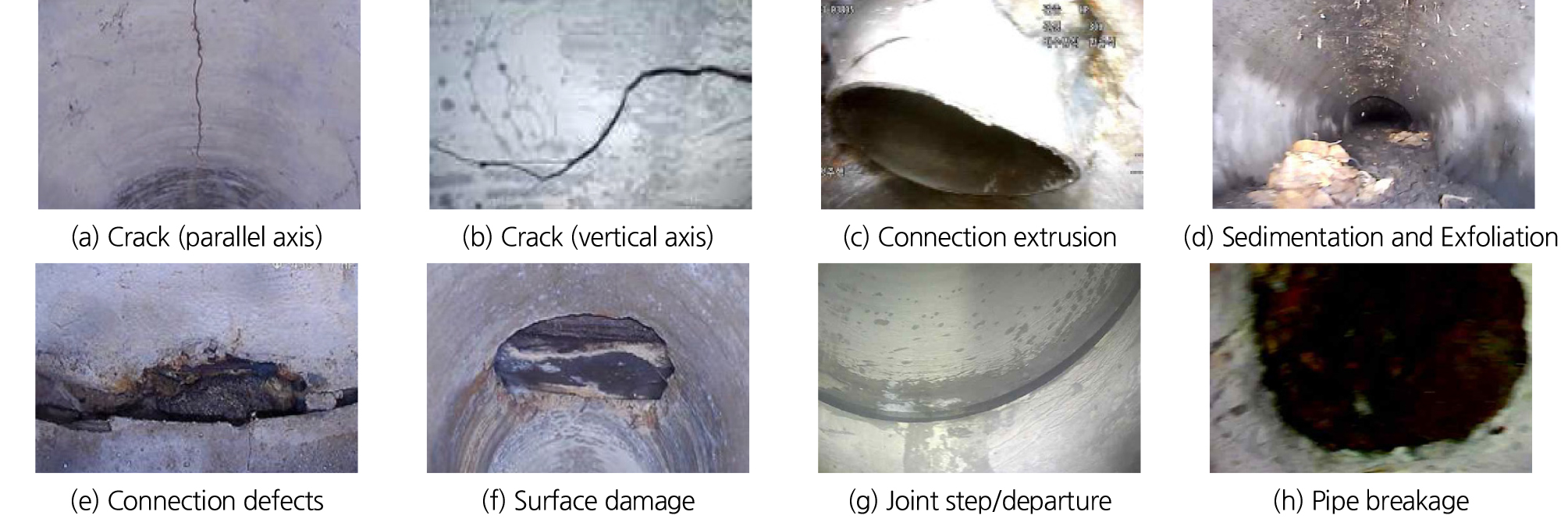

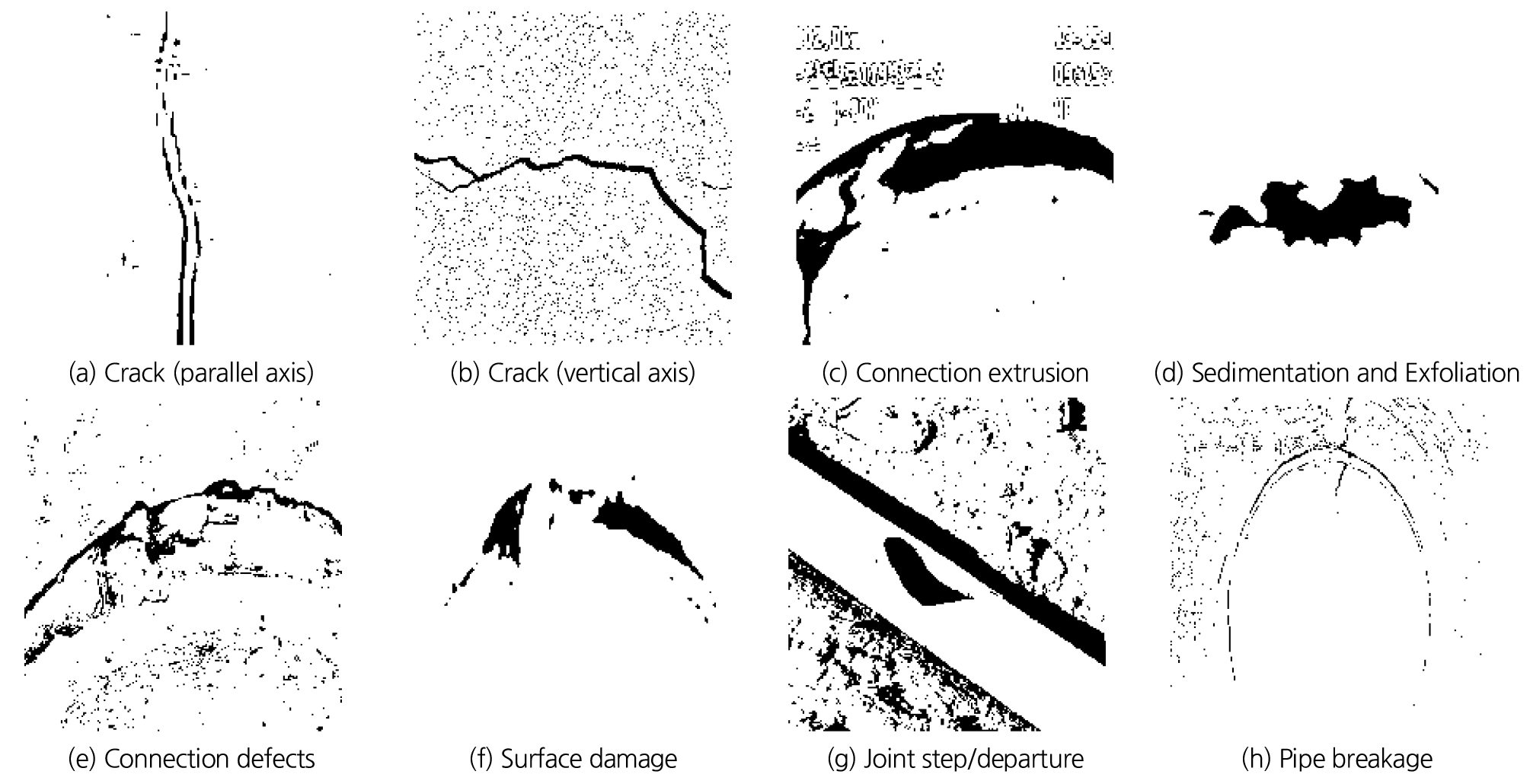

학습데이터의 다양성 향상을 위해 상·하수도 관로에서 발생 가능한 결함 시나리오를 구성한다. 발생 가능한 결함의 종류는 Fig. 2(Hassan et al., 2018)와 같이 (1) 균열, (2) 연결관 돌출, (3) 이음부 결함, (4) 이음부 단차, (5) 이음부 이탈, (6) 토사 퇴적, (7) 표면손상 (8) 관 파손 등으로 구성하고, 결함에 종류에 따른 다양한 결함 크기 및 복합 결함 등을 고려하여 시나리오를 구성한다. 시나리오는 결함의 종류별 규모와 형식을 통해 구성하고, 구성된 시나리오는 Table 1과 같다.

각 결함의 종류에 따른 규모를 균열(종, 횡 방향)은 0.1 mm부터 0.5 mm까지 0.1mm 차이로 각각 5개의 시나리오를 구성하였으며, 연결관 결함 및 관 파손에 대한 시나리오는 결함 여부에 따라 구분하여 각 2개의 시나리오를 생성하였다. 토사 퇴적 및 박리, 표면손상의 경우 결함의 면적을 0~100%까지 20%씩 증가하여 각 5개의 시나리오를 구성하였다. 구성된 상·하수도 결함 시나리오는 본 연구의 인공지능기법을 이용한 결함검출 기술의 학습 이미지 데이터로 사용하기 위해 Fig. 3과 같이 각 시나리오의 모형을 3D 프린트를 사용하여 제작한다.

제작된 모형은 원주 형태로 제작되며, 3D 프린트의 내부 채움 형태, 출력 속도 및 노즐 온도 등을 고려하여 출력의 완성도를 향상한다. 제작된 모형은 이미지 촬영을 통해 2.2절의 학습 이미지 데이터 처리 단계에서 학습 이미지 및 라벨링 과정이 수행된다.

Table 1.

Configuration of pipeline defect scenarios

2.2 학습이미지 데이터 전처리

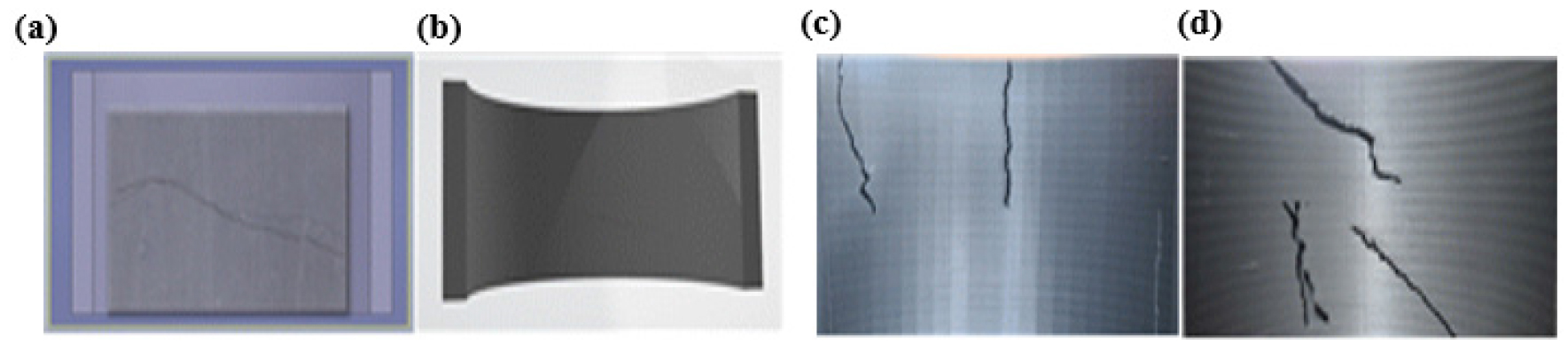

시나리오 기반 상·하수도 관로 실시간 결함검출 기술의 두 번째 단계는 학습이미지 데이터 전처리 및 데이터 학습 과정이다. 2.1절에서 구성된 결함 시나리오에 따른 3D 프린트를 사용한 결함 모형을 제작한 후 모형의 이미지를 촬영한 후 실제 상·하수도 관로 진단 시 확보된 이미지와 함께 학습데이터로 구성한다. 이때, 수집된 결함 이미지 데이터에서 검출하려는 객체의 클래스 지정 및 위치 좌표를 입력하는 등의 이미지 데이터 전처리를 수행한다. 이때, 이미지 데이터 학습을 위해 각 결함 이미지의 라벨링 툴(YOLO Mark)을 이용하여 객체의 클래스 지정 및 객체의 위치 좌표를 설정한다.

이후, 다양한 결함 이미지 데이터의 스케일과 균열 형태를 추출하고 결함의 심각도에 따라 Fig. 4같이 Risk 1과 Risk 2로 분류한다. Risk 1과 Risk 2는 「안전점검 및 정밀안전진단 세부지침」의 기준에 따라 분류하였으며, 균열의 경우 상·하수도 관로 내 허용균열 폭을 0.15~0.25 mm을 설정하여 최대균열 폭이 0.25 mm 이하인 경우 Risk 1으로 분류되며, 이상인 경우 Risk 2로 분류하였다. 또한, 연결관 및 이음부 결함(단차, 이탈)의 경우 문제의 유무에 따라 Risk 1과 2로 분류하였으며, 토사 퇴적 및 표면손상은 관 내부 이미지 중 면적의 비율을 기준으로 0~50%는 Risk 1, 50% 이상은 Risk 2로 분류한다.

이후, 데이터의 처리 속도 향상과 학습의 효율 향상을 위해 수집된 이미지 자료를 Gray scale로 변환 후 노이즈를 제거하는 전처리과정을 거친다. 일반적으로 카메라에서 캡처한 비디오 시퀀스 또는 이미지는 항상 RGB 형식으로 표시된다. RGB 형식의 이미지 데이터는 처리해야 할 데이터의 양이 상대적으로 커 학습 시 많은 소요 시간이 걸린다는 단점이 있다. 이러한 문제를 해결하기 위해 Gray scale로 변환하여 처리해야 하는 데이터의 양을 대폭 줄인다(Sajjanar et al., 2016). Fig. 5는 2.2장에서 수행한 학습 이미지 데이터 전처리 이후 데이터의 예시이다.

2.3 실시간 결함 진단모델

본 연구에서 3D 프린팅 결함 모델을 이용하여 실시간 결함을 진단하기 위한 기법으로 Deep Learning Single-Shot Multibox Detector (SSD) model (Magalhães et al., 2021)을 사용하였다. 관로 시스템의 이미지 또는 영상에서 결함을 분류하기 위해 최근 다양한 머신러닝 알고리즘이 적용되었다. Moselhi and Shehab-Eldeen (1999)는 역전파 신경망을 이용해서 반자동 결함 탐지 시스템을 도입하였으며, Sinha et al. (2003)은 Neuro-fuzzy network를 사용하여 하수관의 결함을 분류하는 기법을 제안하였다. 그 밖에도 Support Vector Machine (Mashford et al., 2008) 및 Multilayer Perceptron (Duran et al., 2007)과 같은 알고리즘이 결함 탐지에 활용되었다.

최근 몇 년 동안 컴퓨팅 성능의 급격한 증가로 인해 기존 미신러닝 기술에서 정확도와 학습속도의 향상을 목적으로 딥러닝 기술을 활용한 결함탐지 기법이 제안되었다. CNN (Convolutional Neural Networks) (Krizhevsky et al., 2017)은 이미지 분류 영역에서 일반적으로 사용되고 있으나, CNN의 표준 형식은 입출력 데이터가 고정된 형식이 아니기 때문에 객체 감지 문제를 수정하지 않고 사용할 경우 높은 탐지성능을 기대할 수 없을 뿐만 아니라, 객체 감지 문제의 출력에 대해 하나의 이미지를 처리하면 이미지에서 객체를 찾기 위해 하나 또는 다수 경계 상자와 관련된 감지된 객체(하나 또는 여러 개)의 분류를 제공해야 하는 번거로움이 존재한다. 따라서, 이러한 문제를 개선하기 위해 CNN에서 이미지 내의 객체를 감지하려는 경우 감지하려는 객체가 포함된 영역인 관심 영역(Region of Interest, RoI)을 결정한 후, 선정된 RoI를 특정 클래스로 분류해야 한다(Redmon et al., 2016). 그러나 모든 RoI를 찾는 데는 상당한 시간과 계산 리소스가 필요하기 때문에, 이러한 문제를 해결하기 위한 CNN의 확장 버전의 여러 알고리즘이 개발되었다(region-based CNN (R-CNN) (Girshick et al., 2014); fast R-CNN ( Girshick, 2015); fast R-CNN (Ren et al., 2015); SPP-net (He et al., 2016); Single Shot Detector (Liu et al., 2016); You Only Look Once (Redmon et al., 2016)).

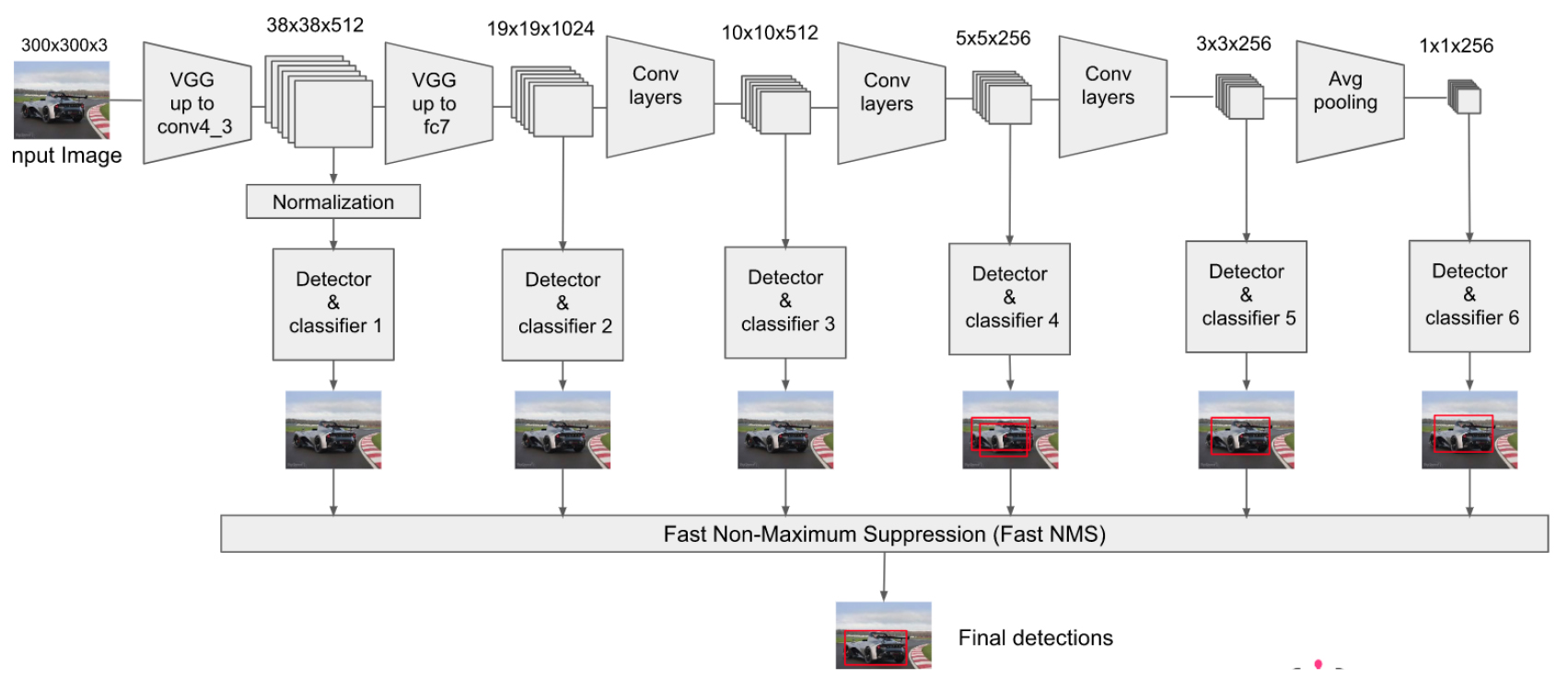

그중 SSD는 대표적인 객체 탐지 알고리즘으로 네트워크 중간 계층에서 다수의 피쳐맵을 활용하여 각 단계별 피쳐맵에서 모두 Object Detection을 수행하는 방식이다. SSD의 접근 방식은 고정된 크기의 Bounding Box 집합들에 대하여 해당 Bounding Box의 객체 존재 여부에 대한 점수를 생성하는 feed forward convolution network이며, Feature Map이 Convolution 연산을 거치면서 크기가 점점 작아진다는 점을 이용하여 큰 Feature Map에서는 작은 물체를 작은 Feature Map에서는 큰 물체를 검출하는 특징을 갖는다.

SSD는 먼저 300 × 300 크기의 이미지를 입력받아서 VGG의 Conv5_3층까지 통과하여 Feature를 추출한다. 이후 추출된 Feature map을 컨볼루션을 거쳐 다음 층에 넘겨주는 동시에 Object detection을 수행한다. 즉, SSD는 기존 컨볼루션을 거치면서 디테일한 정보들이 사라지는 문제점을 앞선 Feature map들을 끌어오는 방식에서 착안하여 각 단계별 Feature map에서 모두 Objective detection을 수행하는 방식을 적용한 것이다. 이를 자세한 그림으로 나타내면 Fig. 6과 같다.

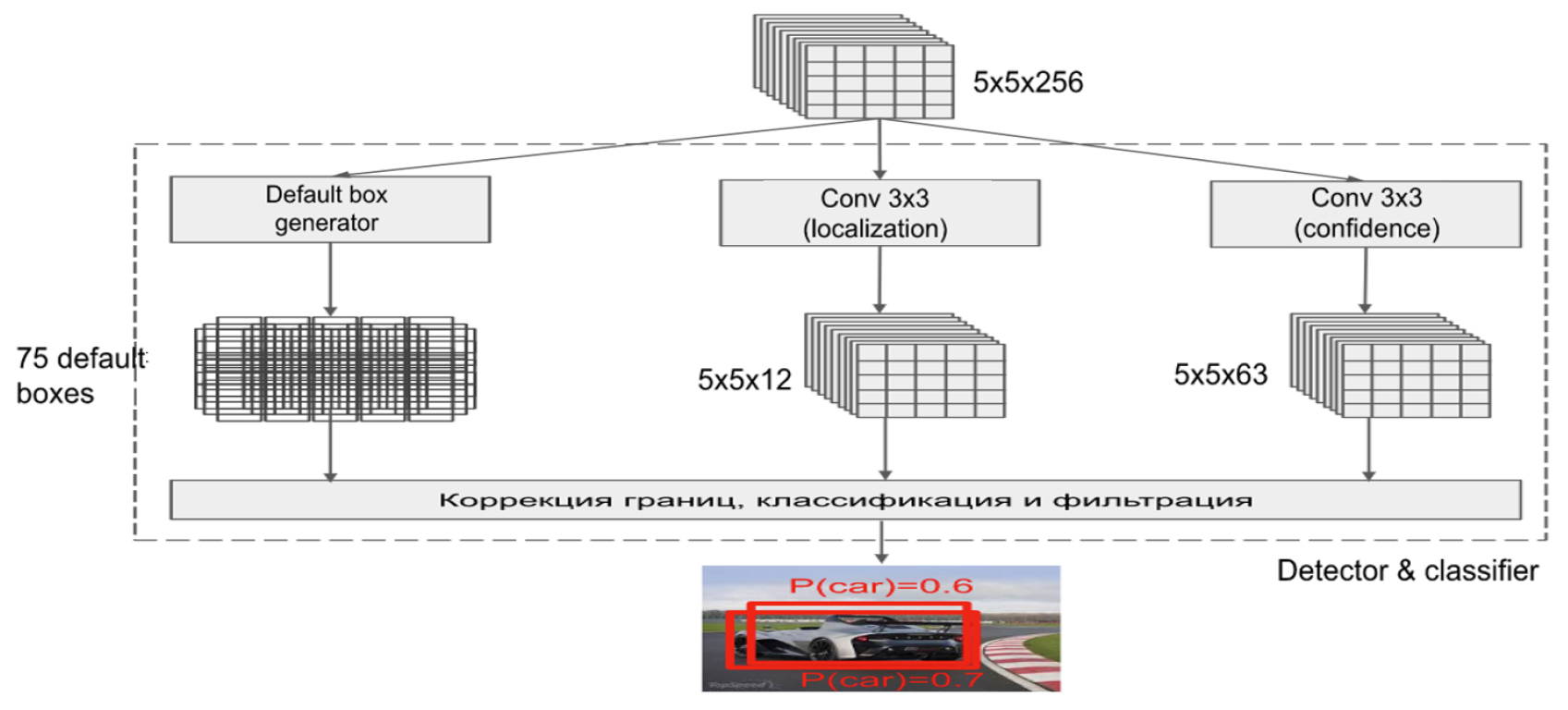

VGG를 통과하며 얻은 Feature map을 대상으로 컨볼루션을 진행하여 최종적으로는 1×1 크기의 Feature map까지 뽑은 후에 단계별로 추출된 Feature map은 Detector & Classifier를 통과시켜 Object detection을 수행한다. Fig. 7은 Detector & Classifier의 구조를 표현한 것이다. 컨볼루션 중간에 5×5×256 크기의 Feature map을 대상으로 Object detection을 수행한다고 가정하면 여기서 5×5는 그리드 크기에 해당하고 하나의 그리드마다 크기가 다른 Default box들을 계산한다. Default box란 비율과 크기가 다른 기본 박스를 우선 설정해놓아서 Bounding box를 추론하는 데 도움을 주는 장치이다. 이렇게 각 층별 Feature map들을 가져와 Object detection을 수행한 결과들을 모두 합하여 loss를 구한 다음, 전체 네트워크를 학습시키는 방식으로 One stage detector 모델을 구성한다. 각 Feature Map에서 위와 같은 과정이 반복되고 최종적으로 객체를 예측하게 된다.

3. 관로의 결함 데이터 학습 및 실시간 결함검출

본 연구에서는 상·하수도 관로에서 발생 가능한 각종 결함을 시나리오로 구성하고 이를 3D 프린트를 활용하여 결함모형 및 학습 이미지 데이터로 구성하여 관로 조사 시 실시간으로 결함을 검출할 수 있는 기술을 개발하였다. Fig. 7은 시나리오 기반 실시간 결함검출 시스템의 구조를 나타낸다.

우선, 제안된 기술은 4가지 과정을 통해 상·하수도시스템 실시간 결함검출이 가능하다. 첫 번째 과정은 관로의 결함 데이터(Defect Dataset)를 실제 진단과정에서 획득한 데이터와 3D 모델을 통해 구성한다. 실제 상·하수도 결함 데이터는 시스템의 진단 및 점검 수행을 위해 내시경 및 소형 드론, CCTV 등을 통한 영상 및 이미지에서 결함 데이터를 수집한다. 이때, 수집된 데이터는 정상 및 비정상 상태의 데이터를 모두 수집하여 Defect dataset으로 분류한다. 3D 모델링을 통한 결함 데이터 생성은 시설물 안전점검 및 정밀안전진단 매뉴얼을 고려하여 Table 1과 같이 결함 시나리오를 구성하고 각 시나리오의 결함의 특징 및 규모를 조합하여 발생 가능한 조합을 생성하였다. 이 조합을 고려하여 본 연구에서는 3D 프린트를 사용한 결함 모형을 제작하였으며, 제작된 3D 결함 모형의 촬영을 통해 이미지화하였다.

두 번째는 수집된 결함 데이터의 심각도에 따른 클래스 분류 및 결함 이미지를 캡처하여 객체 탐지 과정을 통해 수집된 Raw 데이터를 데이터 학습에 적합한 데이터로 변환한다.

세 번째 과정은 데이터의 학습, 검증 및 테스트 과정이다. 구축된 데이터베이스 데이터를 활용해 VGG-16 모델을 사용하여 트레이닝을 수행한다. 이때, 데이터 학습은 손상, 비 손상데이터 전체의 70%를 사용하여 수행하였다. 우선, 트레이닝 데이터 셋을 구성하기 위해서 앞서 결함 이미지 데이터와 정상상태를 고려한 이미지 데이터에 대해 손상유형(Risk1, Risk2), 비 손상유형 등으로 클래스로 나눠 트레이닝 셋을 구성한다. 손상유형에 해당하는 클래스는 균열 길이, 균열 원주, 관 파손, 연결관 돌출, 이음부 결함, 이음부 단차(이탈), 토사 퇴적, 표면손상으로 구성하고 비 손상유형에 해당하는 클래스는 관 내외부의 정상 이미지로 구성하여 데이터 학습을 수행한다.

이후 테스팅과정에서는 관로의 파손 ․ 손상을 자동 인식하는 데 얼마나 정확한 인식률이 수행되는지를 측정하여 시스템의 전체적인 성능을 측정하는 과정이다. 테스팅 과정은 앞서 구축된 전체 데이터 중에 10%를 테스트 데이터로 사용하고, 손상·비 손상데이터를 같은 비율로 포함하여 테스팅 데이터 셋을 구축하였다.

마지막 과정은 실제 관로의 진단과정에 해당 기술을 적용하여 실시간 결함을 검출하여 각 클래스에 대한 인식률을 확인하고 이를 통해 모델의 epoch 등의 값을 조절함으로써 Overfitting 또는 Underfitting을 줄여 최적의 결함검출 모델로서 매개변수를 조정한다.

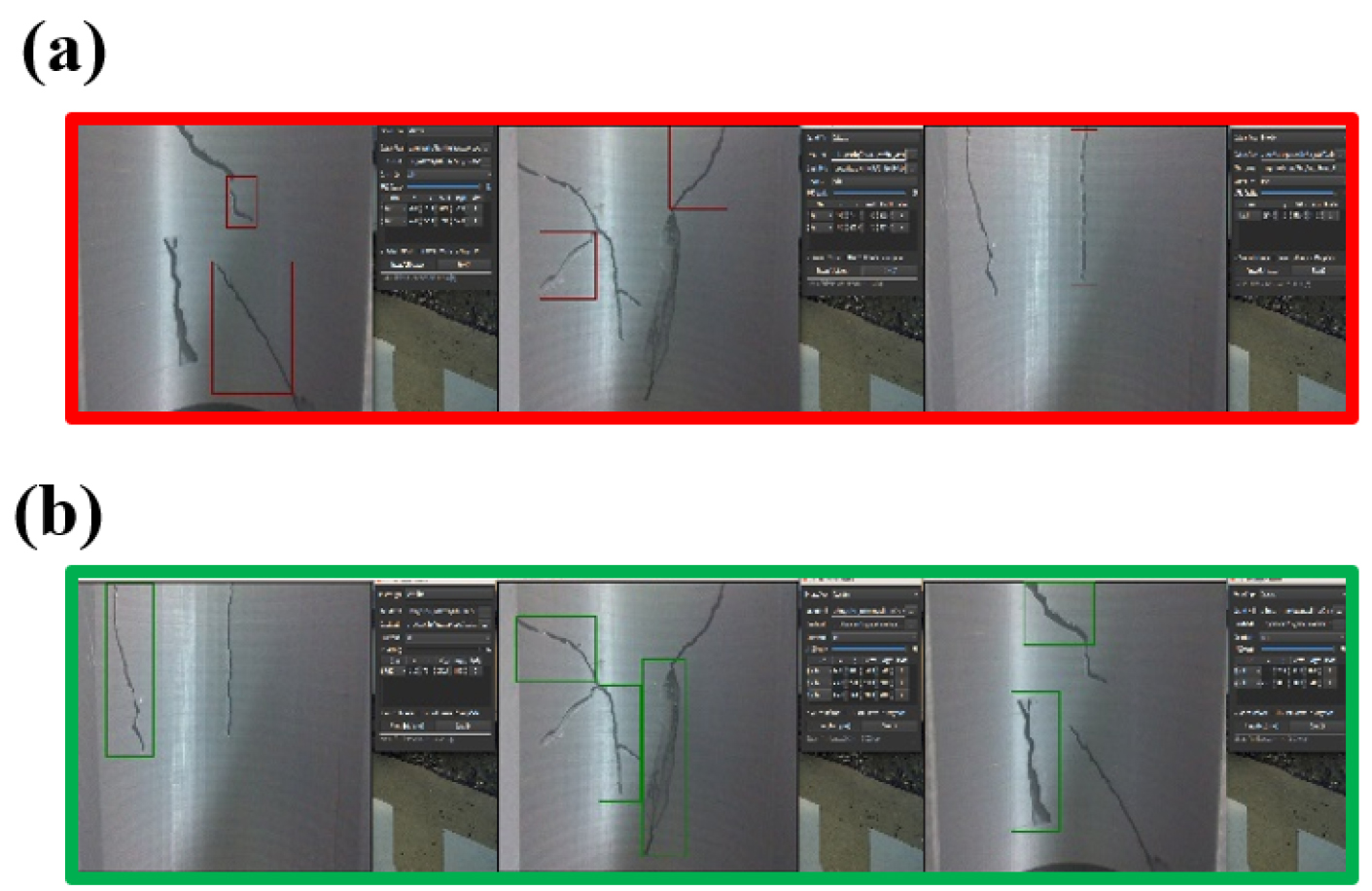

본 연구에서는 앞서 개발한 결함 시나리오에 따른 관로의 실시간 결함검출을 수행하였으며, 결함검출 결과는 훈련된 모델을 사용하여 Table 1과 같이 7개의 시나리오에 대한 인식률을 도출하였다. 최초 데이터 학습 시 모델의 epoch와 batch는 각각 50, 64로 설정하였으며, 인식률의 손실 정도를 고려하여 모델의 epoch 등의 값을 조절함으로써 Overfitting 또는 Underfitting을 줄여 최적의 딥러닝 모델을 구축을 수행하였다. 트레이닝 인식률 및 검증 인식률은 Logistic Regression을 사용하여 각 결함에 따라 인식률이 50% 이상일 경우 해당 결함이 Risk 1 또는 Risk 2로 인식이 되었다고 판단한다. 트레이닝 손실 및 검증 손실은 epoch가 20 이후에 현저하게 0.25 미만으로 감소함 인식률과 손실은 90.6%에서 0.1 손실 미만으로 멈출 때까지 점진적으로 개선되고 안정적으로 이후에 안정적으로 유지된다. 가장 높은 검증 인식률을 보일 때는 epoch가 49일 때 90.6%의 가장 높은 검증 인식률을 확인할 수 있으며, 이로 인해 epoch 49의 최적 매개변수를 설정하였다. Table 2에서 확인할 수 있듯이 실시간 결함검출 결과 각 결함 시나리오에 대한 평균 인식률은 86.9%인 것을 확인할 수 있다.

각 시나리오에 대한 인식률을 살펴보면 균열(관로 측 평행), 균열(관로 측 수직), 연결관 돌출, 토사 퇴적 및 박리, 표면손상, 관 파손 등의 결함 인식률 중 연결관 돌출의 결함 탐지 인식률이 95.0 %로 가장 높은 인식률을 보인다. 이는 균열(관로 측 평행) 대한 시나리오의 인식률의 경우 전체 이미지 90장 중 81장의 Risk 클래스를 정확히 인식하였다는 것을 알 수 있다. 결함의 위험도 측면에서는 Risk 1 인식률이 91.8 %로 Risk 2(85.1 %)보다 높은 인식률을 나타낸다. 이는 균열(관로 측 평행) 대한 시나리오의 인식률의 경우 전체 이미지 90장 중 81장의 Risk 클래스를 정확히 인식하였다는 것을 알 수 있다.

Table 2.

Real-time defect detection results for each defect scenarios

4. 결 론

본 연구에서는 상·하수도 관로의 효과적인 결함검출을 위해 실시간 상·하수도 관로 결함검출 기법을 제안한다. 제안된 실시간 상·하수도 관로 결함검출 기술은 기존에 확보되지 않은 다양한 결함을 크기, 종류, 형태, 수 등을 복합적인 시나리오를 3D 프린트로 구현하여 촬영된 이미지를 수집된 상·하수도 관로 결함 데이터와 함께 학습데이터로 사용하여 학습데이터의 다양성을 확보하였다. 이후 데이터의 전처리과정을 통해 학습에 따른 Feature에 균열의 형태와 크기만이 영향받도록 Gray 스케일로 변환하고 객체의 검출과 심각도에 따른 Risk 분류 등을 수행하였다. 이후 데이터를 통한 모델 학습 및 테스트는 Deep Learning 모델 중 객체 탐지에 용이한 Single-Shot Multibox Detector model을 사용하여 수행하였다.

본 연구에서 적용한 상·하수도 관로 결함 시나리오는 관로 균열, 연결관 불량, 토사 퇴적 등 7가지 시나리오를 구성하여 총 26개의 cases에 대해 3D 모델을 제작하였으며, 수집된 결함 데이터와 함께 630개의 이미지가 학습 데이터로써 사용되었다. 실시간 결함검출 결과, 각 시나리오별 인식률은 80.0~91.0 %의 범위 내로 나타났으며, 그 결함 인식 중 연결관의 돌출이 가장 높은 인식률을 나타내는 것으로 확인되었다. 또한, 균열의 심각도에 따라 분류된 결과는 상대적으로 적은 결함을 나타내는 Risk 1의 인식률이 91.8 %로 높은 인식률을 보인다. 이러한 결과는 기존 학습데이터 수집에 어려운 상·하수도 관로 결함 데이터의 다양성을 확보한 결과로 판단된다. 본 연구는 수집 가능한 손상 ․ 파손의 유형 이외의 복합적인 관로의 결함에 대해서 정의를 내리고 클래스를 추가함으로써 다양하고 발생이 어려운 관로의 결함에 대해서도 좀 더 정확한 인식률을 기대할 수 있는 기법으로 판단된다. 하지만, 본 연구에서는 결함검출의 성능 향상과 신속하고, 효과적인 관로 진단을 위해서 몇 가지 개선사항을 제안할 수 있다.

향후 결함검출 성능을 더욱 향상시키기 위해 더 많은 결함 데이터의 수집이 이루어져야 할 것이고, 더 세분화할 수 있는 클래스 분류의 연구도 이루어져야 한다. 또한, 결함 유형에 대한 자동 등급 분류 알고리즘을 통해 영상이나 이미지 데이터에서 결함의 심각성에 대해 분류하여 등급을 나누어 등의 데이터 전처리 기술이 필요하다. 마지막으로 개발된 알고리즘의 공유를 위해 클라우드 서비스를 활용하거나 자체적으로 알고리즘을 공유할 수 있는 서버 시스템을 구축한다면 데이터 수집과 학습 모델의 성능이 향상될 뿐 아니라 시공간적 제약 없이 해당 기술의 활용이 가능하며, 이를 바탕으로 관로 결함검출 시 작업자의 숙련도나 진단 누락 가능성을 최소화하며 기존의 상·하수도관 진단업무의 처리능력을 향상시킬 수 있을 것으로 판단된다.