1. 서 론

정지궤도위성에서 촬영된 사진으로부터 대기운동벡터(Atmospheric Motion Vector)를 추출하는 기술은 정지궤도위성이 처음 발사되었던 1970년 초반부터 실용화되었다(Menzel, 2001). 대기운동벡터는 대기 순환을 정량적으로 나타내는 지표로서 풍속장으로 활용되어 자료동화를 통한 기후 예측의 정확도를 높이는 역할을 한다. 특히, 열대성 저기압과 같은 강한 풍속장이 동반되는 극한 기후 사건이 발생했을 경우, 태풍의 경로, 강도 및 구조 등의 정교한 예측은 피해를 최소화할 수 있는 중요한 수단이다. 세부적으로 대기운동벡터의 자료동화는 수치예보모델의 초기 조건(Le Marshall et al., 2017)과 태풍 경로 및 태풍 구조(Langland et al., 2009; Berger et al., 2011; Velden et al., 2005)의 예측 정확도를 향상시킨다고 알려져왔다. 또한, 인공위성 카메라 센서 기술의 급격한 발전은 위성사진의 시공간적 분해능을 증가시키고 이는 곧 대기운동벡터의 품질 향상으로 이어진다. 이러한 고품질의 대기운동벡터는 태풍 경로 및 구조 예측 정확도 개선 외에도 태풍 중심 기압 및 중심 기압 이동 경로 예측의 정확도 향상에도 크게 기여하였다.

특히, 국내 연안지역에서는 태풍 및 동반되는 강우뿐만 아니라 강풍에 의해 다양한 피해가 발생하며, 이에 따라 연안지역에서의 대기운동벡터를 정확하게 산출하는 것은 태풍의 구조 및 이동 특성을 이해하는 데 중요한 기초 자료가 되고, 향후 월파량 또는 해안 침수심 추정을 위한 수치모델 연구에서 활용될 수 있다. 현재 국내 해안 지역에 존재하고 풍속의 직접적인 측정이 가능한 라디오존데 관측소는 강릉, 속초, 포항, 제주 등 11개 지점으로 전체 해안지역의 길이에 비해 매우 제한적이다. 또한, 라디오존데 관측값은 측정고도에 따른 정교한 풍속 데이터를 제공하는 반면에 동일고도 인접한 지점에서의 풍속은 제공하지 않기 때문에 지면과 평행한 바람의 평면적 움직임에 따른 회전 등은 알 수 없다.

대기운동벡터는 일반적으로 연속된 위성사진의 구름 또는 수증기 추적자를 추적하여 산출한다. 미국 등 정찰용 비행기를 이용한 직접적인 풍속 측정 장치가 구비된 지역을 제외한 북태평양 지역에서 위성사진을 이용한 대기운동벡터 산출기법은 상당히 폭넓게 사용되고 있다. 위성사진들은 주로 정지궤도위성의 적외선 채널에서 촬영된 영상을 여러 장의 프레임으로 분해하여 취득한다. 이전 연구에서 주로 적용되었던 대기운동벡터 산출방법은 크게 패턴인식(pattern recognition), 광학흐름(optical flow), 상호연관(cross-correlation) 방법으로 구분될 수 있다. 패턴인식 방법(Endlich and Wolf, 1981)은 라그랑지안 프레임 접근방법을 사용한 산출기법으로 적운, 적란운과 같은 대류성 구름의 이동 속도를 구하는데 효과적이고 광학흐름 방법(Vega-Riveros and Jabbour, 1989)은 위성사진 픽셀들 밝기 패턴의 변화를 추적하여 광학흐름 구속조건 방정식을 풀어 흐름의 패턴을 결정한다. 가장 폭넓게 활용되고 있는 상호연관 방법은 유체 속도장을 측정하는 대표적인 기법인 입자영상유속계(particle image velocimetry)에서 사용하는 방식으로 시간적으로 연속된 작은 추적영역에서의 추적입자들의 위치를 상호연관시켜 해당 영역에서의 지배적인 속도 벡터를 산출하는 기법을 의미한다. 유체 안에 투입된 고체 입자들을 추적하는 입자영상유속계와는 다르게 위성사진에서는 구름들의 경계면을 추적하는 방식이 사용된 바 있다(Chuang et al., 2019).

사실 태풍으로 인한 연안지역의 피해를 저감하기 위해서는 미리 대비하기 위해 대기운동벡터의 산출 정확도를 높이는 연구에서 더 나아가 대기운동벡터의 예측이 중요하다. 인공지능을 활용한 위성사진 기반 태풍 경로 예측 연구는 2000년대 초반부터 시작되었다. Lee and Liu (2000)는 위성사진을 사용하여 드보락 태풍 강도, 최고풍속 및 태풍 위치 등의 정보를 얻고 이를 학습하여 태풍 경로를 예측하였다. 저자들이 조사한 바로 위성사진들을 직접 학습시켜 태풍 특성을 예측하는 연구들은 대부분 2010년대 이후에 수행되었다고 판단된다. Hong et al. (2017)은 다층 인공신경망을 사용하여 태풍의 눈의 위치를 학습하였고 Kordmahalleh et al. (2016)와 Alemany et al. (2018)는 RNN (recurrent neural network)를 사용하여 태풍 경로를 학습시켜 예측 모델을 제시하였다. 또한, Zhang et al. (2018)과 Giffard-Roisin et al. (2018)은 각각 MNN (matrix neural network)과 FNN (fused neural network)를 사용하여 6시간 이후까지의 태풍 경로 예측 모델을 제안하였다.

본 연구에서는 Goodfellow et al. (2014)에 의해 개발된 생성적 적대 신경망(GAN)을 사용하여 천리안 1호와 천리안 2호에서 취득한 태풍 위성사진들을 학습시켜 위성사진을 예측하고 예측된 사진들을 상호연관시켜 대기운동벡터를 추출하였다.

2. GAN 기반 대기운동벡터 예측

2.1 GAN 기반 위성사진 예측

본 연구에서는 Mathieu et al. (2015)가 제시한 심화 다중 스케일 프레임 알고리즘을 사용하여 기상청으로부터 제공받은 태풍 위성사진들을 학습시켜 Generative Adversarial Network (GAN) 모델을 구축하였다. 이때 GAN은 생성자와 판별자로 구성된 심층신경망 구조로, 두 네트워크가 상호 경쟁적으로 학습함으로써 실제 유사한 데이터를 생성하는 기법이다. 태풍 위성사진 데이터 세트는 2003년부터 2018년까지 운영된 36,000 km 고도 상 정지궤도위성인 천리안 1호의 파장 10.8 µm 적외채널(IR1)을 이용하여 촬영된 영상으로 구축하였다. 기상청으로부터 제공받은 천리안 1호 촬영 영상 이미지들의 시간 해상도는 15분이고 공간 해상도는 2 km이다. 해당 데이터 세트는 비교적 최근인 2011년부터 2019년까지 Saffir-Simpson scale 4 이상의 한반도 주변 태풍 68개의 발생부터 소멸까지의 기간 동안의 위성사진들을 포함하였다. 따라서, 데이터 세트는 총 15,683장의 위성사진들로 구성되었으며, 이 중 52개 태풍 사례에 해당하는 12,309장의 위성사진들(약 78%)을 training에 사용하고, 16개 태풍 사례에 해당하는 3,374장의 위성사진들(약 22%)을 test에 사용하였다. 이는 데이터를 70:30의 비율로 training과 test에 분배하는 일반적인 경우를 참고하여 이와 같이 설정하였다.

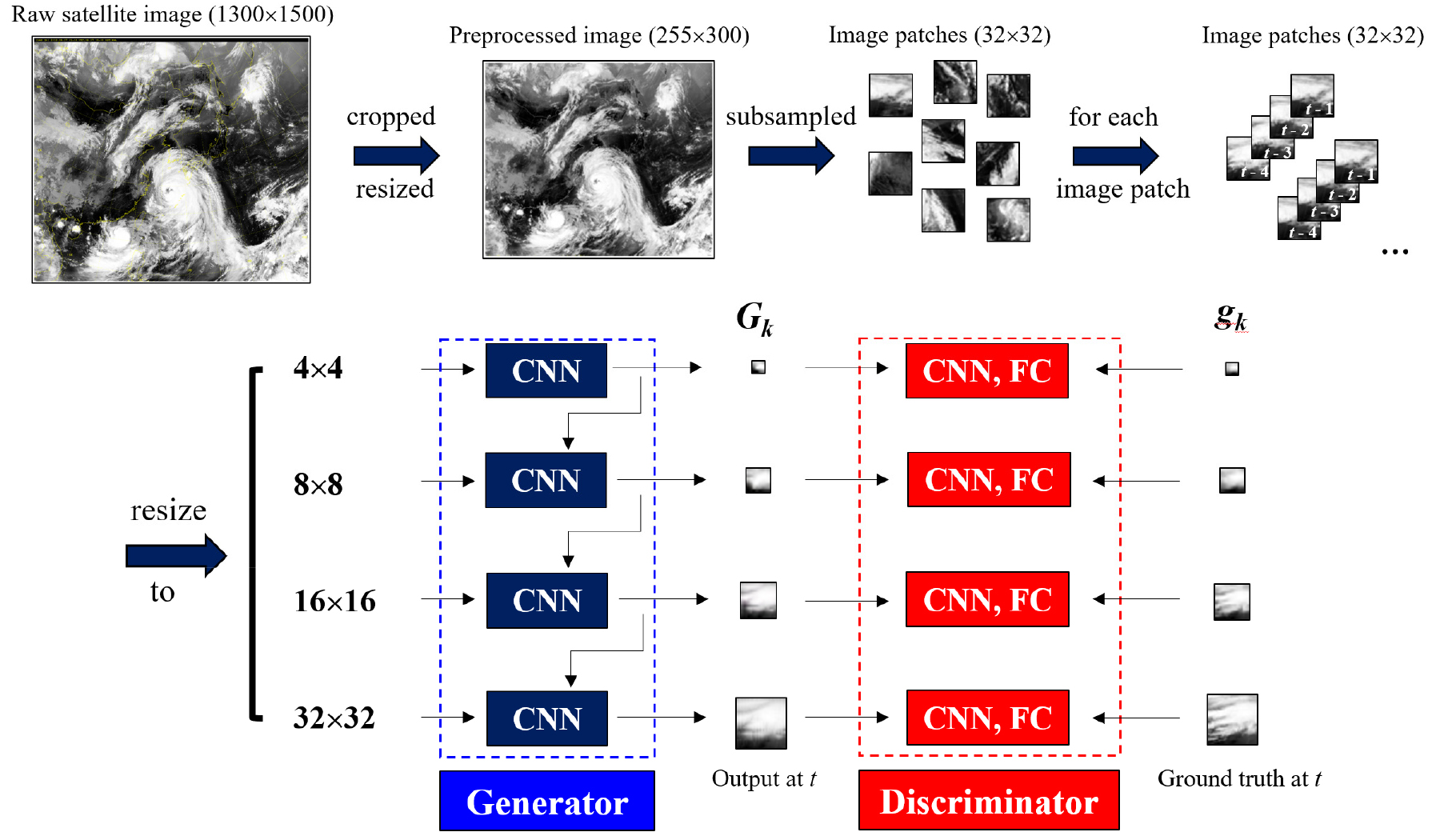

Fig. 1과 Table 1은 각각 본 연구에서 위성 사진 예측을 위해 구현된 개략적인 심화 다중 스케일 프레임 알고리즘과 사용된 네트워크 아키텍처 및 필터 크기를 보여준다. 원본 영상으로부터 추출된 이미지들은 GAN 루틴을 실행하기 전 아래와 같은 전처리 과정 즉, RGB 컬러 이미지로 구성된 위성 이미지 각각의 최상단 날짜 및 시간 부분을 잘라서 제외하고 노란색으로 표시된 국가 경계를 흰색으로 바꾼 뒤 이미지를 회색조로 변환하는 과정을 각각의 이미지에 적용하였다. 또한, 전처리가 끝난 이미지들은 계산시간을 유의미하게 줄이기 위해 1/5 크기로 저해상화하여 GAN 알고리즘을 실행하였다. 본 연구에서는 위성 이미지 자체의 예측에서 더 나아가 상호연관을 통해 연속된 이미지들로부터 대기운동벡터를 산출하는 목적을 가지고 있기 때문에 조밀한 시간 해상도 또한 중요하다. 즉, 연속된 이미지들의 시간 간격이 너무 크면 추적해야 하는 입자들이 이미지에서 아예 벗어나 버리기 때문에 추적이 불가하게 된다. 또한, 15분 간격의 원본 위성 영상에 때때로 결측 이미지들이 있었기 때문에 일관성을 위해 결측 이미지가 거의 없는 이보다 큰 적정 시간 간격을 고려하였고, 따라서, 본 연구에서는 대기운동벡터 산출을 위한 상호연관 과정에서 연속된 위성영상 간 시간 간격을 1시간으로 설정하였다. 한편, 생성적 적대 신경망(GAN)을 이용한 위성영상 프레임 예측은 원본 위성영상의 시간 해상도인 15분 간격을 기준으로 수행하였다.

Fig. 1.

Schematic of GAN-based frame prediction technique and hyper parameters used in the current study (adopted from Na and Son, 2021)

Table 1.

Network architecture of the generator and the discriminator applied in the current study. The generator model is fully convolutional with the filters (kernels) of sizes 3×3, 5×5, and 7×7. The discriminator model is structured in the orders of convolutional layers, max pooling layers, and fully connected layers

Fig. 2는 epoch 수에 따른 심화 다중 스케일 프레임 알고리즘을 사용해 예측된 MUIFA (2011)의 위성 이미지들의 예시를 보여준다. Mathieu et al. (2015)의 프레임 예측 알고리즘은 Fig. 1에 나타난 바와 같이 전처리된 이미지들을 여러 개의 이미지 조각들로 나누고 CNN 필터를 통과시킴으로 각 조각들의 시간 흐름에 따른 변화 정도를 학습한다. 따라서, 연속적이고 촬영 시간이 다른 동일 위치 조각들을 그룹화시켜 학습하게 되는데 이때 시간 범위를 어떻게 설정하는가에 따라 예측 시간 범위 또한 비례해서 달라지게 된다. 본 연구에서는 계산시간과 예측 정확도를 고려하여 조각들 4개를 그룹화하여 학습시켰다. 따라서, 예를 들어 구축된 모델에 임의의 시간 t-4, t-3, t-2, t-1에 촬영된 위성 이미지들을 입력시키면 t, t+1, t+2, t+3에 예측된 위성 이미지들이 얻어진다. 단, t+1, t+2, t+3에 예측된 이미지들은 실측 이미지들을 제외하고 차례로 각각 1개(t), 2개(t, t+1), 3개(t, t+1, t+2)의 예측 이미지를 포함해서 그룹 입력값으로 사용하기 때문에 이미지 품질이 저하된다. 이미지 품질 저하는 epoch 수를 증가시킴으로써 완화되었는데 태풍 MUIFA (2011)의 예를 보면, epoch수를 100배 증가시켰을 때, t에 예측된 이미지의 품질은 큰 차이가 없지만 t+3에 예측된 이미지의 품질을 눈에 띄게 향상시켰다는 것을 육안으로 관찰할 수 있다(Fig. 2).

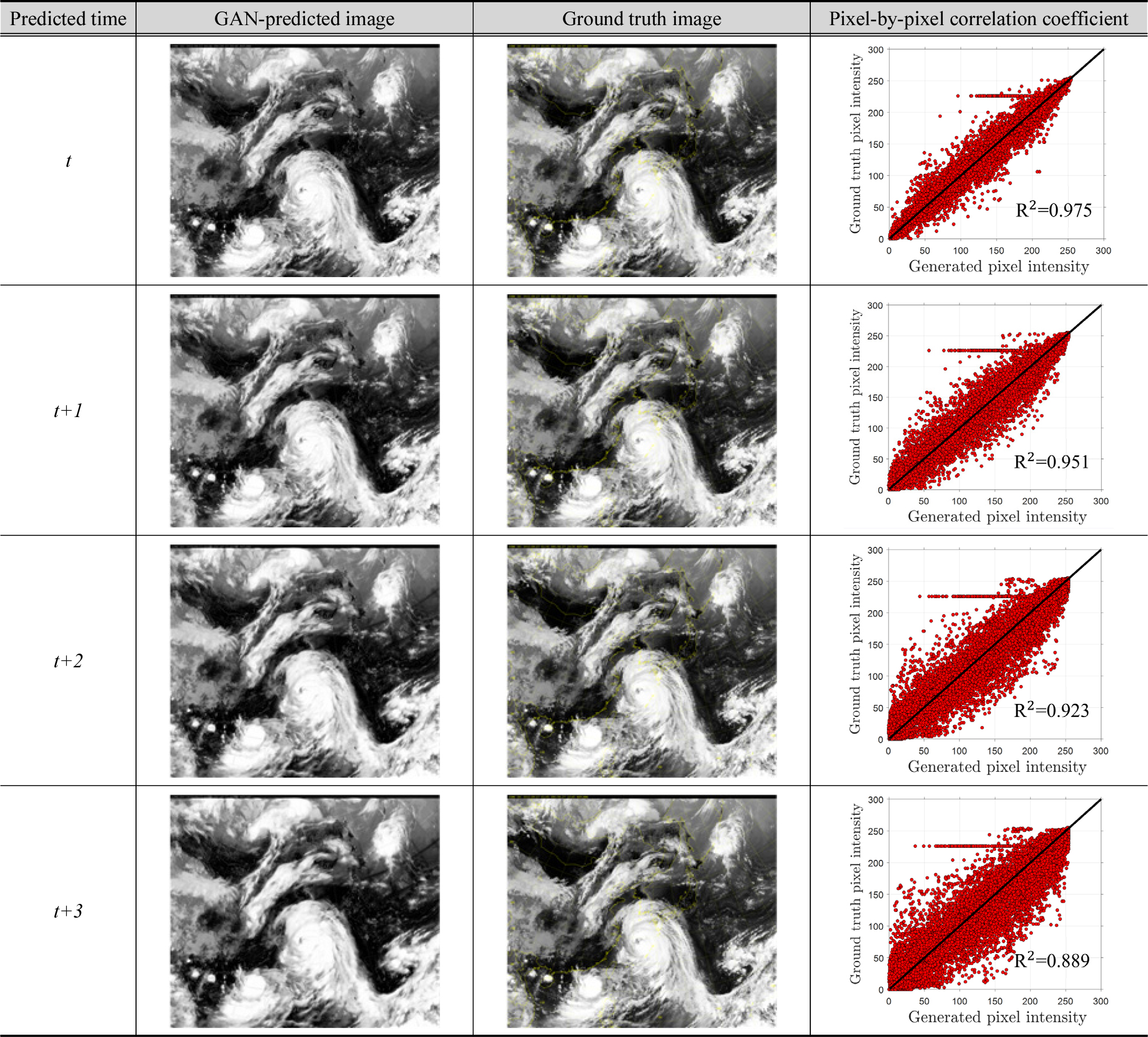

Fig. 3는 태풍 BOLAVEN (2012)의 경우, epoch수를 1,000, 000으로 설정했을 때 예측 이미지들과 실제 이미지들을 정성, 정량적으로 비교한 결과를 보여준다. Fig. 2와 비교했을 때, GAN 예측 이미지와 실제 촬영 이미지와의 비교를 통해 적정한 epoch수를 설정할 경우 예측 성능이 크게 저하되지 않는 것을 확인할 수 있다. 정확도를 정량적으로 비교하기 위해 이미지 각 픽셀 당 밝기(0~255)를 동일 픽셀 위치에서 비교한 결과를 픽셀 상관도로 나타내었을 경우 t 예측에서 상관계수가 0.975에서 t+3 예측에서는 0.889로 0.1정도 감소하는 것을 확인하였다. 단, 모든 픽셀 밝기 상관도에서 y축 픽셀 밝기 약 230에서 수평으로 유지되는 경향을 볼 수 있는데 이는 실제 촬영 이미지에서 노란색으로 표시된 우리나라의 경계가 존재하기 때문에 나타나고 이것은 상관계수 계산에서 제외하였다.

Fig. 3.

Sample comparison of GAN predicted and ground truth satellite images, and corresponding pixel intensities with correlation coefficients where y-axis is the pixel intensity of ground truth images and x-axis is the pixel intensity of GAN predicted images. Solid y=x line is shown to represent a perfect match. This comparison is for the case of BOLAVEN (2012)

Fig. 4는 본 연구에서 검증 데이터로 사용된 태풍 중에 t에 예측된 몇 가지 샘플 위성사진에 대한 픽셀 밝기 정확도 검증 결과이다. 사진 비교 결과 대기운동벡터 예측에 중요한 구름 질감이 실제와 매우 유사하게 예측되었고 정량적 비교를 위해 픽셀 밝기 비교 결과 상관계수가 0.968에서 0.982 범위 내로 비교적 정밀한 위성사진을 생성했다는 것을 확인하였다

2.2 대기운동벡터 산출

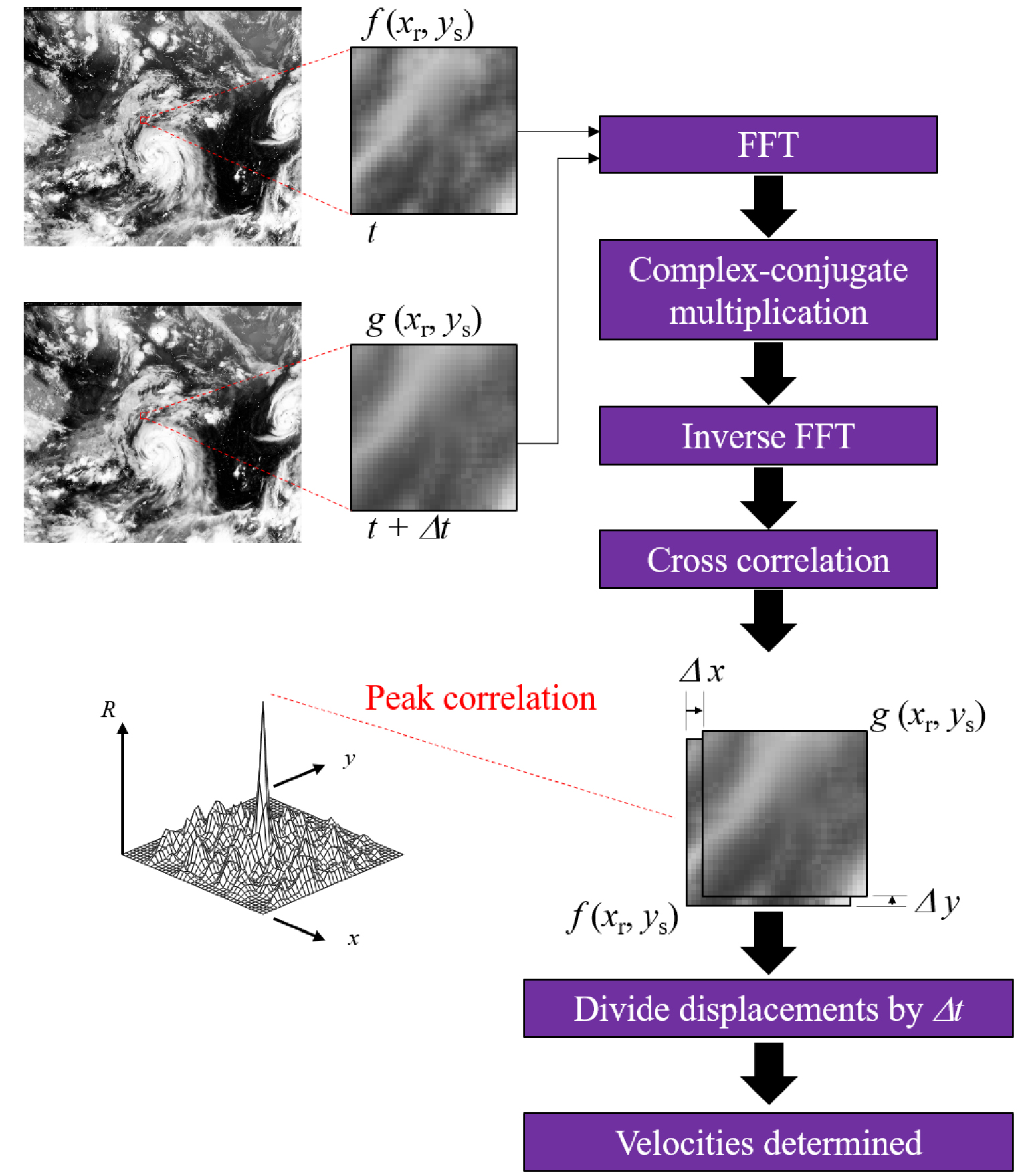

Fig. 5는 GAN으로 예측된 위성사진을 사용하여 대기운동벡터를 산출하는 과정을 보여준다. 입자영상유속계에서 사용하는 상호연관 방법은 하나의 이미지를 여러 개의 정사각형 조사영역으로 나누어 연속된 2개의 이미지에서 같은 조사영역간의 상호연관계수를 최대화시키는 조사영역 간의 시프팅 거리를 산출함으로써 하나의 유속벡터를 구하는 방법이다 (Lim et al., 2015; Na et al., 2016 등). 또한, 상호연관 과정에서 다중패스(multi-pass) 상호연관 필터를 적용하였다. 초기에는 큰 조사영역을 사용해 태풍 구름의 비교적 큰 변위를 안정적으로 추정하고, 이후 조사영역을 단계적으로 축소하면서 반복 계산하여 국지적인 변위까지 정밀하게 산출하였다. 이러한 필터 구성은 태풍 영역에서 공존하는 대규모 이동과 국지적 전단 구조를 동시에 포착하고, 단일 패스에서 발생할 수 있는 추적자의 손실과 잡음을 줄이기 위해 선택되었다. 본 연구에서는 태풍 영향지역의 빠른 풍속을 고려하여 초기 조사영역을 32px×32px로 설정하고 4개의 통과필터를 순차적으로 적용하고 중복구간을 50%으로 설정하여 최종 대기운동벡터의 공간해상도는 4px×4px, 즉 약 8 km×8 km으로 결정하였다.

Fig. 5.

Schematic of computing atmospheric motion vectors using cross-correlation similar to a process in particle image velocimetry (PIV) (adopted from Na and Son, 2021)

2.3 대기운동벡터 검증

Figs. 6(a) and 6(b)는 태풍 NEOGURI (2014)와 LEKIMA (2019)의 경우에 GAN 예측 이미지들과 실제 촬영된 위성 이미지(ground truth)를 각각 상호연관하여 산출된 대기운동벡터, 그리고 수치예보(Numerical Weather Prediction, NWP)로 계산된 대기운동벡터와 비교한 결과이다. 이때 수치예보(NWP)란 대기의 운동·열역학 방정식을 수치적으로 계산하여 풍속, 기압, 온도 등의 미래 상태를 예측하는 물리 기반 기상모델을 의미한다. 수치예보 계산으로 산출된 대기운동벡터에 비해 위성 이미지 기반 대기운동벡터는 시간에 따른 구름의 명암 변화가 크지 않은 지역에서의 벡터가 잘 산출되지 않는 단점이 있다. 저명암·저대비 구름에서는 위성영상 내 밝기 변화가 작아 상호연관 기반 추적에 필요한 특징이 충분히 형성되지 않아 변위 추정의 불확실성이 증가한다. 이러한 조건에서는 GAN 예측 영상의 질감 평활화 효과가 함께 작용하므로, 반복 학습을 충분히 수행하여 공간적 구조 재현성을 보완할 필요가 있다. 다만, 이러한 지역은 풍속이 낮기 때문에 구름의 운동이 적다고 추정할 수 있기 때문에 덜 주목받는 지역이라고 유추할 수 있다. 반면에 이미지 기반 산출방법을 사용할 경우, 태풍의 직접적인 영향권이라고 할 수 있는 태풍의 눈부터 영향반경까지 비교적 튀는 벡터들이 없이 공간적으로 균일한 벡터들이 산출됨을 확인할 수 있다.

Fig. 6c와 6d는 이미지 기반 산출 결과와 수치모델 계산 결과를 유일한 실측값이라고 할 수 있는 라디오존데 관측값과 비교한 예시이다. 두 가지 태풍 예시 모두 GAN 기반 벡터의 크기 및 방향이 NWP 기반 벡터보다 상대적으로 실측 벡터와 유사한 것을 확인할 수 있다. 특히, GAN 기반 벡터의 경우 벡터의 크기 즉 풍속을 수치모델보다 실측값에 가깝게 예측한 것을 볼 수 있다.

Table 2은 국내 기상청이 관할하는 라디오존데 관측 지점 중 해안 지역에 위치한 6개 지점들의 대기운동벡터와 대기운동벡터를 산출한 고도에서 관측된 풍속 크기와의 평균벡터편차(Mean Vector Difference)와 평균제곱근오차(Root Mean Square Error), 그리고 표준편차(Standard Deviation)를 계산한 결과를 나타내었다. MUIFA (2011), BOLAVEN (2012)과 KILO (2015)를 제외한 5개의 태풍에서 NWP에 비해 GAN 기반 풍속의 크기의 관측값과의 오차가 현저히 줄어든 것을 확인할 수 있다. MUIFA (2011), BOLAVEN (2012)과 KILO (2015)는 국내 해안에 접근할 당시 비교적 구름의 명암 변화가 적어 오차가 발생한 것으로 추정된다.

Table 2.

Comparisons of the GAN predicted AMVs and NWP-derived wind fields against radiosonde wind speeds where Vector Difference (VD) and Mean Vector Difference (MVD), Root Mean Square Error (RMSE), and Standard Deviation (SD) is defined respectively as , , and . =1, 2, 3, 4, 5, 6 denotes each 6 observation station operated by Korean Meteorological Agency. VD, MVD, and SD are calculated both using GAN-derived and NWP-calculated velocities with respect to the radiosonde velocities.

마지막으로 Fig. 7에서 MUIFA (2011), BOLAVEN (2012)과 같이 구름의 명암 변화가 적을 때 GAN 기반 풍속장의 일정 수준의 정확도를 유지하기 위한 GAN 알고리즘의 최소 epoch (i.e. iteration) 수를 결정하기 위해 반복 횟수에 따른 MVD와 SD를 비교한 결과를 나타내었다. 그림에서 보여지듯이 적어도 700,000 이상 반복을 실행했을 때 MVD와 SD가 6 m/s이하로 유지됨을 확인할 수 있었다. 또한, 구름의 명암변화가 뚜렷한 다른 태풍의 경우 약 100,000번 정도의 반복이면 충분한 일정 수준 이하의 오차를 유지할 수 있다고 확인하였다. 하지만 iteration을 높이면 과적합에 대한 우려가 있다. 만약 과적합이 발생하면 추적자의 수가 부족해지고 예측된 사진이 명암변화 없이 검정색으로 나타나는 경향이 있다. 이를 해결하기 위해 본 연구에서는 다중 통과 방식(multi-pass)을 사용했다. multi-pass는 더 큰 조사구간(interrogation window)에서 더 작은 조사구간으로 단계적이고 선택적인(adaptive) 상관관계 처리가 수행된다.

3. 결 론

본 연구에서는 2차원 생성형 AI기법인 생성적 적대 신경망(GAN)과 상호연관 기법을 융합하여 위성사진과 대기운동벡터를 예측하는 방법을 제시하고 관측값과의 비교를 통해 범용성을 검증하였다. 특히, 본 연구는 위성사진을 기반으로 국내 해안 지역에서 태풍으로 인한 폭풍해일의 성장에 큰 영향을 미치는 2차원 풍속장의 예측이 가능하다는 점에서 향후 관측점의 수가 적고 점 측정에 국한된 풍속 정보를 보완하는 역할을 수행할 것으로 기대된다.

세부적으로 본 연구는 과거에 발생한 68개 태풍의 위성영상을 GAN을 사용한 프레임 예측 AI모델에 학습시켜 최대 1시간 이후의 위성사진을 예측할 수 있는 모델을 구축하였고, 검증 데이터에 적용하여 15분 후에 예측된 위성사진과 실제 위성사진과의 상관계수가 90%이상의 성능을 보여주었다. 또한, 이와 같이 예측된 시간에 따라 연속된 위성사진을 상호연관 기법을 사용하여 대기운동벡터를 산출하였다. 산출된 대기운동벡터는 수치예보로 계산된 대기운동벡터에 비해 라디오존데 관측값과의 오차가 크게 줄어듦을 확인하였다. 단, 위성사진에서 보여지는 구름의 이동이 매우 적을 경우, GAN 알고리즘의 iteration 횟수를 약 700,000번 이상으로 설정해야 일정 수준 이상의 벡터 정확도를 유지할 수 있다고 판단되었다.

후속 연구에서는 관측자료 대비 오차를 줄이기 위해, GAN 학습자료를 최적화하여 더 선명한 예측 위성영상을 생성하고, 예측 영상에 상호연관 기법을 적용해 풍속장(AMV 기반 2차원 풍속장)을 안정적으로 산출하는 절차를 고도화할 예정이다. 또한, 산출된 풍속장을 기존에 널리 사용되어 온 Holland (1980)의 해석적 풍속장 모델을 대체하여 Delft3D 입력자료로 적용하여, 폭풍해일 수위 시계열의 예측 정밀도를 향상시키고 수위 변동의 시공간적 특성을 보다 세밀하게 분석하고자 한다. 이를 통해 태풍 내습 시 월파·역류 등에 의한 저지대 유입량과 연안-도시 침수 위험을 정량적으로 추적·평가할 수 있는 기반을 마련하고, 수위 변화에 따른 침수 위험의 조기 평가 및 경보 가능성을 검토함으로써 도시 침수 대응 의사결정 지원과 수위 변동에 따른 위험 저감을 목표로 한다.