1. 서 론

2. 데이터셋

2.1 데이터셋 수집 방법

2.2 데이터셋 구성 및 메타데이터 체계

2.3 데이터셋 공개

2.4 본 연구에서 활용한 데이터

3. 방법론

3.1 개요

3.2 SIFT 알고리즘 기반 특징 추출

3.3 특징 매칭

3.4 특징 매칭 검증

3.5 성능 평가 지표

4. 결 과

4.1 SIFT 특징점 검출 결과

4.2 주·야간 SIFT 특징점 검출 특성

4.3 유형별·옥타브별 SIFT 알고리즘 성능 평가

5. 결 론

1. 서 론

이미지 기반 관측 기술의 고도화와 함께, 홍수 탐지 및 재난 대응 분야에서는 위성, 무인항공기(Unmanned Aerial Vehicle, UAV), CCTV 등 다양한 플랫폼으로부터 획득된 이미지 자료를 활용한 자동 분류 및 의미론적 분할 연구가 빠르게 확산되고 있다(Bentivoglio et al., 2022; Jun et al., 2024; Kim et al., 2025). 특히 FloodNet (Rahnemoonfar et al., 2021), Sen1Floods11(Bonafilia et al., 2020)과 같은 벤치마크 데이터셋은 딥러닝 기반 홍수 분할 모델의 성능 평가를 체계화하고, 알고리즘 개발의 가속화를 촉진하였다. 그러나 이러한 데이터셋을 활용한 연구들에서는 모델 구조의 고도화와 성능 향상에 초점을 두고 있으며, 입력 이미지의 환경적 변동이 알고리즘 성능에 미치는 영향을 체계적으로 규명하고자 한 시도는 제한적이다.

하천 이미지는 촬영 시간대, 조도, 기상 조건, 계절적 요인의 변화에 따라 동일 지점에서도 크게 상이한 시각적 특성을 나타낸다. 특히 수면 반사, 그림자, 역광 등 하천 특유의 광학적 요인은 이미지 품질의 변동성을 증가시키며, 이는 특징점 검출, 매칭, 객체 인식 등 다양한 컴퓨터 비전 알고리즘에 직접적인 영향을 미친다(Mikolajczyk and Schmid, 2005). 그럼에도 불구하고 기존 홍수 이미지 데이터셋은 촬영 환경에 대한 메타데이터를 충분히 제공하지 않거나 아예 포함하지 않기 때문에, 알고리즘 성능의 변동을 환경 요인과 연계하여 해석하는 데 근본적인 한계가 존재한다. 소셜 미디어에서 수집되는 클라우드 기반 이미지 역시 시간·위치 정보의 부정확성, 촬영 조건의 비표준성 등으로 인해 환경적 영향 요인을 분리하여 분석하기 어렵다는 한계를 갖는다.

이러한 메타데이터 부재는 연구적·실용적 측면 모두에서 중대한 문제를 야기한다. 첫째, 어떤 알고리즘이 특정 이미지에서 낮은 성능을 보일 때 그 원인이 알고리즘 구조의 본질적 한계인지, 이미지 품질 저하에 기인한 것인지, 혹은 특정 환경 조건에 대한 취약성 때문인지 분리하여 판단하기 어렵다. 둘째, 하천 모니터링 시스템은 장기간·연속적으로 운영되며 다양한 조도 및 기상 조건을 마주하게 된다. 이에 따라 환경적 변동성이 충분히 반영되지 않은 데이터로 학습된 모델은 실제 현장에서 예기치 못한 성능 저하를 초래할 수 있다(Peng et al., 2022). 이는 이미지 기반 홍수 모니터링 시스템의 신뢰성을 확보하는 데 매우 중요한 문제이다.

본 연구는 환경 영향의 정량적 규명을 위해, 특징점 검출 및 기술자 추출 과정이 명시적으로 정의된 스케일 불변 특징 변환(Scale-Invariant Feature Transform, SIFT) 알고리즘(Lowe, 2004)을 채택하였다. SIFT는 크기·회전·조도 변화에 강건한 특성을 보이며, 이미지 정합, 변화 탐지, 3차원 재구성 등 다양한 분야에서 오랫동안 활용되어 왔다(Szeliski, 2022; Liu et al., 2024; Eltner et al., 2020). Mikolajczyk and Schmid (2005)는 성능 평가를 통해 SIFT가 다양한 이미지 변형에 대해 우수한 성능을 보이며, 특징점 기술자들의 일반적인 거동을 대변함을 입증하였다. SIFT 관련 선행 연구들(Valgren and Lilienthal, 2007; Stylianou et al., 2015)은 장기 관측 시 물리적 변화보다 조명 및 기상 조건이 매칭 성능 저하의 지배적인 요인임을 밝혔으나, 이는 주로 건물이나 도로와 같은 일반적인 정적 환경에 국한되었다. 수면 반사와 유체 흐름 등 고유한 광학적 특성을 지닌 하천 환경에서, 급격한 조도 변화가 특징점 검출 및 정합에 미치는 영향을 체계적으로 규명한 연구는 여전히 부족하다.

본 연구는 기존 하천 이미지 연구에서 데이터 부족과 환경 변수 분석의 한계를 보완하고자 두 가지 주요 목표를 설정하였다. 첫째, 국내 하천 환경의 시공간적 다양성을 포착하는 표준화된 이미지 데이터셋을 구축하는 것이다. 이를 위해 직접 촬영한 이미지와 홍수통제소 CCTV 이미지를 이용하여 데이터를 확보하였고, 각 이미지에 촬영 일시 및 장소 등의 메타데이터를 체계적으로 부여하여 환경 변수 기반의 분석이 가능한 구조로 설계하고자 하였다. 둘째, 구축된 데이터셋의 일부를 활용하여 하천 이미지에서 조도 변화가 SIFT 특징점 검출 및 특징 매칭 성능에 미치는 영향을 정량적으로 규명하고자 하였다.

본 연구의 주요 기여는 두 가지로 요약된다.

(1) 메타데이터를 포함한 하천 이미지 표준 데이터셋을 구축·공개하여, 연구 재현성을 확보하는 데 기여하였다.

(2) 실제 하천 환경에서 조도 변화가 알고리즘 성능에 미치는 영향을 사례 기반으로 분석하였다.

2. 데이터셋

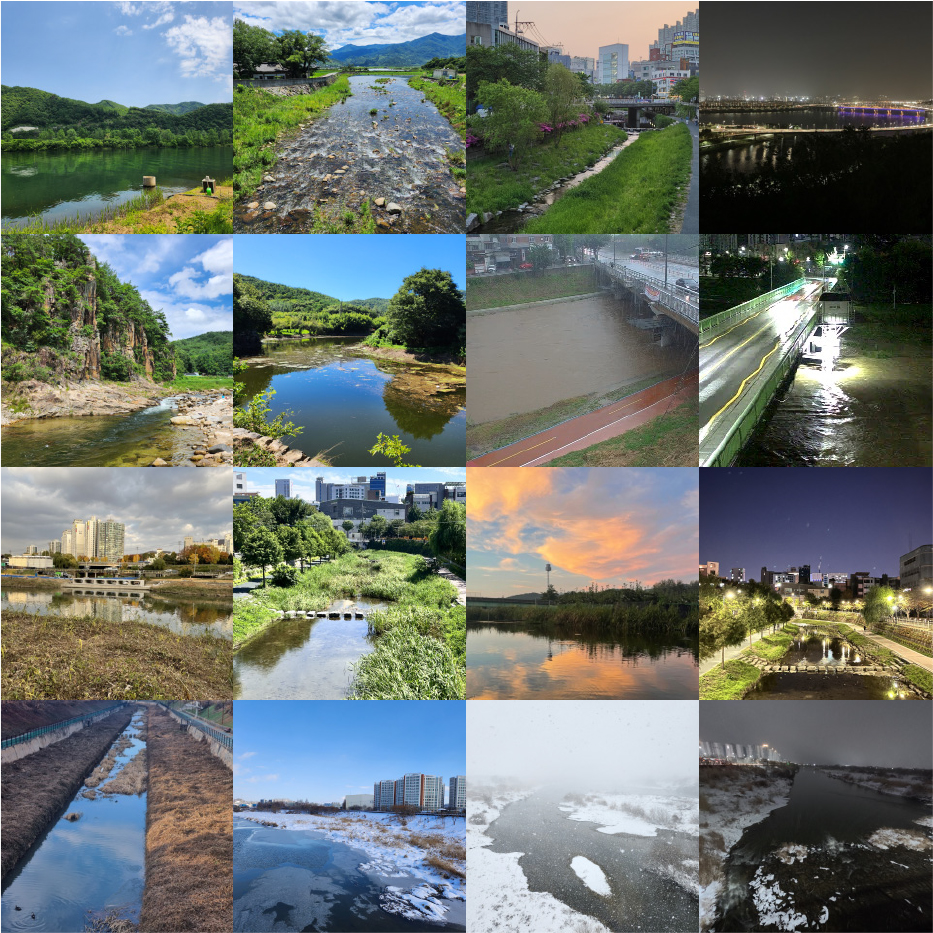

이미지 기반 하천 분석을 위해서는 충분한 규모와 체계성을 갖춘 데이터가 필수적이나, 현재 국내에는 공개된 지상 카메라 기반 벤치마크 데이터셋이 미비하여 연구 확장에 한계가 있다. 이에 본 연구에서는 이러한 제약을 극복하고자 하천 환경의 시·공간적 변동성을 충실히 반영한 ‘KU 하천 이미지 데이터셋(KU River Image Dataset)’을 새롭게 구축하고 표준화하였다(Fig. 1). 본 데이터셋은 (i) 국내 주요 유역을 포괄하는 공간적 분포, (ii) 사계절 및 주·야간을 아우르는 시간적 다양성, (iii) 수기 촬영과 CCTV의 상보적 조합이라는 세 가지 핵심 축을 기반으로 설계되었다. 이는 향후 딥러닝 기반의 하천 수체 분할 및 객체(식생, 구조물) 인식 등 다양한 컴퓨터 비전 기술 개발을 위한 기초 자료로 활용될 수 있도록 구성되었다.

2.1 데이터셋 수집 방법

데이터는 수기 촬영과 홍수통제소 CCTV 이미지 확보의 두 경로를 통해 수집하였다. 수기 촬영은 연구자가 하천 주변에서 직접 촬영한 이미지로, 삼각대 등 고정 장비를 사용하지 않았다. 이에 따라 다양한 시야각, 초점 거리, 촬영 거리 등의 조건을 포함하였다. 또한, 국내 주요 유역 홍수통제소의 공공 CCTV를 크롤링하여 이미지를 수집하였다. 이를 통해 수위 상승으로 현장 접근이 어려운 상황에서도 하천 이미지를 확보할 수 있었다. 최종적으로 총 1,732장의 이미지를 확보하였으며, 이 중 수기 촬영 1,294장, CCTV 기반 438장으로 구성된다.

2.2 데이터셋 구성 및 메타데이터 체계

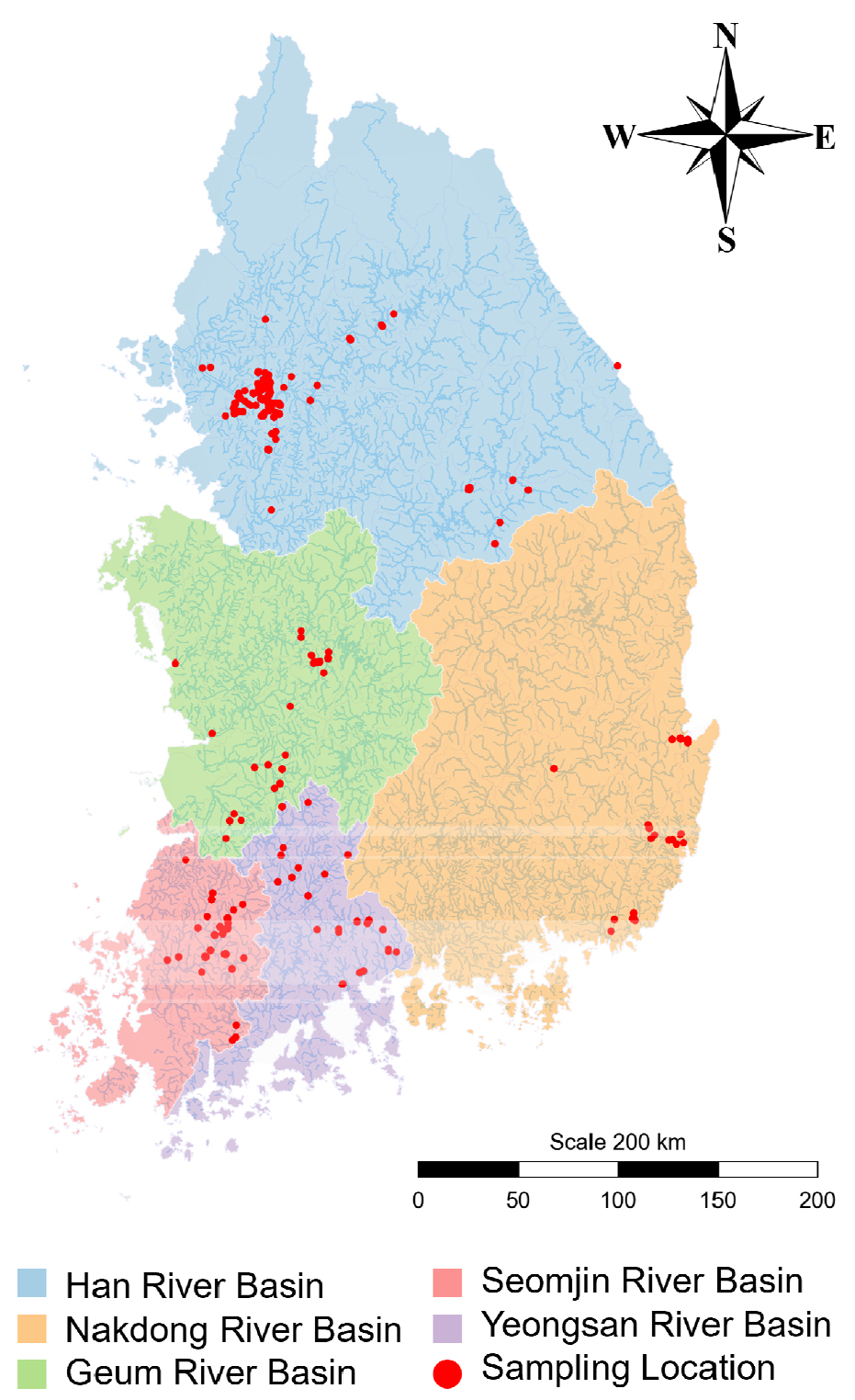

본 데이터셋은 Fig. 2와 같이 국내 주요 유역을 포괄하도록 수집 지점을 배치하여 공간적 대표성을 확보하였다. 전체 데이터의 유역별 분포는 한강(41%)과 영산강(36%)을 주축으로 하여 낙동강(11%), 섬진강(7%), 금강(5%) 순으로 구성되며, 이를 통해 국내 하천 경관의 이질성과 구조적 다양성이 반영되도록 하였다. 시간적 측면에서는 계절 변화에 따른 식생, 수면 질감, 하상 노출, 조도 조건의 변화를 포괄적으로 포착하도록 구성하였다. 계절별 구성 비율은 겨울(37%)과 여름(28 %)이 가장 높은 비중을 차지하였으며, 이어 가을(22%)과 봄(7%) 순으로 수집되었다(촬영 시간 정보 부재 7%).

메타데이터란 데이터에 대한 정보를 구조적으로 설명하는 정보이다. 본 데이터셋에서는 촬영 일시와 장소를 핵심 메타데이터로 설정하고, 파일명을 ‘YYYYMMDD_HHMMSS_지역_지점명’ 형식으로 표준화하였다. 또한 촬영 일시 정보가 없는 이미지는 ‘00000000_고유번호_ 지역_지점명’으로 표기하여 데이터 관리의 일관성을 확보하였다. 수집된 데이터셋은 원본 형태를 유지하여 향후 연구의 목적에 따라 다양한 전처리 기법을 적용할 수 있도록 하였다.

2.3 데이터셋 공개

본 연구에서 구축된 KU 하천 이미지 데이터셋은 연구의 재현성과 활용성을 높이기 위해 Zenodo 저장소를 통해 공개되었다. 해당 데이터셋은 원본 이미지와 함께 촬영 일시·장소 등의 메타데이터를 포함하고 있으며, 영구 식별자를 통해 접근 및 활용이 가능하다(https://doi.org/10.5281/zenodo.17937178).

2.4 본 연구에서 활용한 데이터

본 연구에서는 총 7가지 기준을 적용하여 분석에 활용할 이미지를 선별함으로써, 조도 변화 외의 변인을 통제하였다. 선별된 데이터는 1) 24시간 연속성(1시간 간격, 결측 없음)을 갖추고, 2) 기상(맑음/흐림) 및 3) 수위(갈수기) 변동이 최소화된 4) 단일 계절의 이미지이다. 5) 고정된 카메라 각도와 6) 1920×1080(FHD) 해상도를 유지하고, 7) 야간 가시성이 확보된 지점을 선정하였다.

전체 데이터셋 중 앞서 기술한 선별 기준을 모두 충족하는 이미지만을 대상으로, 분석 목적에 따라 Table 1과 같이 두 개의 하위집합으로 구성하였다. 하위집합 I은 영산강 유역 풍영정천2교의 3일간 데이터를 사용하여, 동일 장소 내 시간 흐름에 따른 특징점 변화의 시간적 일관성을 검증한다. 하위집합 II는 공간적 일반화를 검증하기 위해 구성하였으며, 이를 위해 영산강(남평교)뿐만 아니라 금강(죽림교), 섬진강(서산교) 등 서로 다른 수계에 위치한 3개 지점을 선정하였다.

Table 1.

Specifications of the selected image subsets

3. 방법론

3.1 개요

본 연구는 조도 변화가 SIFT 알고리즘의 특징점 검출 특성과 이미지 정합 및 특징 매칭 성능에 미치는 영향을 규명하기 위해, 구축된 두 데이터 하위집합의 시계열 이미지를 ‘주간’과 ‘야간’으로 구분하여 분석을 수행하였다. 구체적인 분류 기준은 한국천문연구원이 제공하는 일출 및 일몰 시각 자료를 따랐다. 일출과 일몰 사이의 시간대는 주간으로, 일출 전과 일몰 후의 시간대는 야간으로 분류하였으며, 주간과 야간의 전이 구간에 해당하는 시민박명 시간대(새벽 및 황혼)는 분석의 명확성을 위해 대상에서 제외하였다.

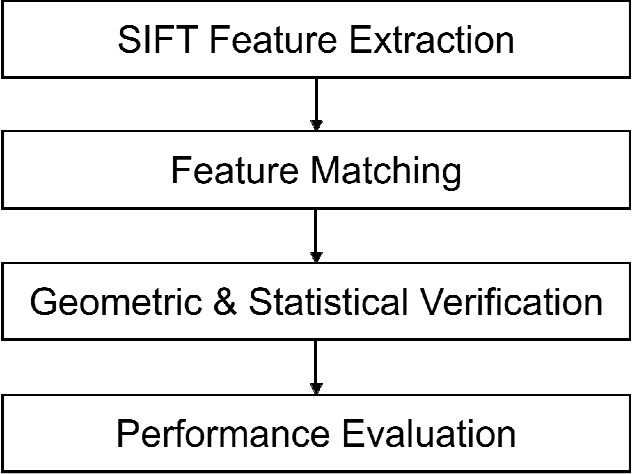

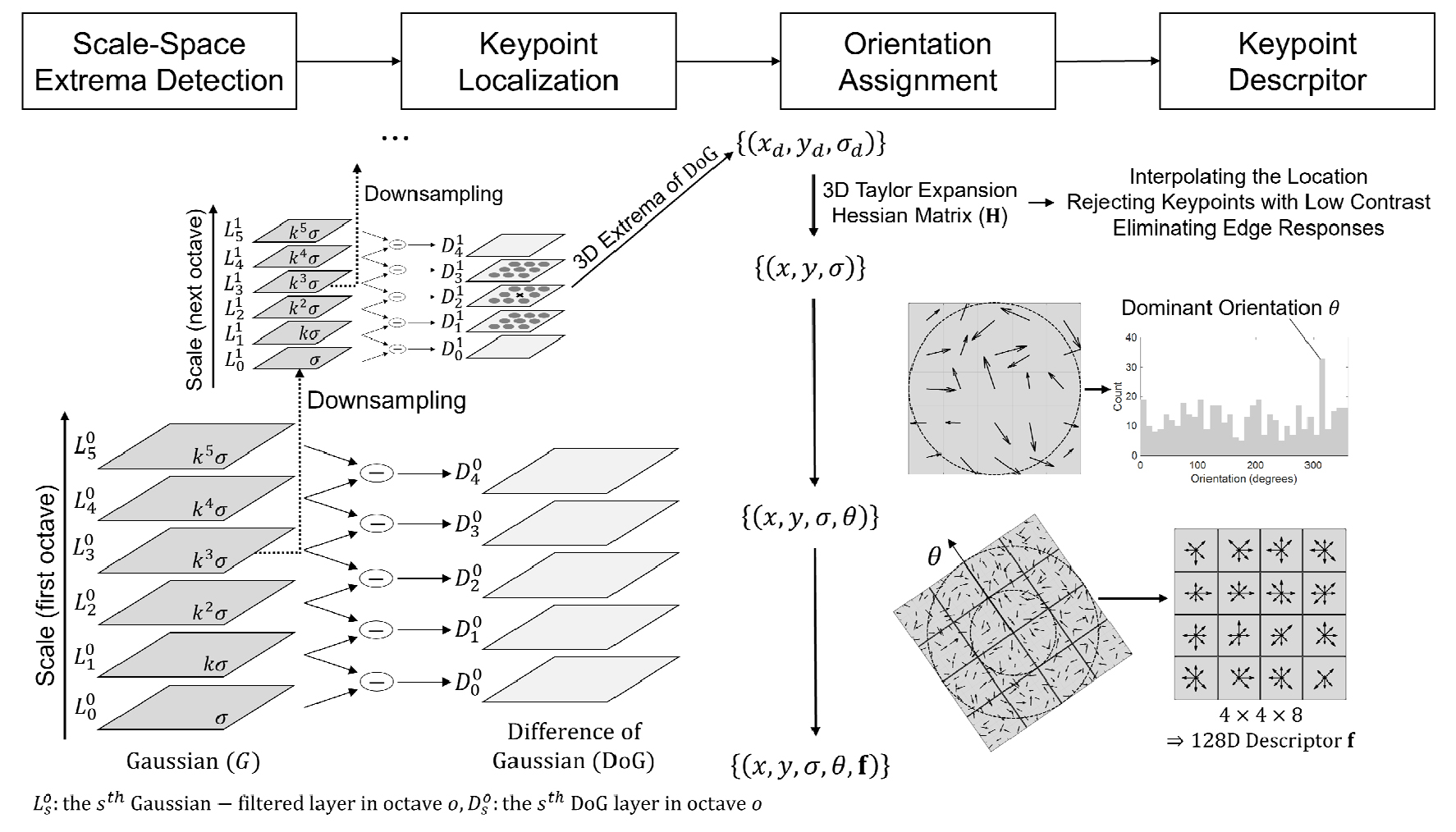

전체적인 분석 흐름은 다음과 같다(Fig. 3). 먼저, 전처리 과정에서는 색상 성분을 제거하고 밝기 성분만을 유지하는 흑백(Grayscale) 변환을 적용한 후, 각 이미지에서 SIFT 알고리즘으로 특징 벡터를 추출하였다(Fig. 4). 특징 매칭을 위해 유클리드 거리(Euclidean Distance) 기반의 완전 탐색(Brute Force Search) 방식을 사용하여 각 특징에 대해 상위 2개의 최근접 이웃을 탐색하였다. 이후 Lowe 비율 검정과 상호 최근접(Mutual Nearest Neighbor, MNN) 조건을 이용하여 오매칭을 제거하였다. 이어서 매칭의 신뢰성을 확보하기 위해, Fischler and Bolles (1981)가 제안한 무작위 표본 합의(Random Sample Consensus, RANSAC)와 Brown and Lowe (2007)가 제안한 확률적 모델을 적용하여 기하학적 및 통계적 검증을 수행하였다. 이 과정에서 이미지 정합 성공 여부를 판별하고, 검증을 통과한 이미지 쌍에 대해서는 매칭률을 추가적으로 분석하였다. 최종적으로 이미지 정합의 성공 빈도와 특징 매칭률을 종합하여 본 연구에서 제안하는 정량적 평가 지표를 산출하였다.

모든 실험은 동일한 매개변수와 분석 절차를 적용하여 결과의 객관성을 확보하였다. 산출된 평가 지표를 바탕으로 이미지 쌍의 조합(주간-야간, 주간-주간, 야간-야간)에 따른 결과 차이를 비교하였다.

3.2 SIFT 알고리즘 기반 특징 추출

3.2.1 스케일 공간에서 극값 탐지

이미지(I)는 픽셀 단위로 구성되며, 각 픽셀의 위치는 좌표 (x,y)로 표현할 수 있다. SIFT 알고리즘은 Fig. 4와 같이 구성된다. 먼저 원본 이미지에 Eq. (1a)와 같이 표준편차가 σ인 가우시안 필터(G)를 적용하여 가우시안 공간의 기본 레이어(L)를 형성한다. 이후 배율 상수 k를 거듭제곱하여 표준편차가 점진적으로 증가하는 가우시안 필터를 생성한다. 이 필터를 순차적으로 이용하여 하나의 옥타브(o) 내에서 서로 다른 스케일을 갖는 가우시안 레이어를 구성한다. 이어서 이미지의 가로 및 세로 방향으로 절반씩 축소하는 다운샘플링을 통해 다음 옥타브를 생성하며, 이러한 과정을 반복하여 옥타브와 레이어로 구성된 스케일 공간을 정의한다. 이러한 스케일 공간은 다양한 크기의 특징을 일관되게 탐지할 수 있는 기반을 제공함으로써 스케일 불변성(Scale Invariance)을 확보한다.

Eq. (1b)와 같이 인접한 가우시안 레이어의 차이를 이용하여 새로운 스케일 공간인 가우시안 차(Difference of Gaussian, DoG)를 정의한다. 각 픽셀은 이미지 평면과 스케일 축을 포함한 3차원 DoG 공간에서, 동일 레이어의 8개, 상·하 인접 레이어의 각각 9개 이웃 픽셀을 포함한 총 26개의 이웃 픽셀과 비교되며, 이들보다 크거나 작은 경우를 극점으로 판단하여 특징점 후보로 검출된다.

3.2.2 특징점 위치 정밀화

검출된 후보 특징점은 DoG 스케일 공간에서 3차원 테일러 전개를 통해 극값의 위치와 스케일을 정밀화하고, 보간된 극값에서의 응답값을 기준으로 저대비 특징점은 제거한다. Eq. (2a)에 정의된 해시안 행렬(H)로부터 계산된 행렬의 대각합(Tr(H))의 제곱과 행렬식(Det(H))의 비가 임계값을 초과하여 Eq. (2b)를 만족하지 않는 응답은 엣지 응답으로 간주하여 제거되며, 그 결과 엣지 응답에 비해 위치 안정성이 높은 코너 기반의 특징점만이 선별된다. 이러한 코너 기반의 특징점은 평탄 영역이나 엣지에 비해 촬영 시점이나 조도 등 관측 조건이 변화하더라도 비교적 안정적으로 재검출되는 특성을 갖는다.

여기서, 은 해시안 행렬의 고유값의 비를 의미하며, 본 연구에서는 Lowe (2004)가 제안한 값인 r = 10을 사용하였다.

3.2.3 주방향 할당

특징점 스케일에 대응되는 가우시안 레이어에서 특정 영역 내의 모든 픽셀에 대하여 Eqs. (3a) and (3b)와 같이 기울기의 크기()와 방향( )을 계산한다. 이를 0°-360° 범위에서 10° 간격으로 분할한 36-bin 방향 히스토그램으로 표현하고, 그중 응답값이 가장 큰 값을 주방향으로 설정한다. 또한 주방향 응답값의 80% 이상의 응답값을 갖는 방향이 존재하는 경우, 동일한 위치·스케일에서 추가 특징점이 생성된다.

3.2.4 특징 기술자 추출

마지막으로 특징점의 주방향을 기준으로 정렬된 로컬 좌표계에서 4×4 하위 영역마다 8방향 히스토그램을 누적하여 4×4×8 = 128차원 기술자(f)를 추출하고, 보간 및 정규화 과정을 통해 조도 변화에 대한 견고성을 확보한다. 이러한 과정을 거쳐 얻어진 특징점과 그에 대응하는 기술자는 각자의 스케일(옥타브) 정보를 보존하며, 이후 스케일 관점 분석의 기본 단위로 활용된다.

3.3 특징 매칭

SIFT 알고리즘으로부터 추출된 각 이미지의 특징 기술자는 128차원의 벡터로 구성되며, 이들 간의 매칭 정도를 계산하기 위해 유클리드 거리를 사용하였다. 두 이미지의 특징 기술자 집합을 각각 라 하면, 두 특징 기술자 간의 거리는 Eq. (4)와 같이 정의된다.

이때, 특징 기술자 간의 최적 매칭 쌍을 찾기 위해, 모든 특징점 조합에 대해 거리를 계산하는 완전 탐색 방식을 적용하였다. 오매칭을 제거하기 위해, 모든 후보 매칭 중 가장 짧은 거리()와 두 번째로 짧은 거리()의 비율을 계산하여, Lowe (2004)에서 제안된 비율 검정(Eq. (5))을 적용하였다.

또한, MNN 조건을 적용하여 순방향과 역방향에서 서로가 최근접 이웃으로 대응되는 경우만을 고려하였다.

3.4 특징 매칭 검증

이미지 에서 추출된 전체 특징점 수를 각각 라 할 때, 앞선 초기 매칭 과정(3.3절)을 거쳐 선별된 후보 매칭 쌍의 개수를 로 정의하였다. 이 중 시점 변화 등에 의한 오정합을 제거하기 위해 호모그래피 기반의 RANSAC을 적용하여 최소 4쌍의 대응점으로부터 변환 행렬을 추정하였다. 이때 최대 반복수 2,000, 신뢰도 0.995의 조건에서 재투영 오차 3.0 픽셀 이하인 인라이어를 최종 선별하였으며, 그 개수를 로 정의하였다. 최종적으로 우연이나 단순 반복 패턴에 의한 매칭을 배제하기 위해 Brown and Lowe (2007)의 확률적 검증 모델을 적용하였으며, 와 가 Eq. (6)의 조건을 만족하는 경우에만 유효한 매칭으로 간주하였다.

3.5 성능 평가 지표

본 연구에서는 하천 이미지의 정합 성능을 다각도로 분석하기 위해 이미지 정합의 강건성과 특징 쌍의 매칭 품질, 그리고 이를 결합한 종합적인 유효성을 각각 평가할 수 있는 세 가지의 정량 지표를 도입하였다.

3.5.1 이미지 정합 성공률(IRR)

이미지 정합 성공률(Image Registration Rate, IRR)은 정합을 시도한 전체 이미지 쌍 중에서 기하학적 및 통계적 검증을 통과하여 최종적으로 정합에 성공한 이미지 쌍의 비율로 정의한다. 전체 이미지 쌍의 집합을 , 검증 과정을 통과한 이미지 쌍의 집합을 라 할 때, IRR은 Eq. (7)과 같이 정의된다.

이 지표가 높다는 것은 수면의 반사, 물결, 조도 변화 등 다양한 환경의 변화 속에서도 이미지가 성공적으로 정합됨을 의미한다.

3.5.2 특징 매칭률(FMR)

특징 매칭률(Feature Matching Rate, FMR)은 정합에 성공한 이미지 쌍에 대하여, 추출된 전체 특징점 대비 실제 정합에 기여한 인라이어의 비율로 정의된다. 정합에 실패한 이미지 쌍의 FMRij은 0이 된다. 이미지 에 대한 FMRij의 정의는 Eq. (8)과 같다. 또한, 전체 이미지 쌍의 평균적인 매칭 품질을 나타내는 평균 특징 매칭률(FMRavg)은 정합에 성공한 이미지 쌍들의 FMRij의 평균으로 산출하며, 만약 정합에 성공한 이미지 쌍이 존재하지 않을 경우 FMRavg은 0으로 간주한다(Eq. (9)).

이 지표가 높다는 것은 하천의 불규칙한 환경 변화에도 불구하고 이미지 정합에 기여하는 신뢰성 높은 특징이 다수 확보되었음을 의미한다.

3.5.3 유효 매칭률(EMR)

유효 매칭률(Effective Matching Rate, EMR)은 정합 성공의 빈도와 매칭 품질을 동시에 고려한 종합적인 성능 지표이다. EMR은 Eq. (10)와 같이 정의되며, 이 값이 높을수록 데이터셋 내의 이미지 쌍에서 특징이 안정적으로 매칭되며, 매칭된 결과가 잡음 없이 높은 밀도의 유효한 특징점으로 구성됨을 의미한다.

4. 결 과

4.1 SIFT 특징점 검출 결과

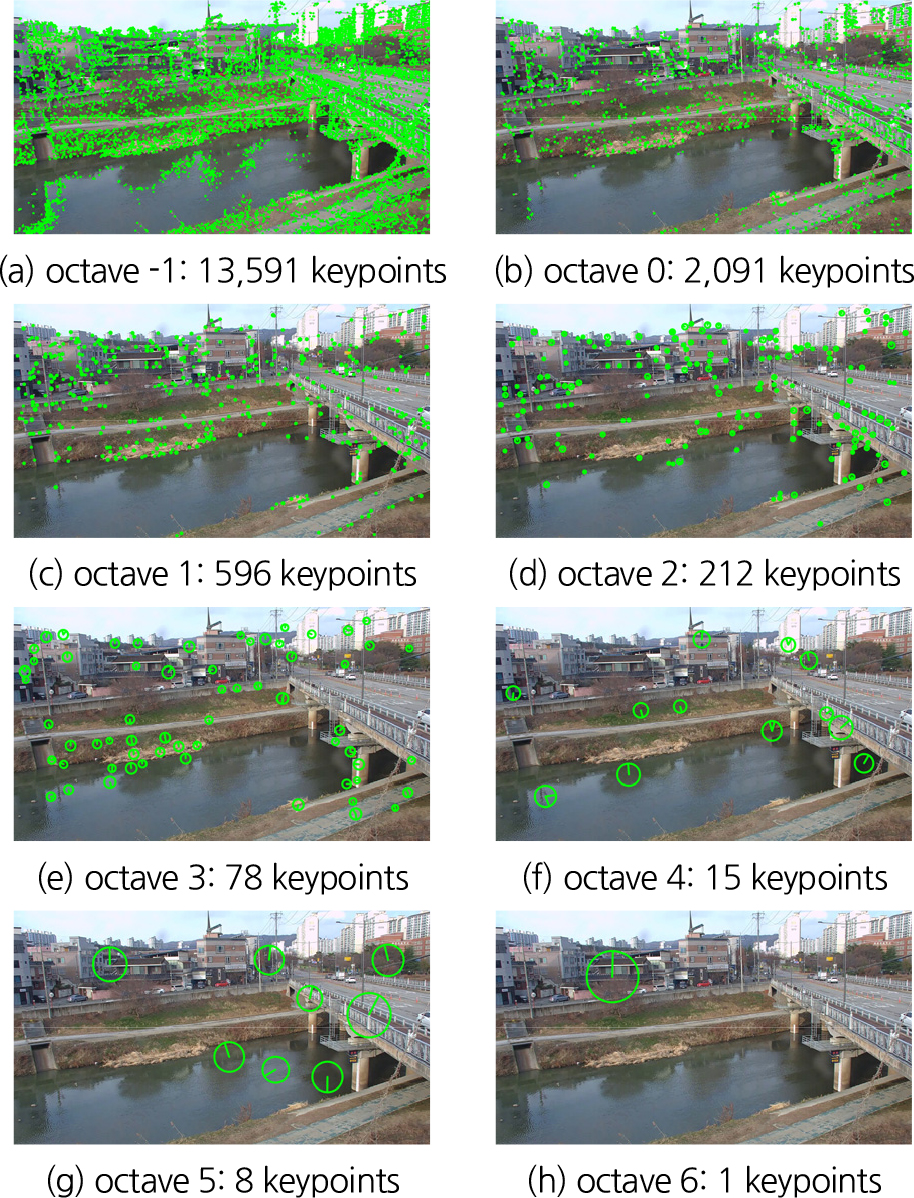

본 절에서는 SIFT 알고리즘에 의한 특징점 검출 결과를 시각적으로 제시하고자, 전체 144장의 데이터 중 임의의 사례(2025년 2월 3일 09시, 풍영정천2교)를 선정하여 Fig. 5에 나타내었다. SIFT 특징점은 원으로 표현되며, 원의 중심은 특징점의 위치, 크기는 검출 스케일, 반지름의 방향은 회전 불변성 확보를 위해 할당된 주방향을 나타낸다. 해당 이미지에서는 총 16,592개의 특징점이 검출되었다.

Fig. 6은 동일한 이미지에 대하여 특징점을 옥타브별로 구분하여 나타내었다. 이미지의 크기에 따라 옥타브의 수가 달라지며, 본 연구에서 사용한 FHD 이미지의 경우에는 총 8개의 옥타브가 형성되었다. 일반적으로 옥타브가 높아질수록 더 큰 스케일의 특징점을 포착하게 되는데, 이때 시각화된 원의 크기는 특징점의 스케일을 반영하여 커지며, 반지름의 방향은 주변 픽셀 기울기의 분포를 나타낸다. 한편, 높은 옥타브로 올라갈수록 이미지 해상도가 낮아짐에 따라 검출되는 특징점의 수도 급격히 감소하는 경향을 보인다. 낮은 옥타브인 Figs. 6(a) and 6(b)에서는 식생과 같은 미세한 텍스처로부터 다수의 특징점이 검출된 반면, 높은 옥타브인 Figs. 6(g) and 6(h)에서는 건물이나 교량 등 크기가 큰 구조적 요소를 중심으로 특징점이 검출되었다.

4.2 주·야간 SIFT 특징점 검출 특성

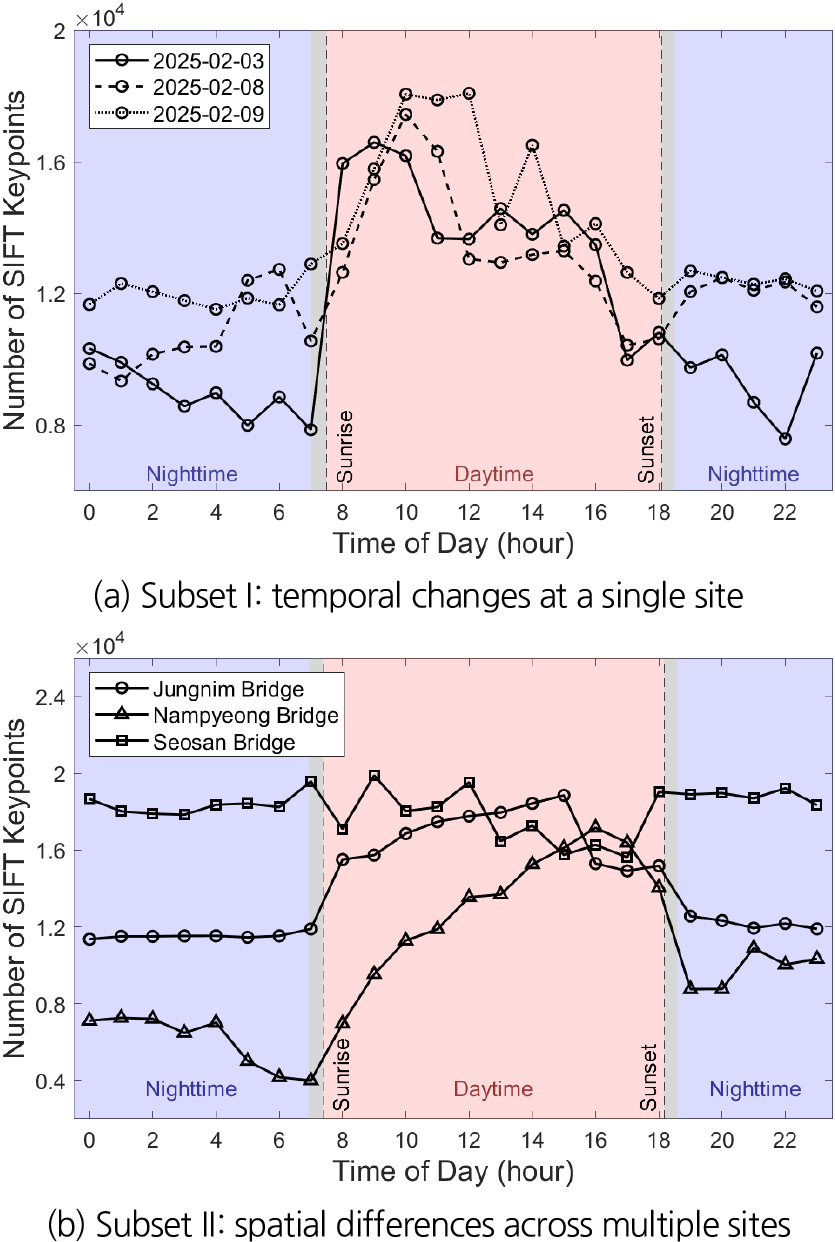

본 절에서는 하루 동안의 조도 변화에 따른 주·야간 차이에 초점을 두어, SIFT 특징점 검출량과 변동성을 분석하였다. Fig. 7은 0시부터 23시까지 1시간 간격으로 추출된 특징점 개수의 변화를 나타낸다.

Fig. 7(a)에 나타난 하위집합 I 분석 결과, 동일 지점에서 관측된 모든 기간에 걸쳐 주간에는 특징점 검출량이 증가하고 변동성이 크게 나타나는 반면, 야간에는 상대적으로 검출량이 감소하고 변동성이 작아지는 특성이 반복적으로 관찰되었다. 주간에는 평균 14,148개의 특징점이 검출되어, 야간 평균 10,775개에 비해 약 1.31배 높은 값을 보였다. 변동계수는 일별 변동계수를 3일간 평균한 값 기준으로, 주간 0.15에 비해 야간이 0.08로 더 낮게 나타났다. 이는 조도가 높은 주간에는 특징점이 풍부하지만 태양의 고도나 구름의 위치 변화 등으로 인해 등락폭이 큰 반면, 조도가 낮은 야간에는 검출량이 감소했으나 인공 조명 하에서 비교적 일정한 수준이 유지되는 경향을 보였다.

Fig. 7(b)의 하위집합 II에서는 세 지점 모두에서 주·야간에 따른 특징점 검출량과 변동 특성이 전반적으로 하위집합 I과 유사한 양상을 보였다. 이 가운데 죽림교는 주간에 다량의 검출량과 큰 변동성, 야간에 상대적으로 감소한 검출량과 작은 변동성을 보여, 하위집합 I의 결과를 대표적으로 재현하였다. 한편, 서산교에서는 인접한 인공 조명의 영향으로 야간 평균 특징점 개수 18,468개가 주간 평균 17,566개를 약 5% 상회하였으며, 남평교에서는 이미지 내에서 수면이 차지하는 비중이 높아 수면 반사 조건의 변화가 크게 나타남에 따라, 야간 변동계수가 0.26으로 주간 변동계수 0.22에 비해 크게 나타났다. 이는 주·야간 조도 차이에 따른 전반적인 경향 외에도, 인공 조명 및 수면 반사 특성과 같은 지점별 환경 조건이 특징점 검출 특성에 영향을 미칠 수 있음을 시사한다.

4.3 유형별·옥타브별 SIFT 알고리즘 성능 평가

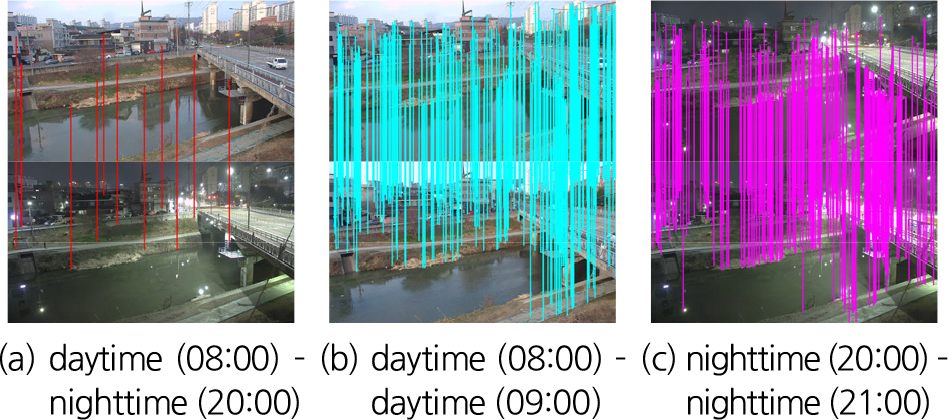

Fig. 8은 2025년 2월 3일 08시·09시 주간 이미지와 20시·21시 야간 이미지를 대상으로 한 특징점 매칭 결과를 나타낸다. 시각적 이해를 위해 옥타브 0에서 매칭된 특징점만을 선으로 연결하였다. Figs. 8(a)~8(c)에서는 각각 13, 393, 340개의 특징점이 매칭되었다. 매칭 개수의 차이는 두 가지로 설명할 수 있다. 첫째, 4.2절에서 확인한 바와 같이, 주·야간 이미지 간 특징점 검출량에 차이가 존재한다는 점이다. 둘째, 주간과 야간 이미지에서 추출된 SIFT 특징의 특성이 서로 달라 매칭이 상대적으로 어렵다는 점이다. 이러한 배경을 바탕으로, 본 절에서는 주간-야간, 주간-주간, 야간-야간 유형별로 옥타브별 SIFT 특징의 매칭 성능을 평가하였다.

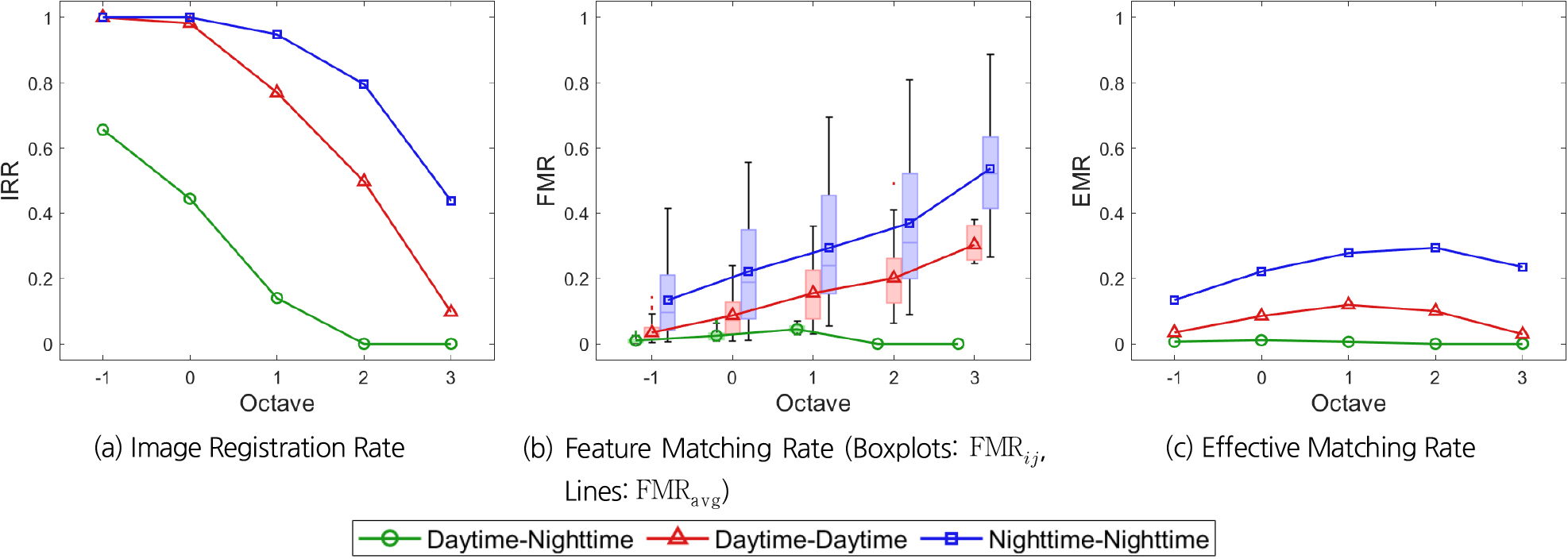

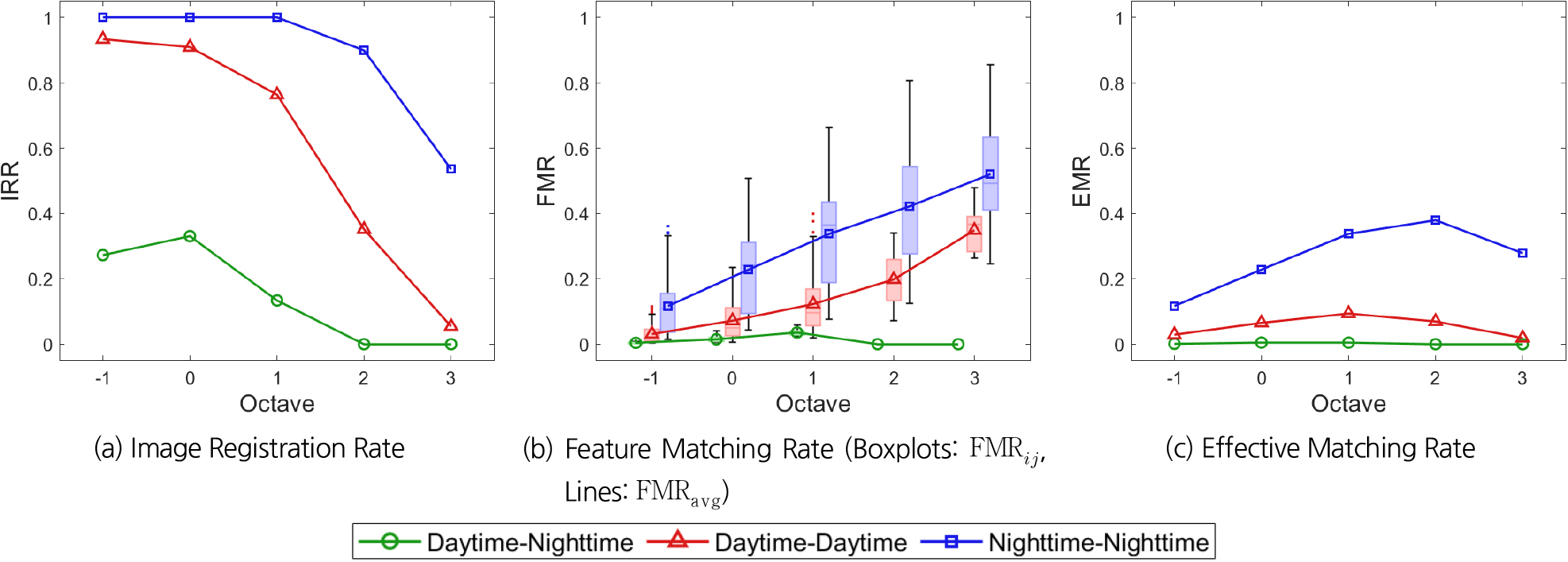

Figs. 9 and 10은 각각 한 지점 내 시간 변화를 다룬 하위집합 I과 서로 다른 지점을 다룬 하위집합 II에 대한 유형별·옥타브별 SIFT 알고리즘 성능 평가 결과를 나타낸다. 각 그림의 (a), (b), (c)는 옥타브별 이미지 정합 성공률(IRR), 특징 매칭률(FMR), 그리고 유효 매칭률(EMR)의 변화를 보여준다.

먼저 IRR을 살펴보면(Figs. 9(a) and 10(a)), 두 하위집합 모두 옥타브가 증가함에 따라 IRR은 감소하는 경향을 보였다. 이는 낮은 옥타브 특징이 이미지 정합에 더 강건하게 작용함을 의미한다. 조도 조건별 성능은 야간-야간 조합이 가장 우수하였으며, 주간-주간, 주간-야간 순으로 뒤를 이었다. 주간-주간 조합보다 야간-야간 조합이 더 높은 IRR을 보인 이유는, 야간에는 고정된 조명 하에서 비교적 일정한 조도 조건이 유지되어 특징 매칭이 안정적으로 수행되기 때문이다. 한편, 조도 차이가 큰 폭으로 차이 나는 주간-야간 조합은 가장 낮은 옥타브에서도 IRR이 0.66, 0.27로 현저히 낮았다.

다음으로 FMR (Figs. 9(b) and 10(b))은 정합에 성공한 이미지에 대한 특징 매칭률을 나타내며, 옥타브별로는 IRR과 반대로 높은 옥타브로 갈수록 FMR이 증가하는 경향을 보였다. 이는 옥타브가 증가할수록 특징점의 개수 즉, 양적인 측면에서는 감소하지만, 특징 매칭 품질 즉, 질적인 측면은 향상되는 상충 관계가 있음을 시사한다. 유형별 비교에서는 IRR과 동일하게 야간-야간, 주간-주간, 주간-야간 순으로 높은 성능을 보였다.

EMR (Figs. 9(c) and 10(c))은 IRR과 FMRavg을 곱하여 산정한 유효 특징 매칭률로, 강건성과 품질의 균형점을 평가한다. EMR 또한 야간-야간, 주간-주간, 주간-야간 순으로 높게 나타나 조도 조건이 안정적일수록 유효 매칭 확보에 유리함을 재확인하였다. 주목할 점은 조도 조건에 따라 최대 성능을 보이는 옥타브 구간이 다르다는 것이다. 주간-주간 조합은 상대적으로 작은 스케일의 특징이 포함된 옥타브 1에서 EMR이 0.12, 0.09로 가장 높게 나타난 반면, 야간-야간 조합은 그보다 큰 스케일의 특징이 포함된 옥타브 2에서 EMR이 0.29, 0.38로 가장 높았다. 이는 조도 조건의 차이가 각 환경에서 유효한 특징점의 크기를 결정짓는 주요 요인으로 작용하여, 옥타브별 매칭 성능에 차이를 유발했음을 보여준다. 한편, 주간-야간 조합은 모든 옥타브 구간에서 EMR이 0.02 미만으로 낮게 나타나, 조도 조건이 크게 상이한 환경에서는 유효한 매칭 확보가 다소 제한될 수 있음을 시사한다.

결론적으로, 주간 환경에서는 비교적 작은 스케일의 특징이, 야간 환경에서는 큰 스케일의 특징이 매칭에 유리함을 확인할 수 있었다. 또한 유형별 비교에서는 조도 변화가 클수록 매칭 성능이 저하되는 경향이 나타나, 하천 이미지 특징 매칭에서 조도 조건이 핵심적인 요인임을 확인하였다.

5. 결 론

본 연구에서는 국내 하천을 대상으로 여러 유역과 관측 지점을 포함하고, 계절 및 주·야간 변화를 반영한 KU 하천 이미지 데이터셋을 구축·공개하였다. 이를 기반으로 SIFT 알고리즘을 적용하여 하천 이미지에서 조도 변화의 영향을 정량적으로 분석하였다.

KU 하천 이미지 데이터셋은 국내 주요 유역을 대상으로 시·공간적 다양성을 반영하여 총 1,732장을 수집하고, 촬영 시각과 촬영 위치를 포함한 메타데이터를 일관된 형식으로 구성하여 연구 재현성과 활용성을 높였다. 구축된 데이터셋은 원본 이미지와 메타데이터를 함께 공개 저장소를 통해 배포하여, 향후 국내 수자원 및 컴퓨터 비전 연구에서 벤치마크 데이터셋으로 활용될 수 있도록 하였다. 이러한 데이터셋의 구축 및 공개는 그동안 비공개 자체 수집 자료에 의존하던 한계를 완화하고, 연구자들이 상호 비교 가능한 실험과 성능 평가를 수행할 수 있는 기반을 제공한다는 점에서 중요한 기여를 한다.

구축된 KU 하천 이미지 데이터셋 중 홍수통제소 CCTV로 수집한 144장 이미지를 시간적·공간적 특성에 따라 분류하고, 조도 변화가 SIFT 특징점 검출 특성과 알고리즘 성능에 미치는 영향을 분석하였다. 분석 결과, 주간에는 특징점의 개수가 증가하고 변동성이 상대적으로 크게 나타났고, 야간에는 개수는 감소하였지만 비교적 안정적인 특성을 보였다. 유형별·옥타브별 SIFT 알고리즘 성능 평가에서는, 조도가 안정적인 야간-야간 조합에서 가장 높은 매칭 성능을 보였으며, 옥타브별로는 조도 조건에 따라 최적 성능을 보이는 옥타브 구간이 달랐다. 주간-야간 교차 정합에서는 다른 조합에 비해 매칭 성능이 현저히 낮게 나타났다. 이러한 결과는 하천 이미지 정합 및 특징 매칭에서 조도 조건이 핵심 요인임을 보여주며, 하천 이미지 연구에서 조도 등 환경 변수를 적절히 고려해야 함을 시사한다.

향후 연구로는 구축된 데이터셋의 메타데이터와 이미지 특성 간 상관관계에 대한 다층적 분석을 수행하여 데이터셋의 활용 가능성과 이해를 심화할 필요가 있다. 또한, 다지점·장기 관측 자료를 확충하여 본 연구 결과의 통계적 유의성을 검증하고, 알고리즘 파라미터 변화에 따른 정합 성능의 민감도를 분석하여 하천 환경에 최적화된 설정을 도출할 필요가 있다. 아울러 유의미한 특징점 필터링 기법 개발 및 특징점 기반 다지점 하천 유역 분류 연구를 수행함으로써 하천 이미지에 대한 이해를 심화할 수 있을 것으로 기대된다.