1. 서 론

2. 연구방법

2.1 초해상화 모형

2.2 물리 기반 도시 침수 해석 모형 H12

2.3 연구 지역

2.4 자료 구축

2.5 평가 지표

3. 결과 및 분석

3.1 FLO-SRNet

3.2 GAN fine-tuning

4. 결 론

1. 서 론

기후변화의 심화에 따라 극한 기상 현상의 빈도와 강도가 지속적으로 증가하고 있으며, 급속한 도시화는 도시 홍수 위험을 더욱 악화시키고 있다. 도시화에 따른 불투수면(impervious area)의 증가는 자연적인 물의 침투를 차단하고 지표면 유출을 증가시켜 도시를 홍수에 더욱 취약하게 만들고 있다(Andreadis et al., 2022; Zhang et al., 2025). 1990-2022년 기간 동안 전 세계적으로 홍수로 인해 수십억 명의 인구가 직간접적 피해를 경험했으며, 이로 인한 인명 및 재산 손실은 지속적으로 증가하는 추세다(Liu et al., 2024). 특히 도시 침수는 복잡한 지형과 조밀한 인프라로 인해 피해 양상이 급속히 변화하므로, 도시 지역의 복잡한 지형과 세밀한 배수 시설을 정확히 반영할 수 있는 고해상도 침수지도의 신속한 작성은 효과적인 홍수 대응과 피해 최소화를 위한 핵심 과제가 되고 있다.

기존 도시 침수 해석은 주로 1차원 관망 모형과 2차원 지표류 모형의 연계를 통해 강우-유출-침수 과정을 물리적으로 해석해왔다(Gao et al., 2024; Henonin et al., 2013). 하지만 2차원 천수방정식(shallow water equations) 또는 Saint-Venant 방정식을 수치해석하기 위해서는 공간 해상도가 증가할수록 계산 격자 수가 기하급수적으로 증가하며, Courant-Friedrichs-Lewy (CFL) 안정성 조건으로 인해 시간 간격이 더욱 세밀해져 계산 부담이 급격히 증가한다(Bermúdez et al., 2018; Piadeh et al., 2022). 따라서 준실시간 예측이 요구되는 환경에서는 계산 시간이 핵심 제약요소가 된다.

이러한 한계를 극복하기 위해 최근에는 물리 기반 모형을 보완하거나 대체하는 데이터 기반 및 대리모형(surrogate model) 연구가 활발히 진행되고 있다(Contreras et al., 2020; Demiray et al., 2021; Ivanov et al., 2021). 딥러닝 기법은 복잡한 비선형 관계를 학습하여 높은 정확도의 근사 해를 제공하면서도 빠른 추론 속도로 운영상 장점을 제공한다(Ren et al., 2025). 최근 물리 법칙을 모형에 내재화하는 물리 정보 기반 머신러닝(physics-informed machine learning) 접근법이 물리적 타당성과 해석가능성을 향상시키는 방향으로 발전하고 있다(Bhattarai et al., 2024; Donnelly et al., 2024; He et al., 2023; Yang et al., 2024). 또한 하천 네트워크의 복잡한 연결성과 상하류 관계를 효과적으로 해석하기 위한 그래프 신경망(Graph Neural Networks, GNNs)(Akkala et al., 2025; Bentivoglio et al., 2025; do Lago et al., 2023)과 장기 시간 의존성을 포착하는 트랜스포머(transformer) 기반 아키텍처(Pianforini et al., 2024; Song et al., 2025) 등의 구조적 혁신도 활발히 연구되고 있다. 그러나 도시 침수 분야에서는 충분한 학습 데이터 확보의 어려움, 극한 강우에 대한 외삽 성능의 한계, 그리고 배수망-지형-토지이용의 다중 규모 상호작용 등으로 인해 딥러닝 기반 대리모형의 출력 성능과 신뢰성에 편차가 존재한다.

이 가운데 초해상화(Super-Resolution, SR) 기술은 저해상도 입력을 고해상도로 변환함으로써 고해상도 학습 데이터 생성 비용을 우회하면서도 고해상도 정보를 얻을 수 있는 효율적 접근법을 제공한다. 초해상화 기술은 컴퓨터 비전 분야에서 오랫동안 발전해왔으며(Wang et al., 2022), CNN (Convolutional Neural Networks) 기반 아키텍처로 시작되어 강력한 기준선을 구축했으며(Lim et al., 2017; Zhang et al., 2018a; Zhang et al., 2018b), SwinIR (Liang et al., 2021), Swin2SR (Conde et al., 2022) 등의 트랜스포머 기반 모형과 StableSR (Wang et al., 2023) 같은 확산 모형 기반 접근법으로 확장되고 있다. 수문학 분야에서는 원격탐사 토지피복 매핑(Jia et al., 2019)과 기후 데이터 다운스케일링(Cheng et al., 2020)에서 CNN 기반 초해상화의 효과가 입증되었다. 산악 지역에서는 주의 기반 TA-UNet 모형이 위성 강우 데이터를 효과적으로 다운스케일링하여 정밀한 강우-유출 모델링을 구현했다(Jian et al., 2025). 도시 침수 분야에서는 Choi et al. (2025)이 FLO-SR이라는 CNN 기반 도시 침수 초해상화 모형을 개발하고 복잡한 도시 지형에서의 다양한 배율에 대한 초해상화 효과를 입증했으며, 물리모형과 비교하여 계산 시간을 크게 단축시켰다. Song et al. (2025)은 DenseUNet 기반 초해상화 모형을 사용하여 최대 침수심과 유속을 예측함으로써 세밀 격자 침수모형 대비 상당한 효율성 향상을 증명하였다. He et al. (2023)은 U-Net 기반 초해상화 수리학적 홍수 모형 프레임워크를 개발하여 침수심과 유속 예측에서 계산 효율성과 정확도를 효과적으로 균형 맞췄다. 추가적으로 U-Net과 생성적 적대 신경망(Generative adversarial networks, GAN) 기반 아키텍처를 활용한 고해상도 침수 지도 생성 연구들이 지속되고 있다(Golla et al., 2024; Yin et al., 2024). 국내에서도 다양한 분야에서 초해상화 기술을 활용한 연구들이 진행되고 있다(Hwang and Lee, 2023; Jo et al., 2024; Kim et al., 2024; Kwon, 2023; Lee et al., 2025b). 그중 수자원 분야에서 활용된 사례로는 GAN 기반 강우예측 연구(Choi and Kim, 2022, 2025; Kim and Hong, 2022; Yoon et al., 2023)와 도시 침수에서 CNN 기반 저해상도 물리 기반 도시 침수 해석 결과를 고해상도로 복원한 연구가 있다(Choi et al., 2023b, 2025).

그러나 기존 수자원 분야의 초해상화 연구는 몇 가지 중요한 한계를 보인다. 첫째, 대부분의 연구가 강우예측에 집중되어 있어 도시 침수에 특화된 초해상화 적용 사례가 상대적으로 제한적이다. 둘째, 다양한 초해상화 아키텍처에 대한 다중 업스케일링 배율(×2, ×4, ×8) 전반의 체계적 성능 비교 평가가 부족하다. 셋째, 도시 침수장의 고유한 구조적 특성인 복잡한 건물 배치, 급격한 지형 변화, 세밀한 도로망 경계에 대해 어떤 초해상화 접근법이 더 효과적인지에 대한 도메인 특화 분석이 체계적으로 수행되지 않았다. 더욱 중요한 한계는 기존 연구가 주로 단순화된 2차원 지표류 모형 결과를 대상으로 하여, 실제 도시 환경의 복잡성을 충분히 반영하지 못한다는 점이다. 현실적인 도시 침수 해석에서는 우수관거, 빗물받이, 펌프장 등의 배수 인프라와 지표류 간의 상호작용을 고려한 1차원-2차원 연계 모델링(1D-2D coupled modeling)이 필수적이다. 이러한 연계 모델링은 관거 내 압력류와 지표 자유수면류의 동적 교환, 맨홀 월류 및 역류 현상, 다중 배수 경로 간의 비선형 상호작용 등으로 인해 단순 2차원 모형보다 비선형적이고 불연속적인 복잡한 침수 패턴을 생성한다. 따라서, 단순 2차원 지표류 흐름을 초해상화하는 것보다 복원 난이도가 더 높다. 넷째, 기존 연구들은 주로 PSNR, SSIM 등의 화질 중심 평가지표에 의존하여, 재해 대응 의사결정에 직결되는 실용적 성능을 충분히 반영하지 못하고 있다. 도시 침수 관리에서는 침수 영역의 정확한 탐지, 도로 침수 임계치 초과 여부, 저지대 위험구역 식별 등이 핵심 성능 요소이므로, 이러한 도메인 특화 평가 체계의 부재는 실용적 적용에 한계를 가져온다.

본 연구는 1D-2D 연계 도시 침수 모의 결과를 활용하는 초해상화 기법인 FLO-SRNet 모형을 제안하고, ResUNet 기반 CNN 방법 및 GAN fine-tuning 방법의 성능 비교를 수행한다. 구체적으로 기존 ResUNet 아키텍처를 개선한 FLO-SRNet 모형을 부산 온천천 유역에 적용하여 도시 침수의 복잡한 공간적 특성을 효과적으로 학습하고 복원하는 방법론의 적용성에 대해 논의한다. 또한, 사전 훈련된 모형에 GAN fine-tuning을 적용하여 생성된 이미지의 시각적 품질과 물리적 일관성을 동시에 향상시키는 방법론을 제시한다. 이와 함께 다중 업스케일링 배율(×2, ×4)에 대한 체계적 성능 분석과 기존의 화질 중심 평가를 넘어 지각적 유사도 평가 및 침수 영역 분류 정확도(F1-Score), 침수 심각도별 탐지 성능 등의 도메인 특화 평가 지표를 종합적으로 적용한다. 이를 통해 복잡한 도시 배수 체계가 반영된 고해상도 침수 정보 생성에 최적화된 초해상화 전략을 제시하며, 실시간 침수 예측 및 재해 대응 시스템에서의 활용 가능성을 제고하고자 한다.

2. 연구방법

2.1 초해상화 모형

본 연구에서는 저해상도 침수 지도를 고해상도 침수 지도로 변환하기 위해 ResUNet 기반 아키텍처와 GAN fine-tuning 기법을 활용하였다. 구체적으로 베이스라인 모형인 ResUNet과 본 연구에서 제안하는 FLO-SRNet을 핵심 생성자 모형으로 사용하였으며, 각 모형에 GAN fine-tuning을 적용하여 성능을 향상시켰다. ResUNet 계열 모형들은 잔차 연결(residual connection)과 U-Net의 인코더-디코더 구조를 결합하여 다중 스케일 특징 학습과 세밀한 공간 정보 복원에 뛰어난 성능을 보인다. GAN fine-tuning은 판별자와의 적대적 학습을 통해 더욱 현실적이고 선명한 고해상도 침수 지도를 생성한다. 이러한 접근법은 도시 침수장의 복잡한 공간적 특성을 효과적으로 학습하고 복원하는 데 중점을 둔다.

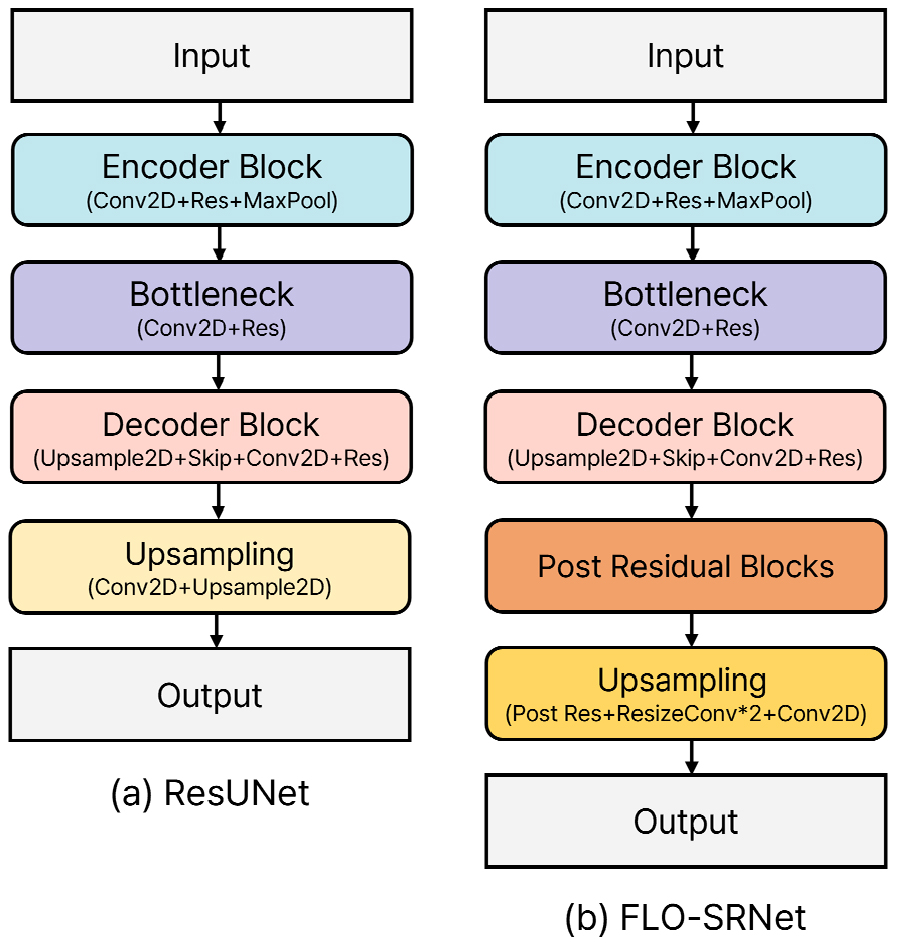

2.1.1 ResUNet

ResUNet은 기존 U-Net의 인코더-디코더 구조에 잔차 블록(residual block)과 스킵 연결(skip connection)을 적용하여 학습 안정성과 특징 표현력을 향상시킨 딥러닝 모형이다. 이 모형은 인코더 단계에서 합성곱 연산과 최대 풀링(max pooling)을 통해 다중 해상도의 공간적 특징을 추출하고, 디코더 단계에서는 업샘플링을 통해 고해상도 이미지를 복원하는 구조를 가진다. 잔차 블록의 도입으로 ResUNet은 기존 U-Net 대비 세밀한 공간 정보를 더욱 정확하게 복원할 수 있다. 본 연구에서 구현한 ResUNet은 4단계 인코더-디코더 아키텍처를 기반으로 하며, 초기 128채널에서 시작하여 각 단계마다 채널 수를 배증한다. 잔차 블록은 두 개의 3×3 합성곱 층과 스킵 연결로 구성되어 기울기 소실 문제를 완화한다. 디코더에서는 업샘플링과 인코더 특징 맵 결합을 통해 공간 정보를 복원하며, 최종 단계에서 이중선형 보간 업샘플링을 적용하여 초해상화를 수행한다.

2.1.2 FLO-SRNet

본 연구에서는 ResUNet의 성능을 더욱 향상시키기 위해 FLO-SRNet 모형을 제안한다. FLO-SRNet은 ResUNet의 기본 구조를 유지하면서 다음과 같은 세 가지 주요 개선사항을 적용하였다. 첫째, 디코더의 업샘플링 과정에서 발생할 수 있는 체커보드 현상(checkerboard artifacts)을 완화하기 위해 표준 UpSampling2D 대신 리사이즈-컨볼루션(resize-convolution) 방식을 도입하였다. 도시 침수 경계가 도로 연석이나 건물 벽을 기준으로 급격한 수심 변화를 보이는 특성을 고려할 때, 체커보드 현상을 억제하는 리사이즈-컨볼루션 방식이 물리적으로 타당한 연속적인 침수 경계를 생성하는 데 효과적이다. 둘째, 디코더의 마지막 단계에 4개의 잔차 블록과 160개 필터로 구성된 후처리 블록을 추가하여 도로망의 선형 구조나 건물 배치의 직교 특성과 같은 저수준 특징(low-level features)을 최종 침수심 분포에 효과적으로 융합시켜 정밀한 복원을 가능하게 하였다. 셋째, 손실 함수에서는 기존의 평균 절대 오차에 더하여 가중 L1 손실과 경계 손실을 결합한 복합 손실 함수를 적용하였다. 특히 Sobel 필터를 이용한 경계 손실은 침수 구역과 비침수 구역의 경계(water edge)에 더 높은 가중치를 부여하여 세부 정보를 보다 선명하게 복원하도록 학습을 유도한다. Fig. 1은 각 모형의 아키텍처 구조를 나타낸다.

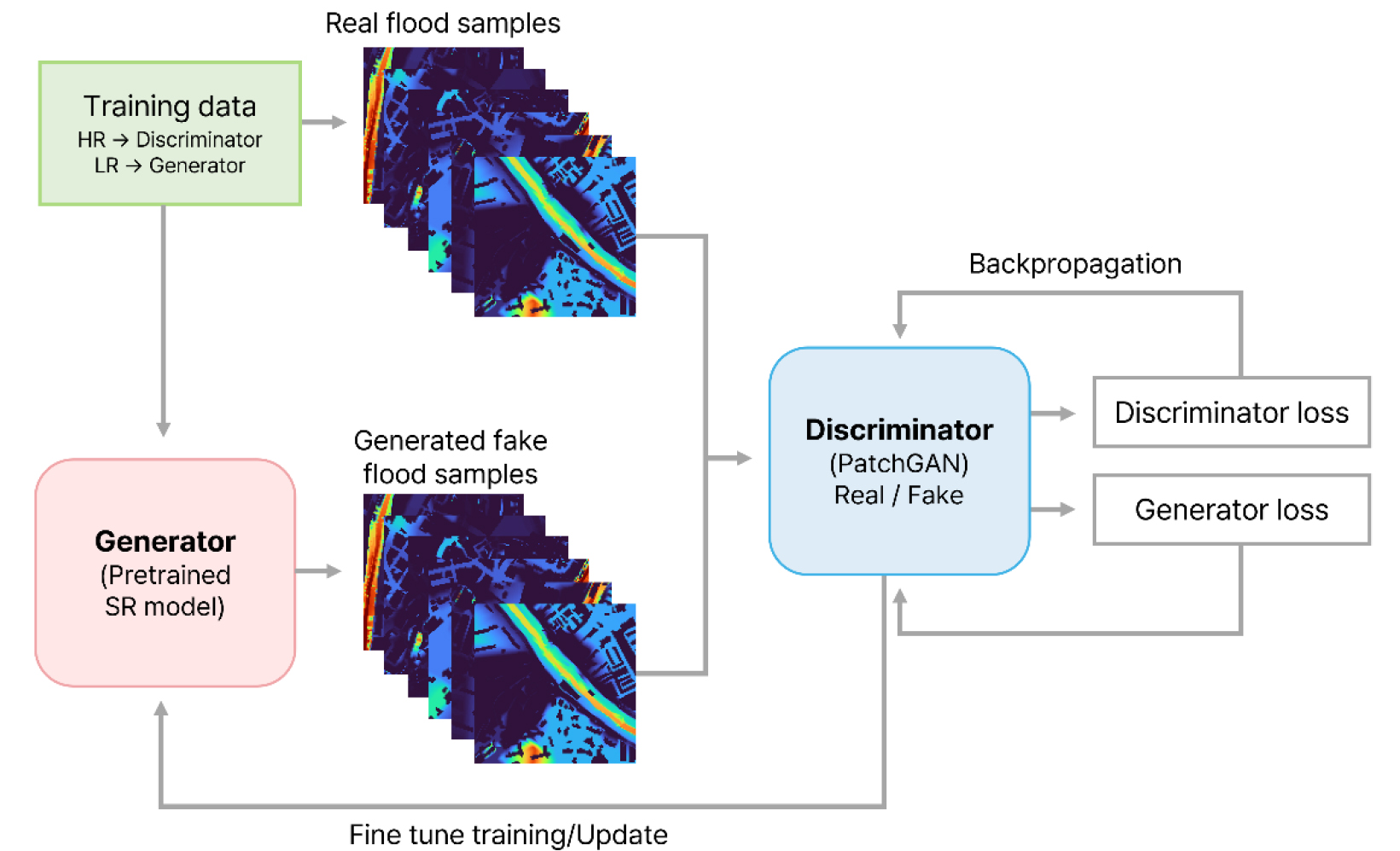

2.1.3 GAN fine-tuning

GAN은 생성자(generator)와 판별자(discriminator)가 경쟁적으로 학습하여 정답 이미지와 유사한 이미지를 생성하는 딥러닝 구조이다(Ledig et al., 2017). 초해상화에서 생성자는 저해상도 이미지로부터 고해상도 이미지를 복원하고, 판별자는 해당 이미지가 실제 고해상도 이미지인지 여부를 판단한다. 이 과정에서 생성자는 판별자를 속이는 방향으로, 판별자는 생성된 이미지를 구분하는 방향으로 학습하여, 보다 세밀한 고해상도 이미지를 생성할 수 있다. 이러한 특성은 침수 지도의 미세한 구조와 경계를 선명하게 복원하는 데 유리하며, 기존 CNN 기반 모형에서 발생하는 이미지 흐림 현상을 효과적으로 완화할 수 있다(Saharia et al., 2023). 하지만 GAN을 독립적으로 학습할 경우 학습 안정성이 낮기(Karimanzira, 2024; do Lago et al., 2023)때문에 도시 홍수 지도와 같은 수문학적 응용에서 요구되는 물리적 일관성을 확보하기 어려울 수 있다. 따라서 본 연구에서는 GAN을 독립적 학습 기법으로 사용하지 않고, 기존 모형을 학습한 뒤 세부 보정 단계에서 fine-tuning 기법으로 활용하였다(Fig. 2).

본 연구에서 사용된 판별자는 PatchGAN 구조로, 4×4 합성곱과 LeakyReLU 활성화 함수를 사용하여 순차적으로 증가하는 구조를 가진다. GAN fine-tuning 과정에서는 기존 복합 손실 함수에 적대적 손실, 저해상도 일관성 손실, 그리고 총 변이 손실을 추가하여 다중 목적 최적화를 수행한다. 특히 저해상도 일관성 손실은 생성된 고해상도 이미지를 다시 저해상도로 축소했을 때 원본 저해상도 이미지와의 일치성을 보장하여 물리적 타당성을 유지한다. 학습 안정성을 위해 생성자와 판별자 모두 Adam 옵티마이저를 사용하며 학습을 수행하였다.

2.2 물리 기반 도시 침수 해석 모형 H12

본 연구에서는 물리 기반 도시 홍수 해석 모형인 H12 (Hybrid-1D-2D) 모형을 활용하여 초해상화 모형에 입력자료가 되는 홍수 해석 결과(최대 침수심)을 생성하였다. 이 모형은 이중 배수 시스템(dual-drainage system) 원리를 적용하여 1차원 하수관로 네트워크와 2차원 지표 유동을 동시에 모사하는 통합형 수치모형이다. H12 모형은 도시 내 강우-유출 과정에서 지표면과 지하 배수시설 간의 상호작용을 보 흐름(weir flow) 및 오리피스 흐름(orifice flow) 이론을 통해 물리적으로 구현한다. 이를 통해 지표면, 우수받이, 관로 시설, 맨홀 등 도시 배수 구성요소들 사이의 유량 교환을 정확하게 모의할 수 있다. 모형 구동을 위한 주요 입력 데이터는 공간정보와 기상정보로 구분된다. 공간정보에는 수치고도모형(DEM) 혹은 수치지표모형(DSM), 토지이용 분류도, 배수관망 정보 등이 해당하며, 기상정보로는 관측소 기반 시간별 강우량, 기상레이더 강우량 등 다양한 형태의 강우 데이터를 사용할 수 있다. H12 모형의 상세한 이론적 배경과 적용사례는 Lee et al. (2025a), Noh et al. (2018)에서 확인할 수 있다.

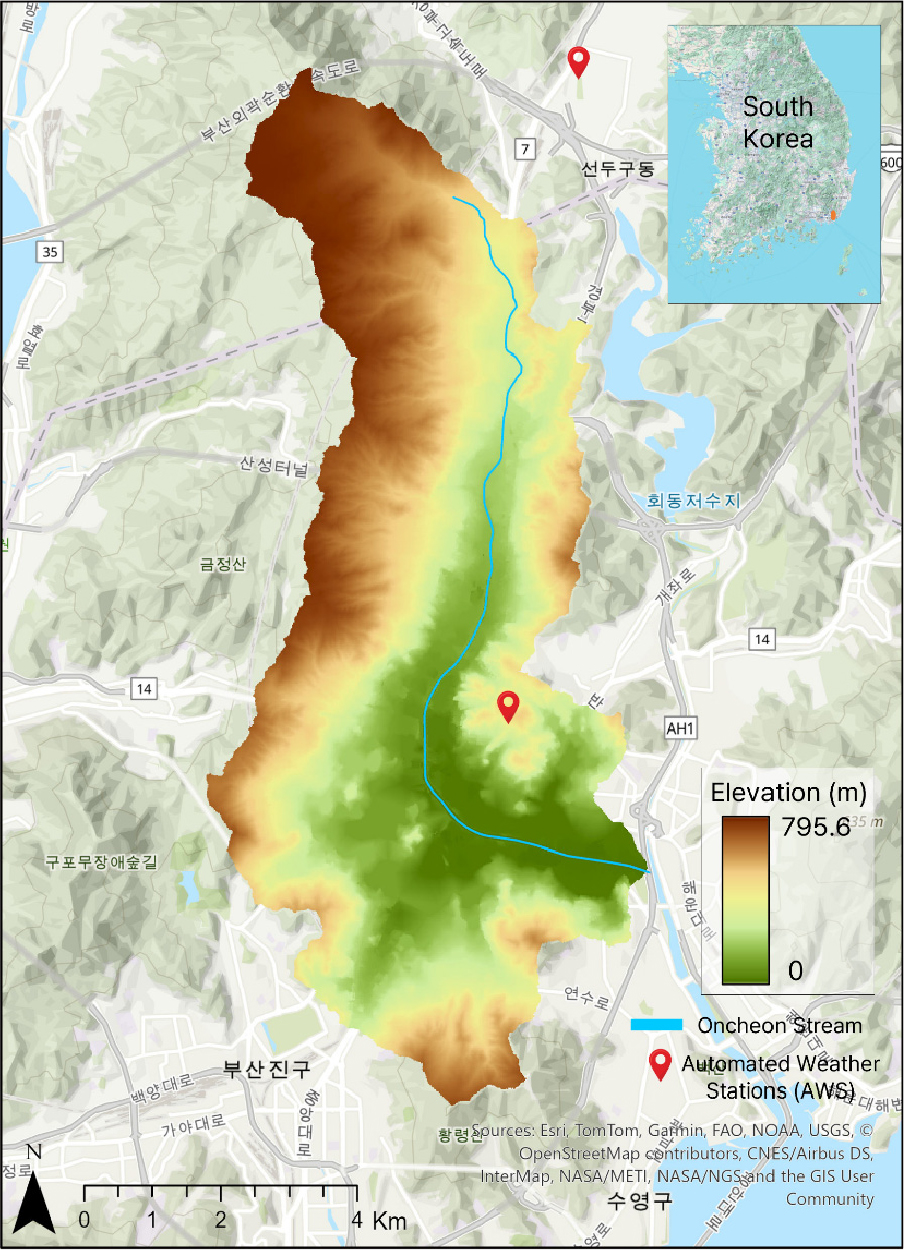

2.3 연구 지역

본 연구의 대상 지역은 부산광역시를 관통하는 도시하천인 온천천 유역이다. 온천천은 금정산에서 발원하여 금정구, 동래구, 연제구를 지나 수영강으로 유입되는 유역으로, 면적은 약 56.28 km², 유로 연장은 약 14.13 km에 이른다. 이 유역은 불투수면적이 약 49%로 대부분 하천을 중심으로 분포하고 있으며, 평균 하폭은 약 49 m로 인근 수영강에 비해 상대적으로 좁다. 하상 경사는 상류 장전교까지 약 1/100, 온천교 지점까지의 중류 구간은 약 1/300, 수영강 합류점까지의 하류 구간은 약 1/1,400으로, 전반적으로 중상류 구간에서 급경사를 보인다(Choi et al., 2023a). 온천천 유역이 위치한 부산 광역시는 기상청 강수량 통계분석에 따르면 연평균 강수량이 1,573.2 mm로(40년 평균, 1985-2024년) 이 중 7-9월 3개월의 평균 강수량이 748.6 mm로 연 강수량의 47.6%가 강수기에 집중되고, 장마와 태풍의 영향으로 단시간에 많은 비가 내리는 수문기상학적 특성을 보인다. 온천천 유역은 높은 불투수면적과 중상류의 급경사로 인해 강우 발생 시 유출 반응이 빠르고 하천 수위가 급격히 상승하는 지리적 특성을 가지며, 집중호우 발생 시 유출량이 단시간에 집중되고 배수 불량 문제가 겹쳐 반복적인 침수 피해가 발생하고 있다. 연구 지역의 위치 및 유역 경계는 국토지리정보원의 수치고도모형과 환경공간정보서비스의 토지피복도를 기반으로 제작되었으며, 이는 Fig. 3에 제시되어 있다.

2.4 자료 구축

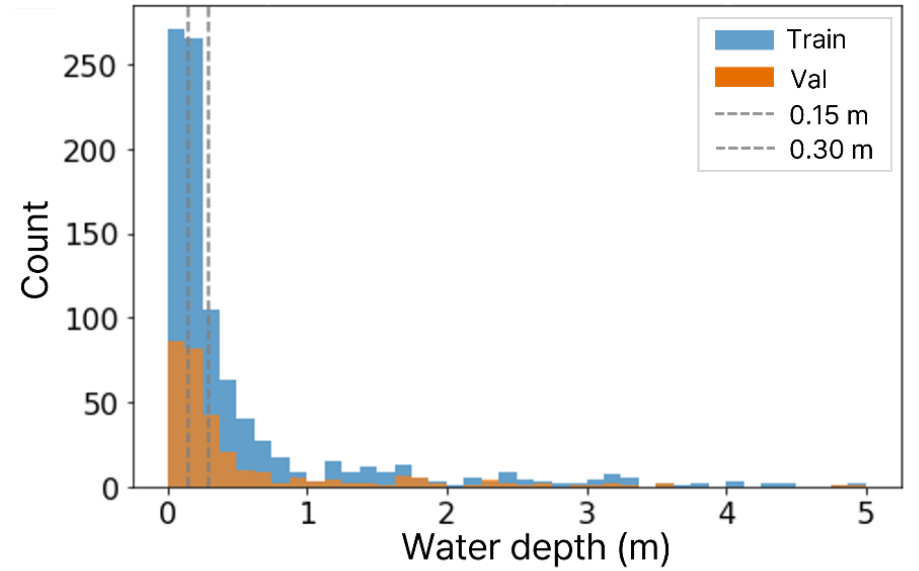

본 연구에서는 온천 유역을 대상으로 2014년 8월 25일 및 2021년 7월 3일 호우 사상에 대한 1D-2D 홍수 해석 결과를 초해상화 모형의 학습 자료로 활용하였다. 전체 유역에 대한 침수심 분포를 단일 이미지로 처리할 경우 공간해상도의 제약으로 인해 도로 및 건물 단위의 세부 침수 양상을 확인하기 어려우므로, 본 연구에서는 유역을 격자 단위로 분할하여 이미지 패치 형태의 데이터 세트를 구축하였다. 이를 통해 도시 기반시설 수준에서 침수 특성 변화를 효과적으로 분석할 수 있도록 하였다. 학습용 고해상도(High-Resolution, HR) 이미지는 4m 공간해상도의 최대 침수심 분포를 기준으로 생성하였으며, 저해상도(Low-Resolution, LR) 이미지는 QGIS의 래스터 리샘플링 기법을 통해 8 m 및 16 m 해상도로 제작하였다. 이는 실제 저해상도 물리모형에서 발생하는 계단식 경계인 에일리어싱(aliasing) 및 블록화(blockiness) 현상을 의도적으로 재현하기 위함이다. 이러한 특성을 학습 데이터에 현실적으로 반영함으로써 실제 적용 시 도메인 갭을 완화할 수 있다. 데이터 세트의 시간적 독립성을 확보하기 위해 2014년 8월 25일 호우 사상에서 추출한 1,000쌍의 HR-LR 이미지 패치를 학습용으로, 2021년 7월 3일 호우 사상에서 추출한 300장의 LR 이미지 패치를 검증용으로 사용하였다. Fig. 4는 학습 및 검증 데이터셋의 침수심 분포를 나타낸다. 0.15 m와 0.30 m 기준선은 침수심 분포의 통계적 특성과 기존 연구를 종합하여 분류 기준을 설정하였다. He et al. (2023)과 Maranzoni et al. (2023)이 제시한 침수 위험도 분류 체계를 참고하되, 본 연구 데이터의 75 백분위수(0.15 m)와 90 백분위수(0.30 m)에 해당하는 값으로 조정하여 경미 침수(mild flood)와 심각 침수(severe flood) 구간을 구분하였다.

2.5 평가 지표

본 연구에서는 초해상화 모형의 성능을 평가하기 위해 원본 고해상도 침수지도와의 유사도 및 침수 예측 정확도를 다각적으로 평가하였다. 이를 위해 이미지 품질 평가에는 PSNR (Peak Signal-to-Noise Ratio)과 SSIM (Structural Similarity Index Metric), LPIPS (Learned Perceptual Image Patch Similarity)을 적용하였으며, 침수 예측 성능 평가는 RMSE (Root Mean Square Error), 침수 영역 분류 정확도 평가는 F1-Score를 사용하였다.

2.5.1 PSNR

PSNR은 초해상화된 이미지와 원본 고해상도 이미지 간의 품질 유사성을 정량적으로 평가하는 데 널리 활용되는 지표이다. PSNR 값이 높을수록 원본 이미지와의 차이가 작아 재현 품질이 우수함을 의미하며, 초해상화(SR) 성능 평가에서 가장 기본적이고 중요한 지표 중 하나로 사용된다(Sara et al., 2019). PSNR은 평균 제곱 오차(Mean Squared Error, MSE)를 기반으로 계산되며, 일반적으로 데시벨(dB) 단위로 표현된다. 계산식은 다음과 같다.

여기서 M은 이미지의 최대 픽셀 값(예: 8비트 이미지의 경우 255)을 나타내며, MSE는 다음 식에 의해 정의된다. MSE는 초해상화 이미지와 원본 이미지 간의 픽셀 값 차이를 제곱하여 평균한 값으로, 두 이미지 간의 유사도를 정량적으로 평가하는 데 사용된다. 여기서 N은 이미지 내 전체 픽셀 수를 나타내며, 는 원본 이미지의 번째 픽셀 값을, 는 초해상화 이미지의 픽셀 값을 나타낸다.

2.5.2 SSIM

SSIM은 초해상화된 이미지와 원본 고해상도 이미지 간의 구조적 유사성을 정량적으로 평가하는 데 사용되는 지표이다. 기존의 PSNR이나 MSE와 같은 단순 오류 기반 지표와 달리, SSIM은 인간 시각 시스템이 인식하는 밝기, 대비(contrast), 구조(structure) 정보를 종합적으로 고려하여 이미지 품질을 측정한다. 각 요소는 독립적으로 계산된 후 통합되어 최종 SSIM 점수를 산출하며, 본 연구에서는 초해상화 침수지도의 시각적 및 구조적 유사성을 평가하는 데 활용하였다. SSIM 값은 0에서 1 사이의 범위를 가지며, 1에 가까울수록 원본 이미지와의 구조적 유사도가 높음을 의미한다(Wang et al., 2004). SSIM의 계산식은 다음과 같다.

여기서 는 원본 이미지, 는 초해상화된 이미지이다. Eqs. (4), (5), (6)의 , , 는 각각 밝기, 대비, 구조 유사성을 나타내는 함수이며, 𝛼, 𝛽, 𝛾는 각 요소의 중요도를 조절하는 매개변수로 일반적으로 1로 설정된다(Wang et al., 2004). 𝜇는 평균을, 𝜎는 표준편차를 뜻하며 는 과 의 공분산을 나타낸다. 𝐶는 상수이며 분모가 0이 되는 것을 방지하기 위해 사용된다.

2.5.3 RMSE

본 연구에서는 딥러닝 기반 초해상화 모형의 성능을 정량적으로 평가하기 위해 RMSE (Root Mean Square Error)를 사용하였다. 침수심 이미지는 Turbo 컬러맵을 적용하여 0~3m 범위의 침수 깊이를 시각화하였으며, 각 픽셀의 색상값은 해당 위치의 침수심과 선형적으로 대응된다. RMSE는 초해상화된 이미지와 원본 고해상도 참조 이미지 간의 픽셀 단위 오차를 측정하는 지표로, 값이 0에 가까울수록 복원 성능이 우수함을 의미한다. RMSE 계산식은 다음과 같이 정의된다.

여기서 는 원본 이미지의 좌표에 있는 픽셀값, 는 초해상화된 이미지의 좌표에 있는 픽셀값, 은 이미지의 크기를 나타낸다.

2.5.4 F1-Score

F1-Score는 초해상화된 침수지도와 원본 고해상도 침수지도 간의 침수 여부 분류 성능을 평가하기 위해 사용되는 지표로, 정밀도(precision)와 재현율(recall)의 조화평균을 기반으로 한다. F1-Score는 0에서 1 사이의 값을 가지며, 1에 가까울수록 예측된 침수 영역이 원본 지도와 잘 일치함을 의미한다. 본 연구에서는 초해상화된 침수지도가 침수 영역을 얼마나 정확하게 복원했는지를 평가하기 위해 F1-Score를 활용하였다. 앞서 정의한 침수심 기준(0.15 m, 0.30 m)에 따라 비침수(non-flood), 경미 침수(mild flood), 심각 침수(severe flood)의 세 클래스로 분류하여 각각의 F1-Score를 계산하였다. F1-Score는 다음과 같이 정의된다.

여기서 Precision은 모형이 침수라고 예측한 픽셀 중 실제로 침수인 픽셀의 비율이며, Recall은 실제 침수 픽셀 중 모형이 올바르게 침수로 예측한 비율을 나타낸다. 두 값은 각각 다음과 같이 계산된다.

위 식에서 TP (True Positive)는 실제 침수 지역을 침수로 올바르게 예측한 픽셀 수, FP (False Positive)는 비침수 지역을 침수로 잘못 예측한 픽셀 수, FN (False Negative)는 실제 침수 지역을 비침수로 잘못 예측한 픽셀 수를 의미한다.

2.5.5 LPIPS

LPIPS (Learned Perceptual Image Patch Similarity) 지각적 유사도 측정 지표로, 인간의 시각적 인지와 높은 상관관계를 보이는 평가지표이다. 기존의 픽셀 기반 지표(PSNR, SSIM 등)와 달리, 사전 훈련된 심층신경망의 특징 표현을 활용하여 이미지 간의 지각적 차이를 정량화한다. 일반적으로 0에서 1 사이의 값을 가지며, 0에 가까울수록 더 유사하다.

여기서 는 초해상화 모형을 통해 생성된 예측 이미지이고, 는 고해상도 참조 이미지(HR)를 나타낸다. 은 사전 훈련된 신경망의 레이어 인덱스이며, 는 레이어 에서의 공간적 위치()에 해당하는 정규화된 특징 벡터를 의미한다. 은 레이어 에서 학습된 가중치 벡터이고, 은 각각 해당 레이어의 특징 맵의 높이와 너비를 나타낸다.

3. 결과 및 분석

3.1 FLO-SRNet

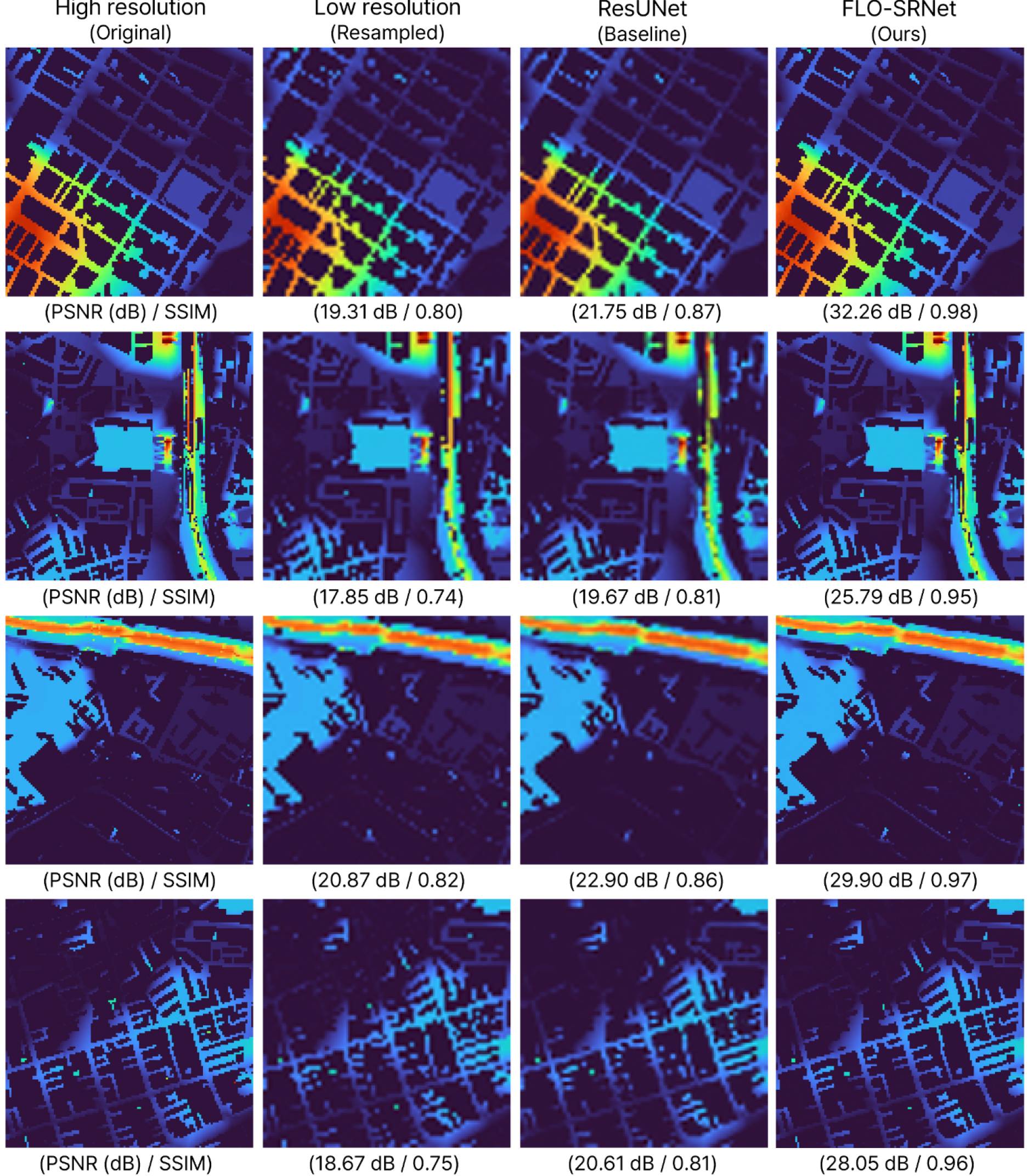

본 연구에서는 FLO-SRNet의 초해상화 성능을 기존 ResUNet 기반 모형 및 전통적인 쌍입방 보간법(bicubic interpolation)을 적용한 리샘플링 결과와 비교하였다. 비교는 시각적 품질, 정량적 지표, 그리고 클래스별 분류 성능을 중심으로 수행되었다. Fig. 5는 ×2 업스케일링 배율 초해상화 결과를 비교한 것이다. 왼쪽 열부터 원본 고해상도(high resolution), 저해상도 리샘플링 결과(low resolution), ResUNet, FLO-SRNet 결과를 나타낸다. 연구결과 FLO-SRNet은 이미지의 선명도를 높이는 것을 넘어, 도시침수 현상의 수리적 특성을 효과적으로 복원하는 것을 확인할 수 있다. 예를 들어, 저해상도 입력(resampled)에서는 뭉개져 있던 좁은 도로에서의 침수 패턴이 FLO-SRNet을 통해 도로망을 따라 흐름이 연결되는 형태로 복원되었다. 또한, 건물 군집 지역에서는 침수심이 급격히 변하는 경계가 뚜렷하게 나타나는데, 이는 건물이 흐름의 물리적 장벽으로 작용하는 현상을 모형이 학습했음을 시사한다. 이러한 결과는 제안된 모형이 DSM을 별도로 학습하지 않아도 도시 기반시설의 구조적 특성을 이해하고 물리적으로 일관성 있는 고해상도 침수장을 생성할 수 있음을 보여준다. 또한, 모형에 적용된 경계 손실 함수가 도로와 건물 사이의 급격한 침수심 변화를 학습하는데 효과적이었기 때문으로 분석된다. 반면, 저해상도 리샘플링 결과는 저해상도 이미지 특유의 노이즈가 두드러졌다. ResUNet 기반 모형은 구조적 윤곽을 일부 복원하였으나 여전히 흐릿한 노이즈가 포착되었다. Fig. 6은 ×4 배율 초해상화 결과를 보여주는데, 고배율 변환에서는 손실된 공간 정보를 복원하는 난이도가 더욱 높음에도 불구하고 FLO-SRNet은 여전히 경쟁 모형 대비 우수한 결과를 보였다. FLO-SRNet은 ResUNet에서 노이즈가 많아 흐릿했던 좁은 도로의 침수 경로를 명확히 구분하며 고해상도 이미지와 가장 유사한 형태를 유지하였다.

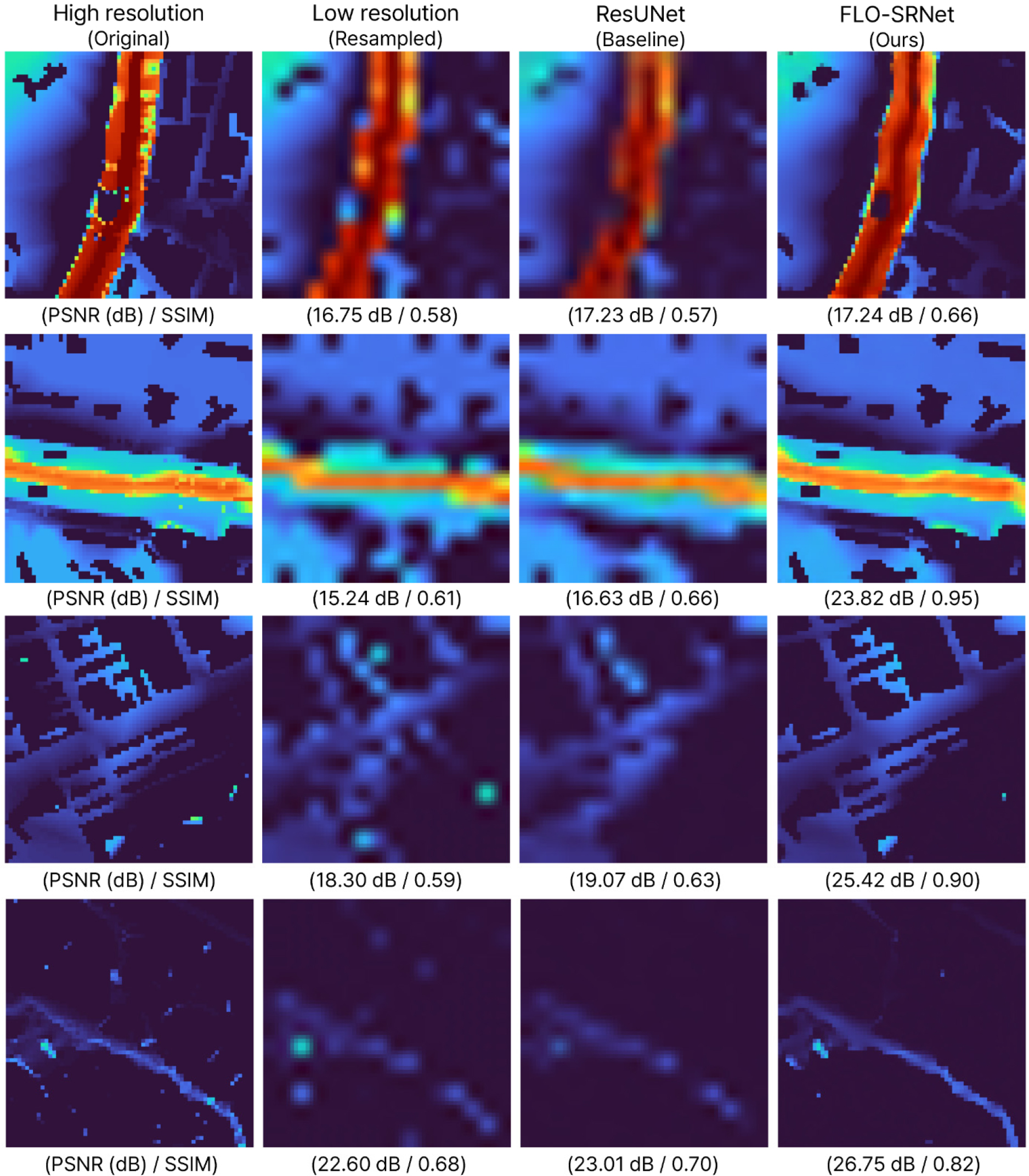

정량적 성능 비교 결과는 Fig. 7과 Table 1에 요약되어 있다. FLO-SRNet은 LR 및 ResUNet 대비 모든 지표에서 뚜렷한 향상을 보였다. ×2 업스케일링에서 FLO-SRNet은 LR 대비 PSNR과 SSIM이 각각 약 23.4%와 13.4% 증가하였고, RMSE와 LPIPS는 각각 52.6%와 83.3% 감소하여 침수심 오차와 지각적 왜곡이 크게 줄었다. 또한 F1-Score에서는 비침수에서 2.1%, 경미 침수에서 약 89.7%, 심각 침수에서 약 37.7%의 향상을 보였다. ×4 업스케일링에서도 FLO-SRNet은 PSNR과 SSIM이 각각 13.4%와 15.5% 개선되었으며, RMSE와 LPIPS는 각각 34.8%와 64.5% 감소하였다. 특히 F1-Score에서 경미 침수 구간은 LR 대비 두 배 향상되었고, 심각 침수 구간에서도 10%의 개선을 보여주었으며, 배율이 커짐에도 불구하고 성능이 일정 수준 이상 유지되었다.

이러한 결과는 FLO-SRNet의 세 가지 핵심 개선사항이 복합적으로 작용하여 도시 침수 특성 복원에 효과적임을 입증한다. 첫째, 리사이즈-컨볼루션 방식의 도입은 기존 업샘플링에서 발생하는 체커보드 아티팩트를 효과적으로 억제하여 경계면의 연속성을 보존하였다. 이는 안티앨리어싱 기법과 다단계 합성곱 연산이 결합되어 고주파 노이즈를 제거하면서도 구조적 세부정보를 유지하는 데 기여한 것으로 분석된다. 둘째, 후처리 블록의 추가는 인코더에서 추출된 저수준 특징(도로망, 건물 경계 등)과 디코더의 고수준 특징(전체 침수 패턴)을 효과적으로 융합하여 최종 출력의 공간적 일관성을 강화하였다. 특히 4개의 잔차 블록과 160개 필터 구성은 복잡한 도시 구조물의 다중 스케일 특징을 충분히 표현할 수 있는 용량을 제공하였다. 셋째, Sobel 경계 검출 기반 복합 손실 함수는 침수 경계 영역에 대한 학습을 강화하여 경미 침수와 심각 침수 구간의 분류 정확도를 크게 향상시켰다. 이는 가중 L1 손실이 침수심 변화가 급격한 지역에 더 높은 학습 가중치를 부여함으로써 달성되었다. 결과적으로 FLO-SRNet은 단순히 기존 ResUNet 기반 모형보다 우수할 뿐 아니라, 저해상도 입력 자체와 비교했을 때도 절대적인 정확도 향상을 달성하여 공간 해상도 차이에서 비롯되는 정보의 간극을 효과적으로 메울 수 있음을 확인했다.

Table 1.

Quantitative comparison of super-resolution models at ×2 and ×4 upscaling factors

3.2 GAN fine-tuning

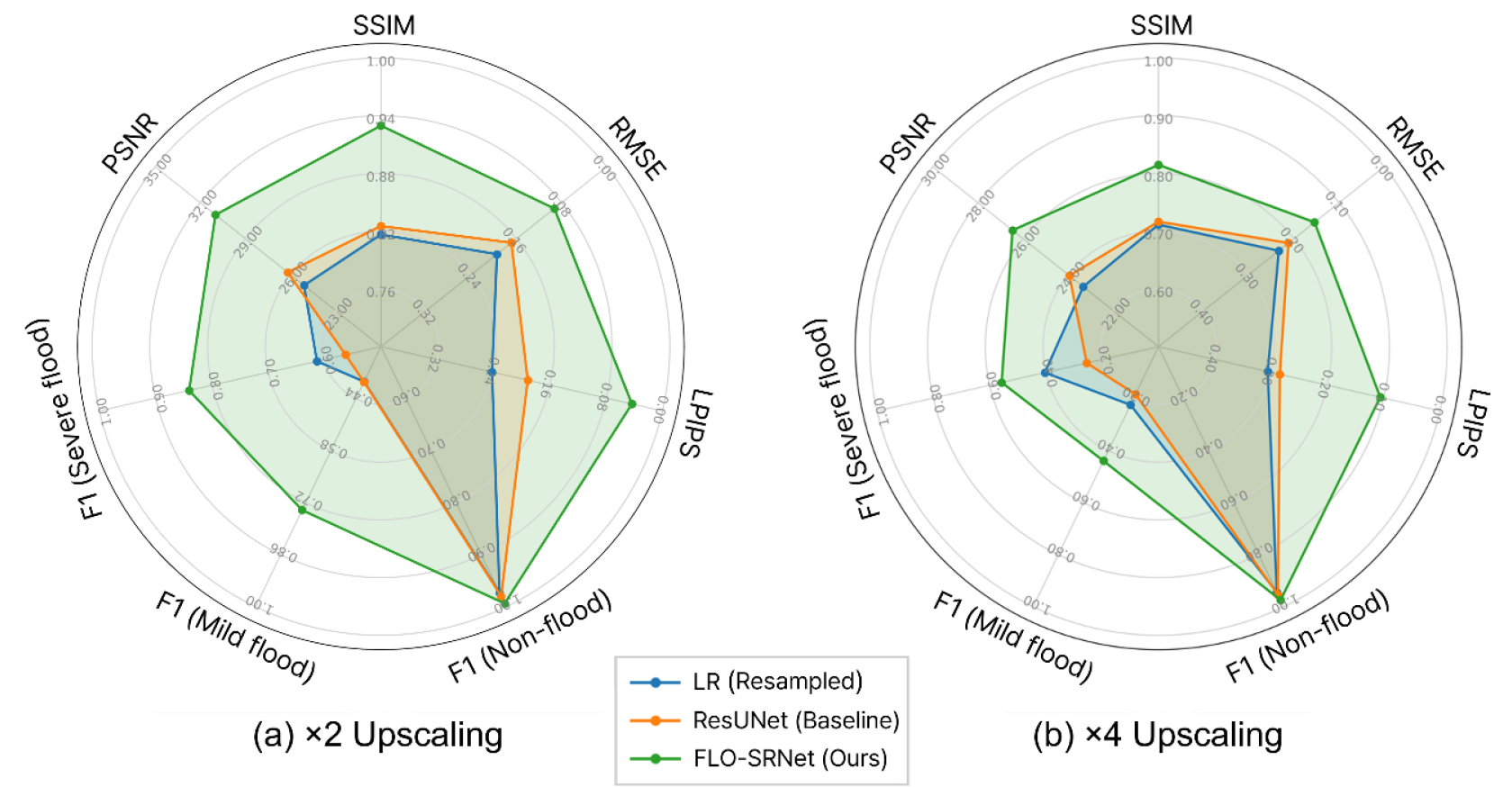

GAN fine-tuning이 초해상화 성능에 미치는 영향을 분석하기 위해 ResUNet과 FLO-SRNet 모형을 생성자로 사용하여 GAN 아키텍처에서 적대적 훈련을 수행한 전후의 성능을 비교하였다. 여기서 ResUNet과 FLO-SRNet은 GAN의 백본 생성자(backbone generator) 역할을 담당하며, 판별자와의 적대적 학습을 통해 더욱 현실적이고 고품질의 초해상도 이미지를 생성하도록 fine-tuning되었다. Fig. 8은 ×2 및 ×4 업스케일링에서 GAN fine-tuning 효과를 시각적으로 보여준다. 상단 행은 ×2 업스케일링, 하단 행은 ×4 업스케일링 결과를 나타내며, 왼쪽부터 고해상도 원본, 저해상도 입력, ResUNet, ResUNet+GAN, FLO-SRNet, FLO-SRNet+GAN 순으로 배치하였다.

시각적 분석 결과, GAN fine-tuning은 적용된 두 모형 모두에서 뚜렷한 품질 향상을 보였다. ×2 업스케일링에서 ResUNet+GAN은 기본 ResUNet 대비 침수 영역의 경계선이 개선되었으며 얕은 물 웅덩이도 복원되는 것을 확인하였다. FLO-SRNet+GAN의 경우 이미 우수한 기본 성능에서 추가적인 향상을 보여 고해상도 원본과 거의 구별하기 어려운 수준의 복원 품질을 달성하였다. ×4 업스케일링에서는 고배율 변환의 어려움에도 불구하고 GAN fine-tuning의 효과가 더욱 두드러졌다. ResUNet+GAN은 기본 모형에서 나타나는 블러링 현상을 일부 개선하였으나 여전히 경계면에서 흐릿함이 관찰되었다. 이는 생성자 백본 모형의 기본 성능이 충분히 우수해야 GAN fine-tuning의 효과가 극대화됨을 시사한다. 반면, FLO-SRNet+GAN은 뛰어난 기본 성능을 바탕으로 GAN fine-tuning을 통해 침수 깊이의 세밀한 그라데이션 뿐만 아니라 고해상도에서만 식별 가능한 미세한 침수 영역까지 정밀하게 복원하였다. 특히 고립된 소규모 침수 지점과 좁은 수로 형태의 침수 패턴이 GAN fine-tuning을 통해 뚜렷하게 재현되어 실제 고해상도 이미지와 매우 유사한 공간적 세부 구조를 달성하였다. 이러한 미시적 침수 패턴의 복원은 도시 홍수 모니터링에서 배수 시설의 국부적 침수나 저지대 집수 현상을 정확히 파악하는 데 중요한 의미를 갖는다.

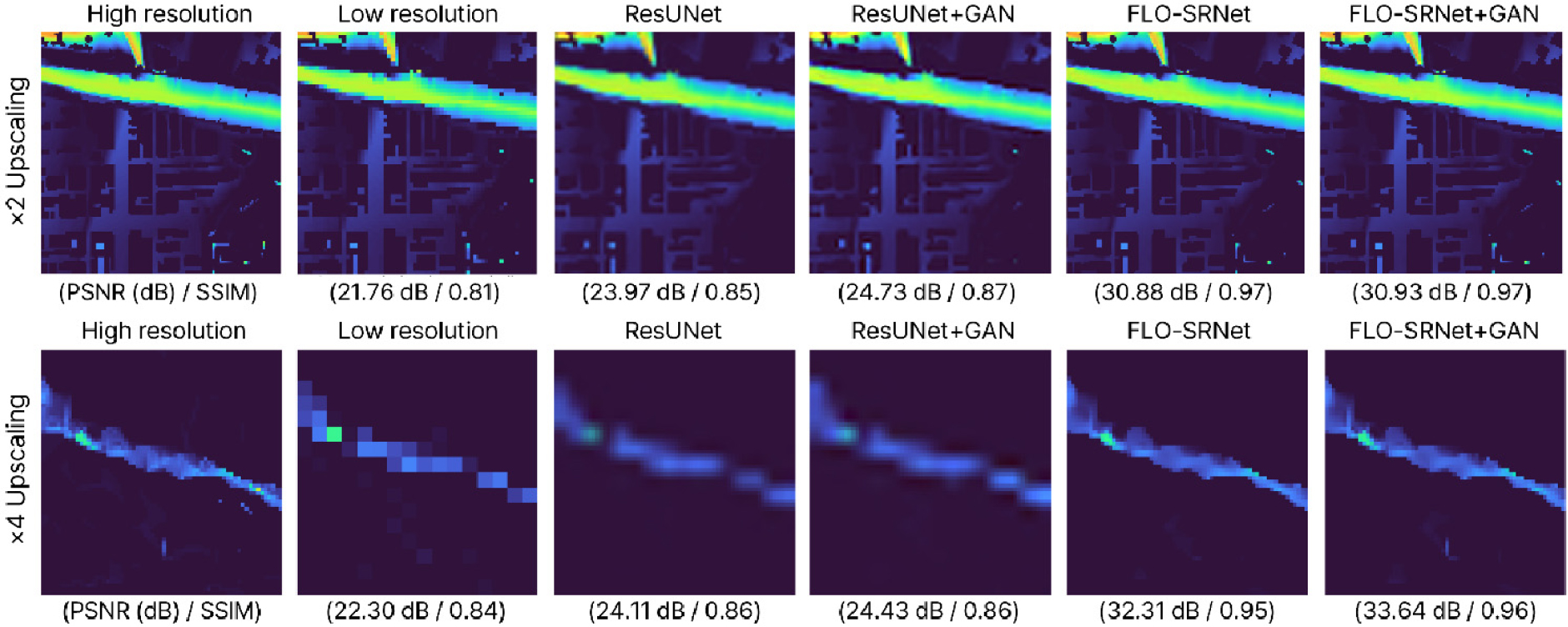

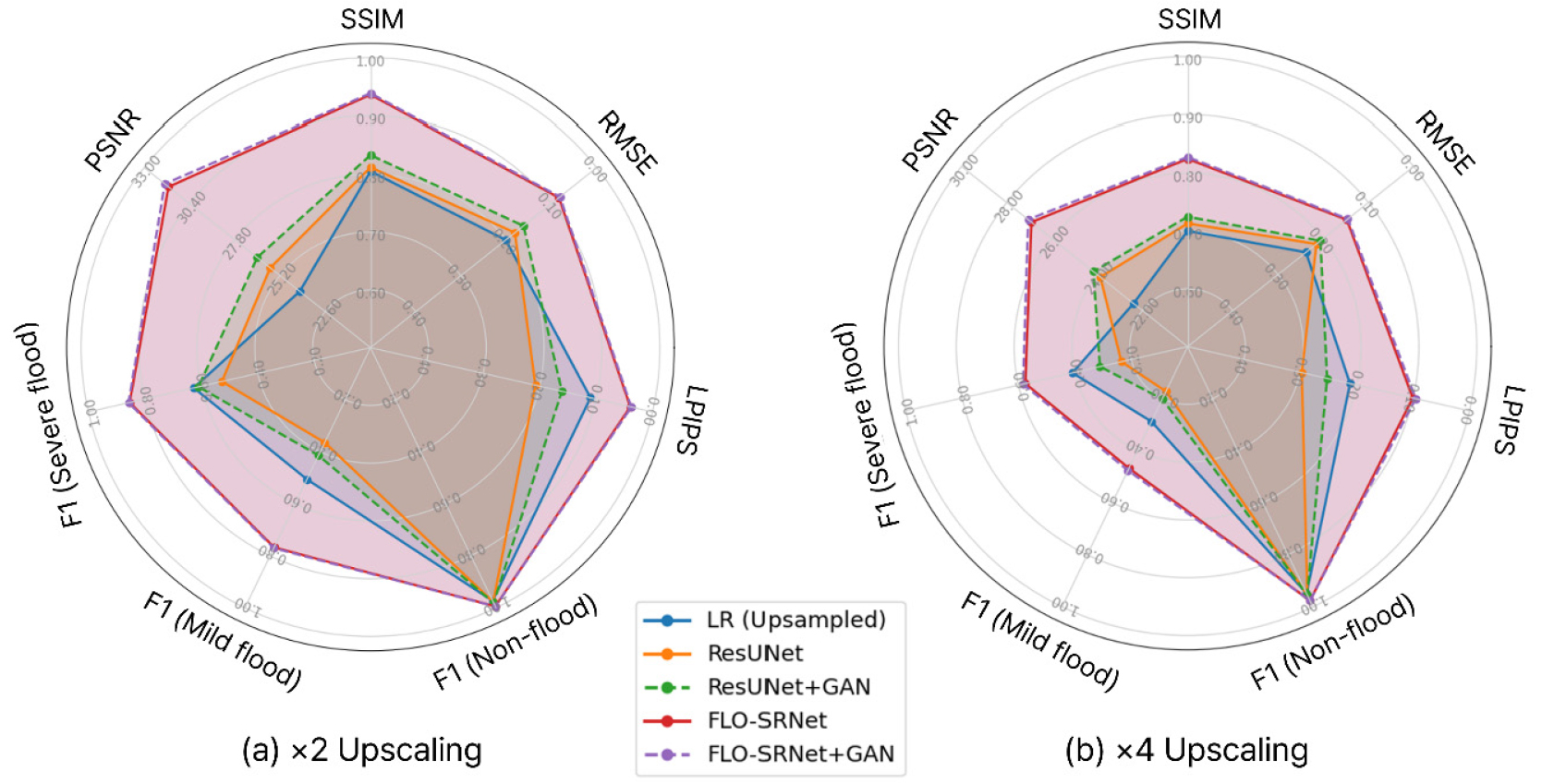

Fig. 9는 GAN fine-tuning 효과를 정량적 지표별로 비교한 레이더 차트이다. (a) ×2 와 (b) ×4 업스케일링 모두에서 GAN이 적용된 모형들(FLO-SRNet+GAN, ResUNet+GAN)이 기본 모형들보다 전체적으로 더 큰 면적을 차지하여 종합적인 성능 향상을 시각적으로 확인할 수 있다. 특히 FLO-SRNet +GAN은 모든 지표에서 최외곽에 위치하여 최고 성능을 보였다. Table 2는 GAN fine-tuning의 정량적 효과를 상세히 제시한다. ×2 업스케일링에서 ResUNet+GAN은 기본 ResUNet 대비 PSNR이 5.2% 향상(25.19 dB → 26.51 dB)되었고, RMSE와 LPIPS는 각각 5.9%와 15.8% 감소하여 침수심 예측 오차와 지각적 왜곡이 개선되었다. 클래스별 F1-Score에서는 비침수 지역이 0.98로 기본 모형과 동일한 높은 성능을 유지하였으며, 경미 침수에서 2.5% 향상(0.40 → 0.41), 심각 침수에서 8.9% 향상(0.56 → 0.61)의 개선을 보였다. FLO-SRNet+GAN은 이미 우수한 기본 성능에서 추가로 PSNR 2.7% 향상, SSIM 1.1% 개선을 달성하였으며, RMSE는 11.1% 감소하였다. 클래스별로는 비침수 지역이 0.99로 기본 모형과 동일하게 우수한 성능을 유지하였고, 경미 침수 클래스에서 4.1% 향상(0.74 → 0.77), 심각 침수에서 2.4% 향상(0.84 → 0.86)을 보였다. ×4 업스케일링에서는 일부 오차 지표 개선에 대한 GAN fine-tuning의 효과가 상대적으로 제한적으로 나타났다. ResUNet+ GAN은 기본 모형 대비 PSNR이 0.9% 향상에 그쳤으나, LPIPS는 10.7% 감소하여 지각적 품질이 개선되었다. 클래스별 성능에서는 비침수 지역이 0.95로 기본 모형과 동일한 성능을 유지하였으며, 경미 침수에서 11.1% 향상(0.18 → 0.20), 심각 침수에서 24.0% 향상(0.25 → 0.31)을 보여 분류 성능이 크게 개선되었다. FLO-SRNet+GAN은 PSNR 2.2% 향상, SSIM 1.2% 개선과 함께 LPIPS 9.1% 감소를 달성하였다. 클래스별로는 비침수 지역에서 1.0% 향상(0.97 → 0.98), 경미 침수에서 9.1% 향상(0.44 → 0.48), 심각 침수에서 31.8% 향상(0.44 → 0.58)을 보여 모든 침수 클래스에서 일관된 성능 향상을 달성하였다.

Table 2.

Quantitative comparison of the effect of GAN fine-tuning at ×2 and ×4 upscaling factors

그러나 GAN의 적용으로 인한 시각적 품질 향상이 항상 PSNR이나 RMSE와 같은 오차 지표의 개선으로 이어지는 것은 아니다. 이는 초해상화 분야에서 잘 알려진 ‘인식-왜곡 상충관계(perception-distortion tradeoff)’ 현상으로 설명할 수 있다. Ledig et al. (2017)이 지적했듯이, MSE와 같은 픽셀 단위 손실 함수에 최적화된 모형은 높은 PSNR 값을 달성하지만, 결과물이 지나치게 부드러워져 실제와 같은 질감을 복원하지 못하는 경향이 있다. 반면, GAN은 적대적 학습을 통해 인간이 인지하기에 더 자연스럽고 선명한, 즉 고주파 디테일이 살아있는 이미지를 생성하는 데 중점을 둔다. 이 과정에서 생성된 미세한 질감이나 날카로운 경계가 원본 고해상도 이미지와 픽셀 단위로 정확히 일치하지 않더라도, 판별자를 속일 수 있는 결과라면 학습이 진행된다. 따라서 본 연구에서 FLO-SRNet +GAN이 달성한 정량적 성능 향상 폭이 시각적 개선에 비해 상대적으로 미미해 보이는 것은, 이미 우수한 기본 생성자인 FLO-SRNet이 픽셀 오차를 상당 부분 최소화한 상태에서, GAN fine-tuning이 정확성(fidelity)보다는 현실성(realism)을 보정하는 방향으로 작동했기 때문으로 해석할 수 있다.

4. 결 론

본 연구는 1D-2D 연계 도시 침수 모의 결과에 딥러닝 초해상화(SR)를 적용해 저해상도 침수지도를 고해상도로 변환하는 FLO-SRNet과 GAN fine-tuning 방법을 제시하고 그 효과를 체계적으로 검증하였다. 부산 온천천 유역에서 2014년(학습 1,000쌍)과 2021년(검증 300쌍) 침수 모의 자료로 평가하였으며, PSNR, SSIM, RMSE, LPIPS와 함께 F1-Score 등 침수 특성 평가 지표를 활용하였다. FLO-SRNet은 ResUNet 대비 ×2, ×4 업스케일링에서 화질 및 분류 성능을 일관되게 향상시켜 신속한 고해상도 침수지도 생성과 예경보 업무로의 활용 가능성을 확인하였다. 주요 결과는 다음과 같다.

(1) 제안한 FLO-SRNet은 기존 ResUNet 대비 현저한 성능 향상을 달성하였다. 리사이즈-컨볼루션 방식, 후처리 블록, 복합 손실 함수의 도입을 통해 ×2 업스케일링에서 기존 ResUNet 대비 PSNR 23.0%, SSIM 12.0% 향상, RMSE 47.1%, LPIPS 78.9% 감소, ×4 업스케일링에서 PSNR 10.5%, SSIM 13.9% 향상, RMSE 28.6%, LPIPS 60.7% 감소를 달성하였다.

(2) 전통적인 픽셀 기반 화질 평가를 넘어 침수 영역 분류 정확도(F1-Score)를 분석한 결과, FLO-SRNet은 ×2 업스케일링에서 경미 침수 85.0%, 심각 침수 50.0% 향상, ×4 업스케일링에서 경미 침수 144.4%, 심각 침수 76.0%의 F1-Score 향상을 달성하여 제안한 FLO-SRNet 모형이 도시 침수장의 복잡한 구조적 특성을 효과적으로 복원함을 입증하였다.

(3) GAN fine-tuning의 효과는 생성자 백본 모형의 성능에 따라 차별화되었다. ×2 업스케일링에서 ResUNet+GAN은 PSNR 5.2%, LPIPS 15.8% 개선을, FLO-SRNet+GAN은 PSNR 2.7%, RMSE 11.1% 추가 향상을 보였다. ×4 업스케일링에서는 ResUNet+GAN의 경우 생성자의 성능 한계가 fine-tuning 효과에 반영되어 제한적 개선에 그쳤으나, FLO-SRNet+GAN은 높은 기본 성능에도 불구하고 얕은 물웅덩이와 침수 경계를 고해상도 원본에 더욱 근접하게 복원하였다. 이는 생성자의 품질이 GAN fine-tuning 효과를 결정하는 핵심 요소임을 시사한다.

본 연구는 수자원 분야 초해상화 연구에서 상대적으로 제한적이었던 도시 침수 적용 사례를 확장하고, 기존 픽셀 화질 중심 평가(PSNR, SSIM)에서 벗어나 침수 지각적 유사도 평가(LPIPS) 및 침수 영역 분류 정확도(F1-Score), 침수 심각도별 탐지 성능 등의 도메인 특화 평가 체계를 구축하였다. 또한 단순 2차원 모형이 아닌 1D-2D 연계 모형의 복잡한 침수 패턴에 대한 초해상화 성능을 검증함으로써 현실적 도시 배수 환경에서의 기술적 타당성을 확립하였다. 다만, 특정 지역(온천천 유역)과 제한된 호우 사상(학습: 2014년, 검증: 2021년)을 대상으로 수행되어 다양한 지형 특성과 극한 기상 조건에 대한 일반화 가능성에는 한계가 있다. 또한 본 연구는 최대 침수심 분포에 국한된 분석을 수행하였다. 하지만 실제 재해 대응에서는 유속, 침수 지속시간 등 복합적인 정보가 중요하다. 향후 연구에서는 침수심, 유속 벡터(u, v) 등을 다중 채널로 입력받아 동시에 초해상화하는 멀티채널로 확장하여 더욱 종합적이고 물리적으로 타당한 침수 정보를 생성하는 방향으로 확장할 필요가 있다. 아키텍처 측면에서는 ResUNet 계열 모형에 한정되어 최근 컴퓨터 비전 분야에서 주목받고 있는 트랜스포머 기반 초해상화 모형(Conde et al., 2022; Liang et al., 2021)이나 확산 모형(diffusion model) 기반 초해상화 모형의(Wang et al., 2023) 도시 침수 분야 적용 가능성이 검증되지 않았다. 예를 들어, 트랜스포머 기반 모형은 이미지의 장거리 의존성(long-range dependency) 학습에 강점이 있으므로, 유역 전체의 광범위한 침수 패턴을 복원하는 데 더 효과적일 수 있다. 따라서 향후 연구에서는 시공간 데이터셋을 확장하고 트랜스포머 및 확산 모형과 같은 최신 아키텍처의 적용성을 검증하여, 다양한 도시 환경에 대한 예측 모형의 강건성과 일반화 성능을 확보해 나갈 필요가 있다.